من المنحنى الأساسي إلى حلقة البحث والتطوير المغلقة: تقييم موضوعي لاحتمالية "التحسين الذاتي التكراري للذكاء الاصطناعي" قبل 2028

لماذا تستحق "احتمالية %60" دراسة معمقة

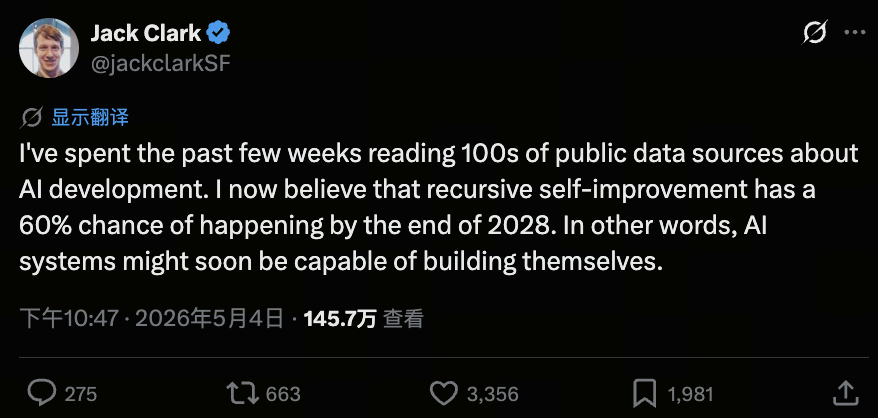

مصدر الصورة: تغريدة المؤسس المشارك لـ Anthropic

مصدر الصورة: تغريدة المؤسس المشارك لـ Anthropic

في مناقشات الذكاء الاصطناعي، كثيرًا ما تُسلط الأضواء على النتائج النهائية، بينما يُتجاهل المنطق التحليلي الكامن وراءها. يتجلى هذا النمط بوضوح في الجدل حول التحسين الذاتي التكراري (RSI)، حيث يدور النقاش حول فرضية جريئة: بحلول عام 2028، هناك احتمال كبير أن يحقق الذكاء الاصطناعي قدرات بحث وتطوير ذاتية التعزيز. إلا أن السؤال الأعمق هو: هل رصدنا بالفعل ما يكفي من "الإشارات المنهجية المبكرة" لنقل هذا السيناريو من فرضية هامشية إلى أولوية مخاطرة أساسية يجب أن يتعامل معها صانعو القرار الرئيسيون؟

هذه المسألة ذات أهمية بالغة للسياسات والصناعة معًا، إذ إن RSI ليست مجرد "أسطورة الذكاء العام" النظرية، بل تمثل تحديًا هندسيًا حقيقيًا: هل يمكن للذكاء الاصطناعي تولي المزيد من الخطوات عالية القيمة ضمن سير عمل البحث والتطوير وربطها في حلقة مغلقة متكررة؟ عند تحقق ذلك، يتغير إيقاع التقدم التكنولوجي، ويُعاد تعريف فجوات القدرات التنظيمية، وتتعطل دورات التنظيم التقليدية.

لذا ينبغي أن يتحول النقاش حول RSI من "الإيمان أو عدم الإيمان" إلى تقييم كفاية الأدلة، وحكمة الاستقراء، ومستوى الاستعداد العملي.

قاعدة الأدلة: قيمة وحدود التقدم المتسق عبر معايير متنوعة

الأدلة الأقوى لصالح RSI لا تكمن في إنجاز نموذج منفرد، بل في التقدم المتزامن عبر المهام والسيناريوهات وأطر التقييم. المعايير الشائعة مثل قابلية تكرار الأبحاث، تحسين الأداء بعد التدريب، حل المشكلات الواقعية، وتحديات هندسة البرمجيات، جميعها تظهر اتجاهات تصاعدية بدرجات متفاوتة. القيمة الحقيقية تكمن في "اتساق الاتجاه" وليس في "القيم المطلقة" فقط: عندما تتحسن مؤشرات متعددة معًا بمرور الزمن، فهذا يشير غالبًا إلى تعزيز شامل للقدرات الجوهرية.

لكن هناك ثلاث حدود رئيسية يجب الانتباه إليها:

- بيئات المعايير تختلف عن الواقع الفعلي. فالمعايير ذات حدود واضحة، وتغذية راجعة مستقرة، ومعايير تقييم قابلة للتكرار. أما في البحث والتطوير الواقعي، فهناك تغير الأهداف، التعاون بين الفرق، نقل المعرفة الضمنية، قيود الموارد، والاحتكاك المؤسسي. النجاح في البيئات المضبوطة لا يضمن نتائج تنظيمية موثوقة.

- وضوح المؤشرات لا يعني اكتمال القدرات. تقيس المعايير الحالية "قدرة حل المشكلات" بسهولة، لكنها تعجز عن عكس السلوكيات العليا في البحث والتطوير—مثل تعريف المشكلات، المفاضلات بين الأولويات، تحديد أسباب الفشل، وحوكمة الدورات. قد تتحسن النماذج في "حل المشكلات الصحيحة"، لكن ليس بالضرورة في "القيام بالأفعال الصحيحة باستمرار".

- استقراء الاتجاهات قد يتعطل بسبب انتقال عنق الزجاجة. فالتاريخ يبرهن أن التقدم التقني ليس خطيًا دومًا. عند تجاوز عنق زجاجة، قد تظهر أخرى في جودة البيانات، تكاليف معدل التجزئة، موثوقية النظام، الامتثال، أو القبول المجتمعي. إغفال هذه القيود الثانوية قد يؤدي إلى المبالغة في تقدير التقدم والتقليل من حجم المقاومة.

لذلك، التقدم المتسق عبر معايير متعددة يمثل إشارة قوية، لكنه ليس دليلًا قاطعًا. إنه يؤكد أهمية الاتجاه، لا ثبات الجدول الزمني.

الانقسام الجوهري: هل تكفي مكاسب القدرات لسد فجوة الحلقة المغلقة؟

الجدل الحقيقي حول RSI لا يدور حول "قوة الذكاء الاصطناعي"، بل حول "كفاية المكاسب لتشكيل حلقة مغلقة". فالحلقة المغلقة الحقيقية تتطلب خمس خطوات متتابعة على الأقل: استيعاب المعلومات ومراجعة الأدبيات، توليد الفرضيات، تصميم وتنفيذ التجارب، تقييم النتائج وتشخيص الأخطاء، وتحديث الاستراتيجيات وإعادة التكرار. تحسين خطوة واحدة يعزز الكفاءة، لكن التكامل القوي بين الخطوات هو ما يحقق العوائد المركبة.

حاليًا، يظهر التقدم بوضوح في الخطوات الثلاث الأولى وجزء من الرابعة: النماذج باتت أكثر كفاءة في توليد الأكواد، إعداد تجارب الاختبار، تلخيص الأدبيات، والبحث عن المعلمات. أما أصعب أجزاء الحلقة المغلقة فعادة ما تتركز في جانبين:

- التشخيص المتين: هل يستطيع النظام تحديد الأسباب الجذرية بدقة وسط بيانات مشوشة أو إشارات متضاربة أو إخفاقات متقطعة، بدلاً من الاكتفاء بحلول سطحية؟

- مواءمة الأهداف: هل يمكن للنظام تنفيذ استراتيجيات "فعالة على المدى الطويل لكنها دون المستوى الأمثل على المدى القصير" باستمرار في ظل قيود متعددة، بدلاً من تعظيم النتائج المحلية فقط؟

لهذا السبب، "القدرة على التنفيذ" لا تعني بالضرورة "القدرة على تحمل المسؤولية". فالحلقة المغلقة للبحث والتطوير ليست مجرد جمع قدرات النماذج، بل هي نتاج التكنولوجيا وتصميم العمليات وهياكل المسؤولية. من دون آليات واضحة للمساءلة والتدقيق، ستجد المؤسسات صعوبة في تفويض السلطة بأمان، حتى مع جاهزية التكنولوجيا.

المعايرة المنهجية: الاحتمالية، تحليل السيناريوهات، وحدود القرار

التصريح بأن "احتمالية %60 بحلول 2028" وسيلة فعالة للتواصل، إذ يدفع الجمهور إلى إدراك أن نافذة الوقت قد تكون أقصر مما هو متوقع. لكن في صنع القرار، يجب اعتبار هذه الأرقام احتمالات ذاتية وليست تقديرات إحصائية دقيقة. الأنسب هو تحويل الاحتمالات إلى إطار "سيناريو-عتبة".

هناك ثلاثة مستويات سيناريو أساسية:

- الأساس: الذكاء الاصطناعي متكامل بعمق في البحث والتطوير، لكن البشر يظلون أصحاب القرار الرئيسيين—نموذج "أتمتة عالية مع رجوع بشري".

- التسارع: يحقق الذكاء الاصطناعي تكرارًا شبه مغلق في عدة مجالات، ما يقصر دورات البحث والتطوير ويمنح القادة ميزة تراكمية.

- الأثر العالي: تظهر قدرات الحلقة المغلقة عبر المجالات، ويتجاوز تكرار النماذج سرعة التنظيم، وتزداد ضغوط الحوكمة.

لكل سيناريو، حدد مؤشرات عتبة واضحة بدلاً من النقاش حول سنوات معينة. أمثلة: مدة التكرار المستمر دون إشراف، معدل نجاح النقل عبر المهام، معدل استدعاء اكتشاف الشذوذ، معدل نجاح التراجع التلقائي، ونسبة التدخل اليدوي في النقاط الرئيسية. عند بلوغ العتبات، تُفعّل إجراءات الحوكمة؛ وعند انخفاضها، تُخفف القيود. هذا النهج يحول التنبؤات المجردة إلى إدارة عملية.

أثر الصناعة: كيف ستتغير منظمات البحث والتطوير

إذا ظهر RSI أو شبه RSI، سيتحول التنافس الصناعي من "أداء النماذج" إلى "العمليات المغلقة". الفوز لن يكون لمن يملك النموذج الأكبر، بل لمن يستطيع بناء دورات بحث وتطوير أقصر وأكثر استقرارًا وقابلية للتحكم داخل المؤسسات الفعلية.

ستُعاد رسم حدود المنظمات. فعمليات البحث والتطوير التقليدية—التي كانت سلسلة من الأدوار المتخصصة—ستتحول إلى شبكات تعاونية تضم "عددًا محدودًا من الكفاءات الأساسية + كيانات AI واسعة النطاق". لن تختفي الأدوار، بل ستنتقل نحو تنسيق الأنظمة وضبط الجودة وحوكمة المخاطر.

مكاسب الكفاءة ستكون غير خطية. المؤسسات التي تؤتمت العمليات أولًا ستحقق مزايا جيلية في سرعة التكرار، هيكل التكاليف، وحجم التجارب. أما من يكتفي بإدخال الذكاء الاصطناعي في مجالات محدودة، فسيشهد تحسينات تدريجية محدودة ويكافح لسد الفجوات الهيكلية.

"قدرة البحث والتطوير الموثوقة" ستصبح الخندق التنافسي الجديد. التنافسية المستقبلية ذات القيمة العالية لن تتعلق فقط بالسرعة، بل بالسرعة والأمان المثبت. ستتحول سجلات التتبع، والتجارب القابلة لإعادة الإنتاج، وتدقيق تغييرات الاستراتيجيات، وأنظمة الاستجابة للحوادث من تكاليف امتثال إلى أصول استراتيجية للثقة السوقية.

أجندة الحوكمة: تصميم مؤسسي للتحكم أثناء التسارع

مع اقتراب التسارع، يجب ألا تهدف الحوكمة إلى إيقاف التقدم، بل إلى تأسيس "إمكانية التحكم القابلة للتحقق". ويتطلب ذلك تطوير الحوكمة التقنية والمؤسسية بالتوازي.

تقنيًا، يجب دمج السلامة ضمن خط أنابيب البحث والتطوير: تسجيل افتراضي للقرارات الرئيسية، موافقة مزدوجة للعمليات عالية المخاطر، حدود بيئة تجريبية لتعديل النموذج الذاتي، ومراجعة إلزامية للقفزات غير الطبيعية في الأداء. المبدأ الأساسي: "قابلية الرصد قبل التفويض".

مؤسسيًا، اعتمد الحوكمة المتدرجة بدلًا من النهج الموحد. اسمح بالمرونة للتطبيقات منخفضة المخاطر، وفرض شفافية ومساءلة أعلى للأنظمة ذات الأثر الكبير، مع آليات للتحديث الديناميكي. القواعد الثابتة لا تواكب سرعة التكرار؛ يجب أن يكون التنظيم نفسه قادرًا على "إعادة المعايرة المستمرة".

تنظيميًا، يجب أن تكون "مرتكزات المسؤولية البشرية" واضحة. عند مشاركة الذكاء الاصطناعي في قرارات البحث والتطوير والنشر، يجب أن يكون لكل نقطة رئيسية توقيع بشري محدد وقابل للمساءلة. الأتمتة دون مرتكزات المسؤولية تزيد السرعة فقط، لا الجودة.

الخلاصة: اجتياز عصر RSI بـ"يقظة عالية ويقين منخفض"

بالعودة إلى السؤال الجوهري: هل هذا المنظور وجيه؟ الاتجاه صحيح، لكن التعبير يجب أن يكون حذرًا. هو وجيه لأنه يبرز أن الذكاء الاصطناعي يتقدم عبر أبعاد متعددة في البحث والتطوير، وأن نقطة التحول نحو الحلقة المغلقة قد تأتي أسرع من المتوقع. والحذر ضروري، لأن أي رقم أو تاريخ محدد ينطوي بالضرورة على افتراضات ذاتية ويميل إلى التقليل من الاحتكاك الواقعي.

أفضل نهج لصانعي القرار ليس التأرجح بين التفاؤل والتشاؤم، بل بناء المرونة وسط عدم اليقين:

من جهة، استعد وكأن التسارع "قد يحدث قريبًا"، لتجنب ردود الفعل السلبية في اللحظات الحاسمة. ومن جهة أخرى، قيد توسع النظام عبر سيناريوهات متدرجة، عتبات قابلة للقياس، ومرتكزات مسؤولية، لضمان بقاء نمو القدرات ضمن حدود يمكن التحكم بها.

إذا كان الطور السابق للذكاء الاصطناعي حول "تمكين الآلات من تنفيذ المهام"، فإن السؤال القادم الأهم هو: مع بدء الآلات في المساهمة بابتكار الجيل التالي من الآلات، هل تستطيع البشرية تطوير أنظمة الحوكمة والمسؤولية بالتوازي؟

هذه ليست مجرد مسألة توقعات تقنية—بل إعادة تعريف للنظام المستقبلي للابتكار.

المقالات ذات الصلة

دور Render في AI: كيف يعزز معدل التجزئة اللامركزي الابتكار في الذكاء الاصطناعي

Render و io.net و Akash: مقارنة الفروقات الأساسية بين شبكات معدل التجزئة DePIN

كيف يعمل Bittensor؟ توضيح بنية الشبكات الفرعية، المعدنين، وآلية توافق Yuma

ما هو TAO؟ استكشاف معمق لاقتصاديات رمز Bittensor، ونموذج العرض، وآليات الحوافز

بوتات التداول الذكية والأدوات