Anthropic lleva el caso a los tribunales! Acusan al gobierno de Trump de represalias por bloquear a Claude, 37 investigadores de IA apoyan

Anthropic presenta una demanda contra el gobierno federal, oponiéndose a la clasificación como riesgo en la cadena de suministro y a la suspensión de Claude por 6 meses, en medio de controversias sobre usos militares de IA y gobernanza de seguridad.

Acusación por clasificación como “riesgo en la cadena de suministro”

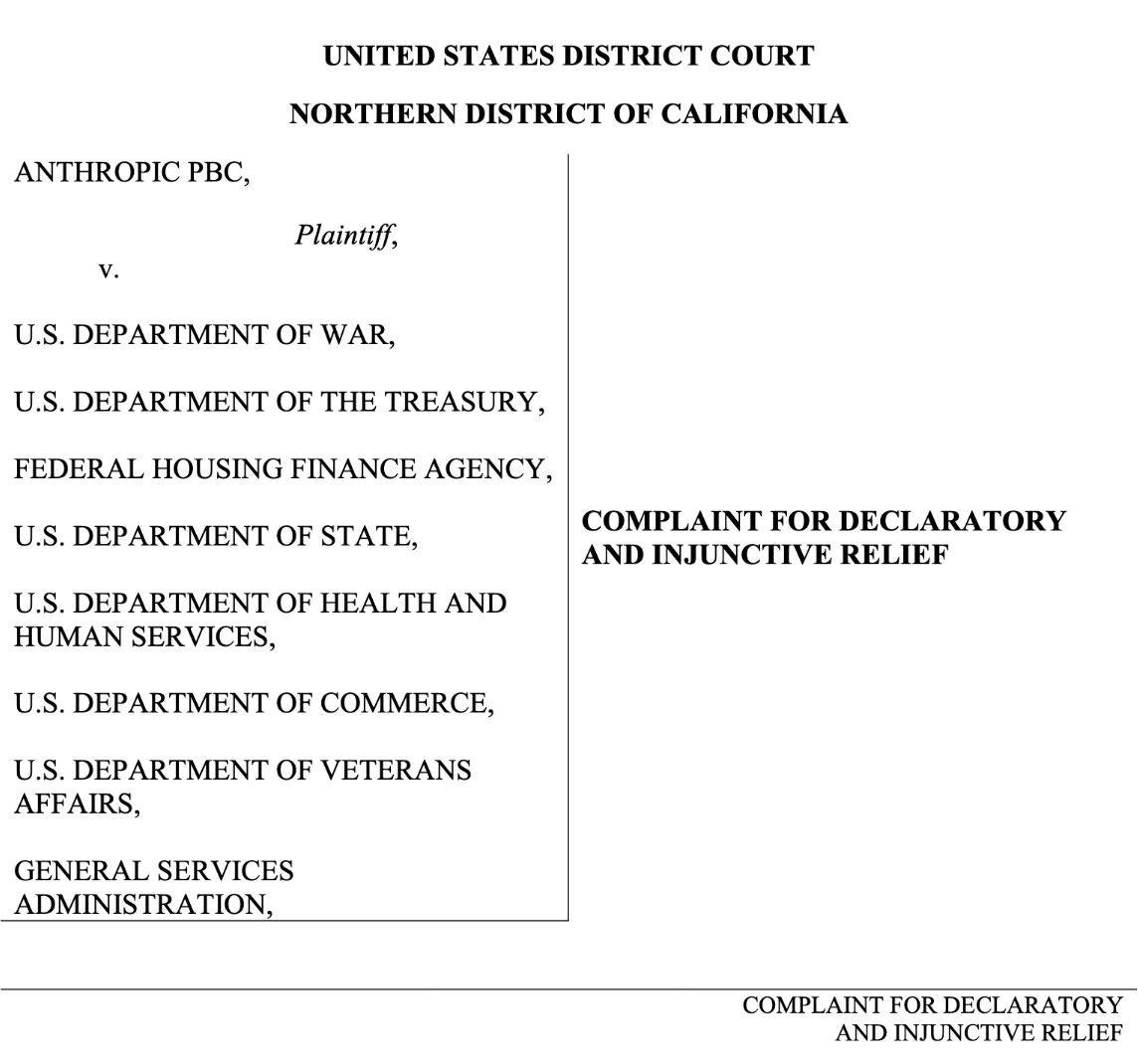

La compañía de inteligencia artificial Anthropic ha presentado una demanda ante un tribunal federal en Estados Unidos, alegando que el gobierno de Trump la clasificó como empresa de “riesgo en la cadena de suministro” y solicitando a las agencias federales que dejen de usar su sistema de IA. La compañía considera que esta medida es una represalia. La demanda ha sido presentada en la Corte Federal del Distrito Norte de California.

En la demanda, Anthropic señala que las acciones del gobierno carecen de base legal y han afectado significativamente sus operaciones y relaciones de colaboración. Los documentos judiciales incluyen a varias agencias y funcionarios como demandados, incluyendo al Departamento de Defensa, al Secretario de Defensa Pete Hegseth, al Secretario del Tesoro Scott Bessent, al Secretario de Estado Marco Rubio y al Secretario de Comercio Howard Lutnick.

Fuente: Anthropic Anthropic presenta demanda contra el gobierno federal de EE. UU., acusándolo de clasificarla como “riesgo en la cadena de suministro” y solicitando a las agencias federales que dejen de usar su sistema de IA

La etiqueta de “riesgo en la cadena de suministro” suele aplicarse a empresas tecnológicas relacionadas con países hostiles, por ejemplo, proveedores que puedan incluir spyware o malware. Anthropic señala que incluir a una empresa estadounidense de IA en esta categoría afecta claramente su reputación y sus colaboraciones comerciales. Anthropic afirma que busca aclarar la legalidad de las acciones del gobierno mediante procedimientos judiciales, protegiendo los intereses de la empresa, sus clientes y socios.

Controversia sobre usos militares de IA y ruptura en negociaciones de contratos militares

El núcleo de esta disputa radica en las diferencias entre Anthropic y el Departamento de Defensa de EE. UU. sobre el uso de tecnología de IA. Anthropic había negociado un contrato de aproximadamente 200 millones de dólares con el Pentágono. Durante las negociaciones, el Departamento de Defensa exigió que el sistema de IA pudiera usarse en todos los usos legales, incluyendo escenarios militares. Anthropic insistió en mantener dos restricciones de seguridad:

- Prohibir que su modelo de IA Claude sea utilizado para vigilancia masiva de la población estadounidense;

- Prohibir su uso en sistemas de armas letales completamente autónomas.

La compañía considera que estas restricciones son principios fundamentales para la gobernanza de la seguridad de la IA. Sin embargo, no lograron llegar a un acuerdo. En febrero de 2026, el gobierno de EE. UU. clasificó a Anthropic como empresa de riesgo en la cadena de suministro y ordenó a las agencias federales que dejaran de usar Claude en un plazo de 6 meses.

En la demanda, Anthropic afirma que el gobierno ha utilizado su poder administrativo para presionar a la empresa y forzarla a modificar sus políticas de seguridad de IA. Los abogados de la compañía sostienen que la Constitución de EE. UU. no permite que el gobierno adopte medidas punitivas por expresar públicamente su postura.

Lecturas relacionadas

Seguridad nacional vs ética: Anthropic se niega a eliminar las barreras de seguridad de Claude y enfrenta al Departamento de Defensa

Apoyo del sector tecnológico, 37 investigadores de IA presentan opiniones en la corte

El conflicto entre Anthropic y el gobierno ha generado discusión en la industria tecnológica. Poco después de presentar la demanda, 37 investigadores en IA de empresas como OpenAI y Google presentaron opiniones en apoyo a Anthropic. Estos investigadores consideran que si el gobierno penaliza a las empresas por diferencias en políticas de seguridad de IA, podría debilitar la competitividad de EE. UU. en la industria de la inteligencia artificial.

Las opiniones señalan que, si el gobierno reprime a las empresas de IA bajo el pretexto de seguridad nacional, esto tendrá efectos a largo plazo en la innovación y la investigación tecnológica. Algunos académicos también indican que la clasificación de “riesgo en la cadena de suministro” generalmente se aplica en casos relacionados con preocupaciones de seguridad de software extranjero. El caso de Anthropic no se ajusta a estos riesgos.

Ben Goertzel, CEO de la empresa de IA SingularityNET, afirma que negarse a permitir el uso de IA para vigilancia masiva o armas autónomas no representa una amenaza a la seguridad. Si el ejército necesita esas funciones, puede optar por otros sistemas de IA.

Fuente: DigFin CEO de SingularityNET, Ben Goertzel

Escalada del conflicto entre gobierno y sector tecnológico, ampliación de controversias sobre políticas de IA

Frente a la demanda, la Casa Blanca respondió rápidamente, asegurando que el gobierno no permitirá que las empresas limiten el uso de tecnologías clave por parte del ejército estadounidense. Un portavoz presidencial afirmó que EE. UU. debe garantizar que sus fuerzas militares puedan usar las tecnologías necesarias dentro del marco legal para mantener la seguridad nacional.

Esta controversia también involucra temas más amplios de política tecnológica. La administración Trump previamente relajó las restricciones a la exportación de chips de IA a China y criticó las posturas políticas de algunas empresas tecnológicas, lo que ha tensado aún más las relaciones entre Silicon Valley y Washington.

Anthropic señala que, tras ser incluida en la lista negra, algunas empresas que colaboran con el Departamento de Defensa podrían tener que demostrar que sus sistemas no usan Claude. Esta exigencia podría afectar sus relaciones comerciales.

Varias grandes empresas tecnológicas han expresado apoyo a Anthropic. Google afirmó que continuará ofreciendo la tecnología de IA de Anthropic a sus clientes en la nube, pero sin fines militares. Microsoft y Amazon también indicaron que seguirán colaborando con la compañía en el sector comercial.

Anthropic ha presentado una solicitud ante la corte para que declare ilegal la acción del gobierno y detenga la implementación de la etiqueta de “riesgo en la cadena de suministro”. Tras la entrada en proceso judicial, las discusiones sobre gobernanza de seguridad de IA, seguridad nacional y autonomía empresarial continúan ampliándose.

Lecturas relacionadas

OpenAI colabora con el ejército estadounidense en una resistencia creciente! La descarga de Claude App supera a la competencia, entendiendo las implicaciones éticas y políticas detrás

The Wall Street Journal: Tras la orden de prohibición de Anthropic por parte de Trump, EE. UU. y Israel siguen dependiendo de Claude para ataques en Irán