L’économie des tokens IA se structure : entretien exclusif avec Jensen Huang, PDG de NVIDIA, sur la puissance de calcul qui s’impose comme la « nouvelle électricité »

Lors d’une récente interview approfondie, Jensen Huang a partagé une analyse marquante : l’informatique ne représente plus un simple « coût », mais devient un « produit » générateur de valeur directe.

Ce concept, bien que parfois abstrait, s’attaque à une question fondamentale : quel est le facteur de production essentiel à l’ère de l’IA ?

En tant que fondateur de NVIDIA, Huang dispose d’un point de vue singulier. Il ne traite pas de la croissance des utilisateurs au niveau applicatif, ni de la taille des paramètres au niveau des modèles. Il s’intéresse à un niveau plus profond : l’informatique devient-elle une unité économique négociable ?

Du centre de coûts au moteur de production

À l’époque d’Internet, les centres de données avaient une fonction principale.

Ils stockaient les données, traitaient les requêtes et soutenaient les applications — ils constituaient essentiellement un poste de dépenses pour les entreprises. Que ce soit le cloud computing ou le SaaS, l’objectif était « d’optimiser la structure des coûts », sans générer directement de produits commercialisables.

L’IA a bouleversé ce modèle. Dès lors que les modèles génèrent du texte, des images, du code et réalisent des tâches complexes, chaque calcul dépasse la simple consommation de ressources : il devient « production de résultats ». Ces résultats peuvent être consommés par les utilisateurs ou directement valorisés.

Ainsi, les centres de données ne sont plus de simples centres de coûts ; ils opèrent désormais comme des usines. L’électricité, les puces et les modèles constituent leurs intrants ; le contenu, les décisions et les actions automatisées leurs extrants. Tous ces extrants sont regroupés sous une notion centrale : le Token.

Token : la plus petite unité de production à l’ère de l’IA

Dans ce contexte, Token ne désigne pas les tokens de cryptomonnaie, mais l’unité de mesure fondamentale des systèmes d’IA. Lorsque vous posez une question à un modèle, vous consommez des Tokens ; lorsque le modèle génère une réponse, il « produit » des Tokens. La tarification des API repose sur l’utilisation des Tokens.

Cela paraît technique, mais le changement réel est le suivant : pour la première fois, le calcul peut être précisément mesuré, valorisé et échangé sous forme d’unités.

Historiquement, c’est un jalon majeur. À l’ère industrielle, l’électricité est devenue une infrastructure parce qu’elle était mesurable (kilowattheures) ; à l’ère d’Internet, la bande passante et le stockage ont été commercialisés car ils pouvaient être facturés.

Aujourd’hui, l’IA transforme « l’intelligence » en une ressource mesurable. Le Token n’est plus seulement un concept technique — il devient une nouvelle « unité économique ».

Pourquoi la puissance de calcul sera consommée comme l’électricité

Huang a formulé une prévision forte lors de l’interview : à l’avenir, les dépenses liées à l’informatique pourraient représenter une part beaucoup plus importante de l’économie.

La logique rappelle l’évolution de l’électricité.

Au départ, l’électricité n’était qu’un coût industriel. Mais avec l’électrification, presque tous les secteurs sont devenus dépendants de l’électricité, qui a fini par constituer une ressource essentielle.

L’IA semble suivre une évolution similaire. À mesure qu’elle prend en charge davantage de tâches — rédaction, programmation, conception, analyse, décision — la base de ces activités repose sur la consommation de puissance de calcul et de Tokens.

Un nouveau modèle de consommation émerge :

- Les entreprises n’achètent plus seulement des logiciels ; elles « acquièrent de l’intelligence »

- Les utilisateurs n’utilisent plus simplement des outils ; ils « consomment du calcul »

- L’activité économique s’organise de plus en plus autour de la puissance de calcul

C’est le concept de « puissance de calcul assimilée à l’électricité ».

Le vrai tournant : l’explosion des coûts d’inférence

Beaucoup associent les coûts de l’IA à « l’entraînement des modèles », mais Huang a insisté sur un changement majeur : l’inférence devient le principal moteur des coûts. L’IA initiale était un outil passif — on posait une question, elle répondait, et le calcul était ponctuel. Aujourd’hui, l’IA évolue vers un système en fonctionnement continu. Avec la montée des Agents, la situation a radicalement changé :

- Une tâche n’est plus un simple appel, mais plusieurs cycles d’inférence

- Un système peut exécuter plusieurs IA simultanément

- L’IA peut appeler d’autres IA de façon autonome

Le calcul passe ainsi d’une « consommation à l’usage » à une « consommation continue ». Huang l’affirme clairement : « Penser coûte cher. »

Dès que l’IA commence à « penser », la demande en puissance de calcul ne croît plus de façon linéaire, mais exponentielle.

De la croissance des utilisateurs à celle des Agents

Si la logique de croissance à l’ère d’Internet reposait sur le « nombre d’utilisateurs », à l’ère de l’IA, elle pourrait devenir le « nombre d’Agents ». Ce changement, souvent négligé, est pourtant crucial. Les utilisateurs sont limités, alors que les Agents sont réplicables.

Un assistant IA peut gérer plusieurs tâches simultanément ; un système peut exécuter des milliers d’Agents en parallèle ; un Agent peut même générer de nouveaux Agents. Cela conduit à un nouveau modèle de croissance : la demande en puissance de calcul n’est plus déterminée par les humains, mais par le « nombre de machines ». Et le développement des machines n’a pas de plafond naturel.

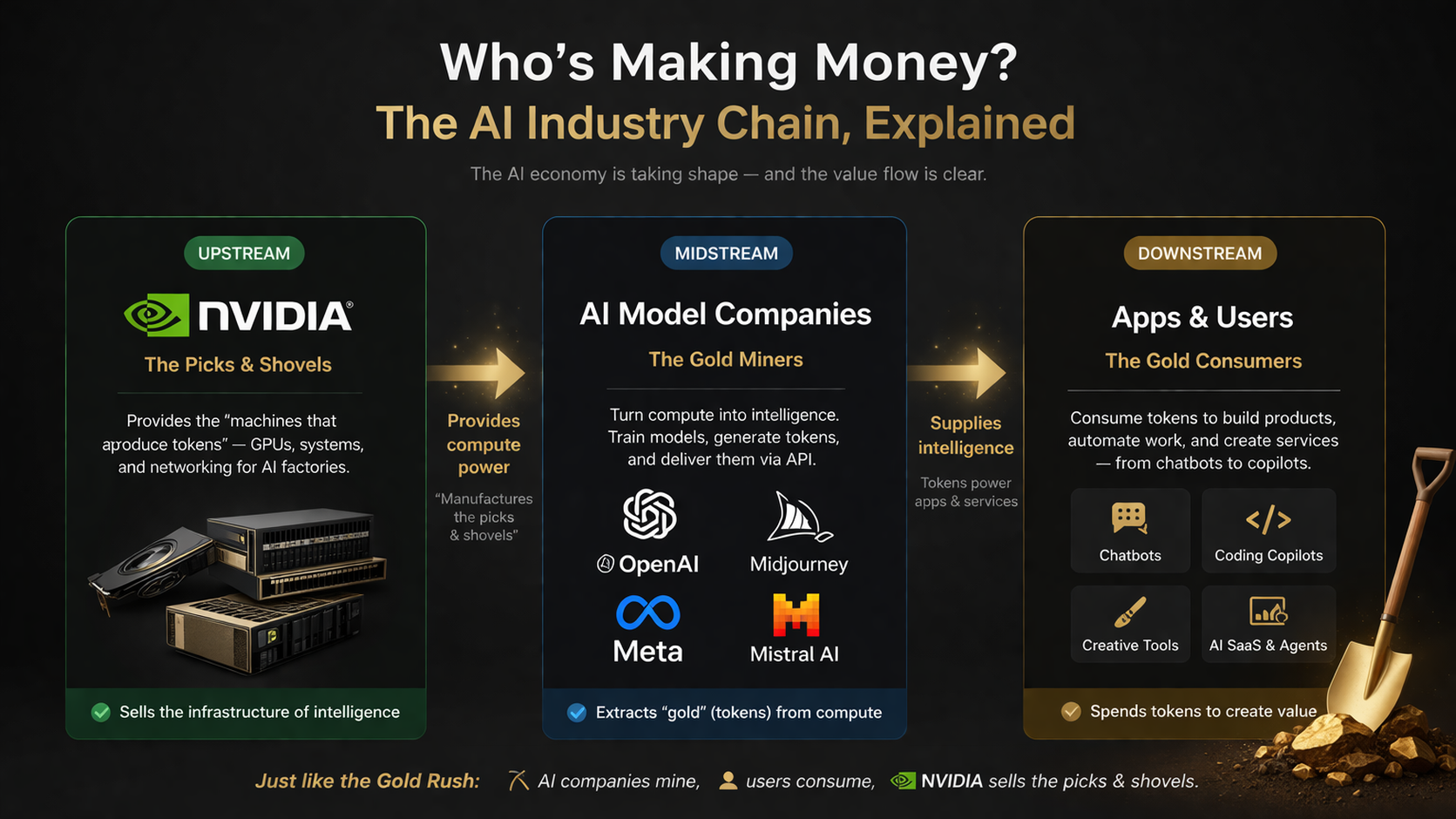

Qui en profite ? Une chaîne industrielle claire

Dans ce schéma, la chaîne industrielle de l’IA apparaît très clairement.

D’un côté, les sociétés de modèles convertissent la puissance de calcul en Tokens et les fournissent aux utilisateurs. De l’autre, la couche applicative consomme ces Tokens pour créer des produits et services. En amont, des entreprises comme NVIDIA fournissent les « machines qui produisent des Tokens ».

Ce modèle rappelle la ruée vers l’or :

- Les sociétés d’IA « exploitent de l’or »

- Les utilisateurs « consomment de l’or »

- NVIDIA « vend des pelles »

Tant qu’il y aura une demande pour « l’or », vendre des pelles restera un modèle commercial solide.

La variable négligée : l’énergie, pas les puces

Beaucoup pensent que le goulot d’étranglement de l’IA réside dans les puces, mais Huang propose une perspective différente : la contrainte réelle pourrait être l’énergie.

Selon lui, le problème n’est pas un manque d’électricité, mais une utilisation inefficace.

Les réseaux électriques classiques sont conçus pour des pics extrêmes et restent sous-utilisés la majeure partie du temps. Les centres de données IA ont l’avantage de pouvoir s’adapter dynamiquement.

Par exemple, ils peuvent réduire la performance, différer les tâches ou répartir la charge, sans impact sur le système global. Ainsi, les systèmes de puissance de calcul pourraient être plus flexibles que les systèmes électriques. Cette flexibilité deviendra un facteur clé dans la compétition future.

Un changement proche d’une révolution industrielle

En rassemblant ces éléments, une vision d’ensemble se dessine.

- Le Token transforme le calcul en une marchandise

- Les usines d’IA donnent aux centres de données des attributs de production

- Les coûts d’inférence entraînent une consommation continue de puissance de calcul

- Les Agents élargissent la demande sans limite

Ces évolutions ne constituent pas seulement une avancée technique, mais une reconstruction du modèle de production. Si Internet a transformé la circulation de l’information, l’IA transforme le « processus de production lui-même ». C’est pourquoi Huang utilise un vocabulaire proche de l’industrialisation pour décrire l’IA.

Dans sa définition, l’IA n’est pas seulement un logiciel — c’est un nouveau système de production.

Conclusion

Lorsque le calcul peut être mesuré, valorisé et échangé ; lorsque les centres de données fonctionnent comme des usines, délivrant en continu de la valeur ; lorsque la puissance de calcul est consommée comme l’électricité — tout cela converge vers une conclusion : l’IA évolue d’un outil vers une infrastructure. Dès qu’une technologie devient une infrastructure, les changements ne sont plus incrémentaux, mais structurels.

Ainsi, l’intérêt principal de l’interview ne réside pas dans la prédiction de l’avenir, mais dans le constat suivant : nous sommes peut-être déjà au point de départ de « l’industrialisation de l’IA ».

Articles Connexes

Qu'est-ce que Fartcoin ? Tout ce qu'il faut savoir sur FARTCOIN

Qu'est-ce que les récits Crypto? Top récits pour 2025 (MISE À JOUR)

Qu'est-ce que Tars AI? Explorer le futur de l'IA et de l'intégration Web3

Tout ce que vous devez savoir sur GT-Protocole

Inventaire de 12 projets d'IA sur le sous-réseau Bittensor