De la courbe de référence à la boucle fermée de recherche et développement : évaluer objectivement la probabilité de « AI recursive self-improvement » avant 2028

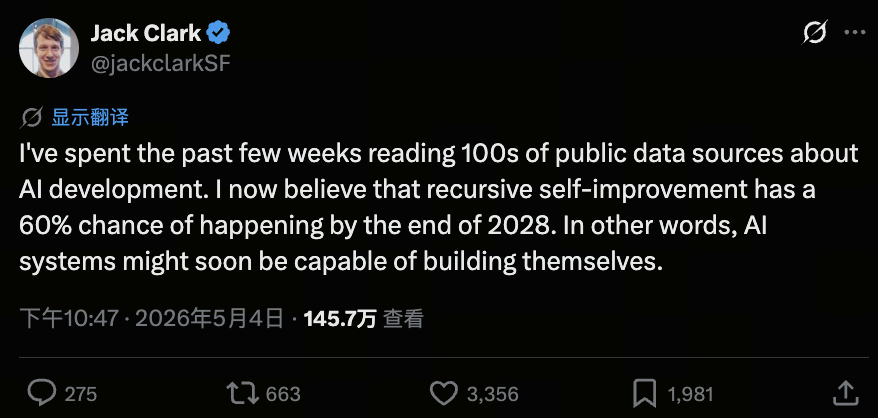

Pourquoi une « probabilité de 60 % » doit être prise au sérieux

Source de l'image : Tweet du cofondateur d'Anthropic

Source de l'image : Tweet du cofondateur d'Anthropic

Dans le domaine de l’IA, les débats privilégient souvent les conclusions au détriment du raisonnement qui les sous-tend. Ce phénomène est particulièrement marqué dans les discussions sur l’amélioration récursive autonome (Recursive Self-Improvement, RSI). En apparence, le débat porte sur une affirmation ambitieuse : d’ici 2028, il existe une forte probabilité que l’IA acquière des capacités de R&D auto-renforçantes. Mais la question fondamentale est de savoir si nous avons déjà identifié suffisamment de « signaux précoces systématiques » pour passer d’une hypothèse marginale à un risque central que les décideurs doivent désormais intégrer.

Cette interrogation est cruciale pour les politiques publiques comme pour l’industrie, car la RSI n’est pas un simple « mythe de l’intelligence générale ». C’est avant tout un défi d’ingénierie : l’IA peut-elle prendre en charge un nombre croissant d’étapes à forte valeur ajoutée dans les processus de R&D et les relier dans une boucle fermée itérative ? Une fois cette boucle établie, le rythme du progrès technologique s’accélère, l’organisation doit redéfinir ses compétences, et les cycles réglementaires traditionnels sont remis en cause.

Le débat sur la RSI doit donc dépasser l’opposition « croire ou non » pour s’attacher à la qualité des preuves, à la prudence des extrapolations et à l’adéquation des préparatifs.

Base de preuves : valeur et limites des progrès cohérents sur plusieurs benchmarks

La meilleure preuve en faveur de la RSI ne réside pas dans la performance d’un modèle isolé, mais dans la progression synchronisée sur différentes tâches, scénarios et cadres d’évaluation. Les benchmarks les plus cités — reproductibilité de la recherche, optimisation post-entraînement, résolution de problèmes compétitifs en environnement réel et défis d’ingénierie logicielle — affichent tous une tendance haussière, à des degrés divers. Leur véritable valeur réside dans leur « cohérence directionnelle » : lorsque plusieurs indicateurs progressent simultanément, cela révèle généralement une amélioration globale des capacités sous-jacentes.

Trois limites majeures doivent toutefois être prises en compte :

-

Les environnements de benchmarks diffèrent des conditions réelles. Les benchmarks offrent des limites claires, un retour d’information stable et des standards d’évaluation reproductibles. Dans la R&D réelle, on rencontre l’évolution des objectifs, la collaboration inter-équipes, le transfert de connaissances tacites, des contraintes de ressources et des frictions institutionnelles. La réussite en environnement contrôlé ne garantit pas la fiabilité des résultats en situation réelle.

-

La visibilité des métriques ne reflète pas l’ensemble des capacités. Les benchmarks actuels mesurent plus facilement la « capacité de résolution de problèmes », mais peinent à saisir les comportements de R&D plus complexes — définition des problèmes, arbitrages de priorités, attribution des échecs, gouvernance inter-cycles. Les modèles peuvent donc mieux « résoudre les bons problèmes » sans nécessairement « faire systématiquement les bons choix ».

-

L’extrapolation des tendances est vulnérable à la migration des goulots d’étranglement. L’histoire montre que le progrès technologique n’est pas linéaire. Lorsqu’un obstacle est levé, d’autres apparaissent : qualité des données, coûts de hash rate, fiabilité des systèmes, conformité ou acceptation sociale. Ignorer ces contraintes secondaires revient à surestimer les progrès et sous-estimer les résistances.

Ainsi, la progression cohérente sur plusieurs benchmarks est un signal positif, mais pas une preuve absolue. Elle indique que « la direction est importante », sans pour autant « figer l’échéance ».

Le clivage central : les progrès de capacité suffisent-ils à fermer la boucle ?

Le véritable enjeu du débat sur la RSI n’est pas de savoir si « l’IA devient plus performante », mais si « ces progrès suffisent à former une boucle fermée ». Une boucle fermée authentique implique au moins cinq étapes successives : collecte d’informations et revue de la littérature, génération d’hypothèses, conception et exécution d’expériences, évaluation des résultats et diagnostic des erreurs, adaptation de la stratégie et itération. Améliorer une étape améliore l’efficacité, mais seuls des liens robustes entre toutes les étapes permettent des retours cumulatifs.

Actuellement, les progrès sont concentrés sur les trois premières étapes et une partie de la quatrième : les modèles sont de plus en plus performants pour la génération de code, la rédaction de scripts d’expériences, la synthèse de la littérature et la recherche de paramètres. Les éléments les plus complexes de la boucle fermée reposent généralement sur deux capacités :

-

Diagnostic robuste : le système peut-il identifier précisément les causes profondes dans des données bruitées, face à des signaux contradictoires ou des échecs sporadiques, au lieu de se contenter de corrections superficielles ?

-

Alignement des objectifs : le système peut-il exécuter de façon cohérente des stratégies « efficaces à long terme mais sous-optimales à court terme » sous de multiples contraintes, plutôt que de maximiser simplement des scores locaux ?

C’est pourquoi « pouvoir faire » ne signifie pas « pouvoir être responsable ». Une boucle de R&D fermée n’est pas la simple somme des capacités d’un modèle, mais le produit de la technologie, de la conception des processus et des structures de responsabilité. Sans mécanismes clairs d’audit et de redevabilité, les organisations auront du mal à déléguer l’autorité, même si la technologie est presque prête.

Calibrage méthodologique : probabilité, scénarios et seuils de décision

Dire « 60 % d’ici 2028 » est utile pour sensibiliser — cela force à reconnaître que l’échéance pourrait être plus proche qu’on ne le pense. Mais pour la prise de décision, ces chiffres doivent être considérés comme des probabilités subjectives, non comme des estimations statistiques précises. Une approche plus opérationnelle consiste à transformer ces probabilités en un cadre « scénario-seuil ».

Trois niveaux de scénarios sont pertinents :

-

Baseline : l’IA est profondément intégrée à la R&D, mais les décisions clés restent humaines — un modèle « forte automatisation, recours humain ».

-

Accélération : l’IA atteint une itération quasi-boucle fermée dans plusieurs domaines, accélérant fortement les cycles de R&D et donnant un avantage cumulatif aux leaders.

-

Impact élevé : des capacités de boucle fermée inter-domaines émergent, l’itération des modèles dépasse l’adaptation réglementaire, et la pression sur la gouvernance s’intensifie.

Pour chaque scénario, il est essentiel de définir des métriques seuils, plutôt que de débattre d’une date précise. Par exemple : durée d’itération continue sans surveillance, taux de succès du transfert inter-tâches, taux de rappel de détection d’anomalies, taux de réussite du rollback automatique, proportion d’interventions manuelles aux points critiques. Le franchissement de ces seuils déclenche des mesures de gouvernance ; leur baisse permet d’assouplir les contraintes. Cette méthode transforme les prédictions abstraites en gestion opérationnelle.

Impact pour l’industrie : comment les organisations de R&D seront transformées

Si la RSI ou une quasi-RSI se concrétise, la compétition industrielle se déplacera de la « performance des modèles » vers les « opérations en boucle fermée ». La réussite dépendra moins de la taille du modèle que de la capacité à bâtir des cycles de R&D plus courts, plus stables et mieux contrôlés au sein des organisations.

Les frontières organisationnelles seront redéfinies. Les processus traditionnels de R&D — autrefois séquentiels et spécialisés — deviendront des réseaux collaboratifs associant « quelques personnes clés + de larges affiliés IA ». Les rôles ne disparaîtront pas : ils évolueront vers l’orchestration des systèmes, le contrôle qualité et la gouvernance des risques.

Les gains d’efficacité seront non linéaires. Les organisations qui automatisent en premier leurs processus pourront bénéficier d’un avantage générationnel en vitesse d’itération, structure de coûts et capacité d’expérimentation. Celles qui n’intègrent l’IA que de façon isolée verront des progrès plus linéaires et incrémentaux, peinant à combler les écarts structurels.

La « capacité de R&D fiable » deviendra le nouvel avantage concurrentiel. La compétitivité future ne reposera pas seulement sur la rapidité, mais sur la rapidité et la sécurité démontrable. Journaux traçables, expériences reproductibles, audits de changements stratégiques et systèmes de réponse aux incidents deviendront des atouts de confiance pour le marché, bien plus que de simples coûts de conformité.

Agenda de gouvernance : design institutionnel pour la contrôlabilité en phase d’accélération

À mesure que l’accélération devient possible, la gouvernance ne doit pas viser à freiner le progrès, mais à instaurer une « contrôlabilité vérifiable ». Cela suppose d’avancer de façon coordonnée sur les plans technique et institutionnel.

Sur le plan technique, la sécurité doit être intégrée à la chaîne de R&D : journalisation par défaut des décisions clés, double approbation pour les actions à haut risque, limites de sandbox pour l’auto-modification des modèles, revue obligatoire des sauts de performance anormaux. Le principe central : « observabilité avant délégation ».

Sur le plan institutionnel, il faut adopter une gouvernance à plusieurs niveaux — et non uniforme. Autoriser la flexibilité pour les applications à faible risque, mais exiger davantage de transparence et de responsabilité pour les systèmes à fort impact, avec des mécanismes de mise à jour dynamique. Des règles statiques ne peuvent suivre le rythme de l’itération rapide ; la régulation elle-même doit être capable de « se recalibrer en continu ».

Organisationnellement, il est indispensable d’identifier explicitement les « points d’ancrage de responsabilité humaine ». Lorsque l’IA intervient dans la R&D et les décisions de déploiement, les points critiques doivent avoir des signataires humains identifiables et responsables. L’automatisation sans ancrage de responsabilité n’augmente que la vitesse, pas la qualité.

Conclusion : naviguer dans l’ère RSI avec « grande vigilance, faible certitude »

Pour revenir à la question centrale : cette perspective est-elle valide ? La direction est pertinente, mais l’expression doit rester prudente. Elle l’est parce qu’elle met en avant la progression de l’IA sur plusieurs dimensions de la R&D, et que le point de bascule de la boucle fermée pourrait arriver plus tôt qu’on ne l’imagine. La prudence s’impose, car toute échéance ou probabilité spécifique repose sur des hypothèses subjectives et tend à sous-estimer les frictions du réel.

Pour les décideurs, la meilleure stratégie n’est pas d’osciller entre optimisme et pessimisme, mais de renforcer la résilience face à l’incertitude :

D’une part, se préparer comme si l’accélération « pouvait arriver plus tôt », pour éviter toute réaction passive lors des moments critiques. D’autre part, encadrer l’expansion des systèmes par des scénarios hiérarchisés, des seuils quantifiables et des points d’ancrage de responsabilité, afin de garantir que la montée en puissance reste maîtrisée.

Si la dernière phase de l’IA visait à « permettre aux machines d’accomplir des tâches », la question suivante, plus décisive, est la suivante : alors que les machines commencent à participer à la création de la prochaine génération de machines, l’humanité saura-t-elle adapter ses systèmes de gouvernance et de responsabilité à la même vitesse ?

Ce n’est pas seulement un exercice de prospective technique : il s’agit de redéfinir l’ordre futur de l’innovation.

Articles Connexes

USD.AI Tokenomics : analyse approfondie des cas d’utilisation du token CHIP et des mécanismes d’incitation

Analyse des sources de rendement USD.AI : comment les prêts destinés à l’infrastructure IA génèrent du rendement

Render, io.net et Akash : analyse comparative des réseaux DePIN de taux de hachage

Comment trader grâce à des compétences en crypto : de la conception de la stratégie à l’exécution automatisée

L’application de Render dans l’IA : comment le taux de hachage décentralisé dynamise l’intelligence artificielle