Grammarly pousse son expert IA à la relecture, ce qui suscite des controverses ! La communauté académique critique : non autorisé et imitation délibérée d'un chercheur décédé

Grammarly lance « Expert Review » utilisant une simulation d’experts par IA, suscitant des controverses sur l’utilisation non autorisée de noms et d’éthique académique.

Grammarly lance la fonction « Expert Review » par IA, provoquant des critiques dans le monde académique

Les outils d’intelligence artificielle continuent de s’immiscer dans l’écriture et la recherche, mais la dernière fonctionnalité « simulation d’experts par IA » a déclenché un vif débat sur l’éthique et l’autorisation. La célèbre plateforme Grammarly a récemment lancé une fonctionnalité nommée « Expert Review », permettant aux utilisateurs, lors de la rédaction, de faire simuler par IA le point de vue de chercheurs ou critiques spécifiques, pour suggérer ou commenter le contenu.

Cette fonction analyse le texte en cours de rédaction et recommande automatiquement des « experts » appropriés selon le sujet, puis génère des commentaires via un grand modèle de langage. Par exemple :

- Sur des sujets liés à la critique médiatique, le système peut imiter le style de Margaret Sullivan, ancienne éditrice en chef du « New York Times », ou de Jack Shafer, ancien journaliste de Politico, pour aider à modifier l’article.

- Sur des thèmes juridiques ou de gouvernance internet, il peut simuler l’analyse de Lawrence Lessig, professeur de droit à Harvard ; en éthique technologique ou confidentialité, il peut citer Timnit Gebru ou Helen Nissenbaum, chercheurs en éthique de l’IA et en sciences de l’information.

Grammarly précise que cette fonction ne consiste pas en une véritable revue par ces experts, mais utilise leurs publications pour générer des commentaires « inspirés de leur pensée ». La société indique que le système sélectionne automatiquement des chercheurs ou critiques influents dans le domaine, en fonction du sujet, et invite l’utilisateur à consulter leurs travaux.

Cependant, cette approche soulève de vives critiques dans le monde académique, notamment parce que certains chercheurs ont découvert que leur nom était utilisé pour des rôles d’experts IA sans leur consentement ni collaboration préalable.

Critiques pour l’utilisation non autorisée de noms, voire de chercheurs décédés

Le point le plus controversé concerne la simulation par IA du style de commentaires de chercheurs décédés. Certains universitaires dénoncent cette pratique comme une « résurrection virtuelle », utilisant leur nom pour évaluer des textes.

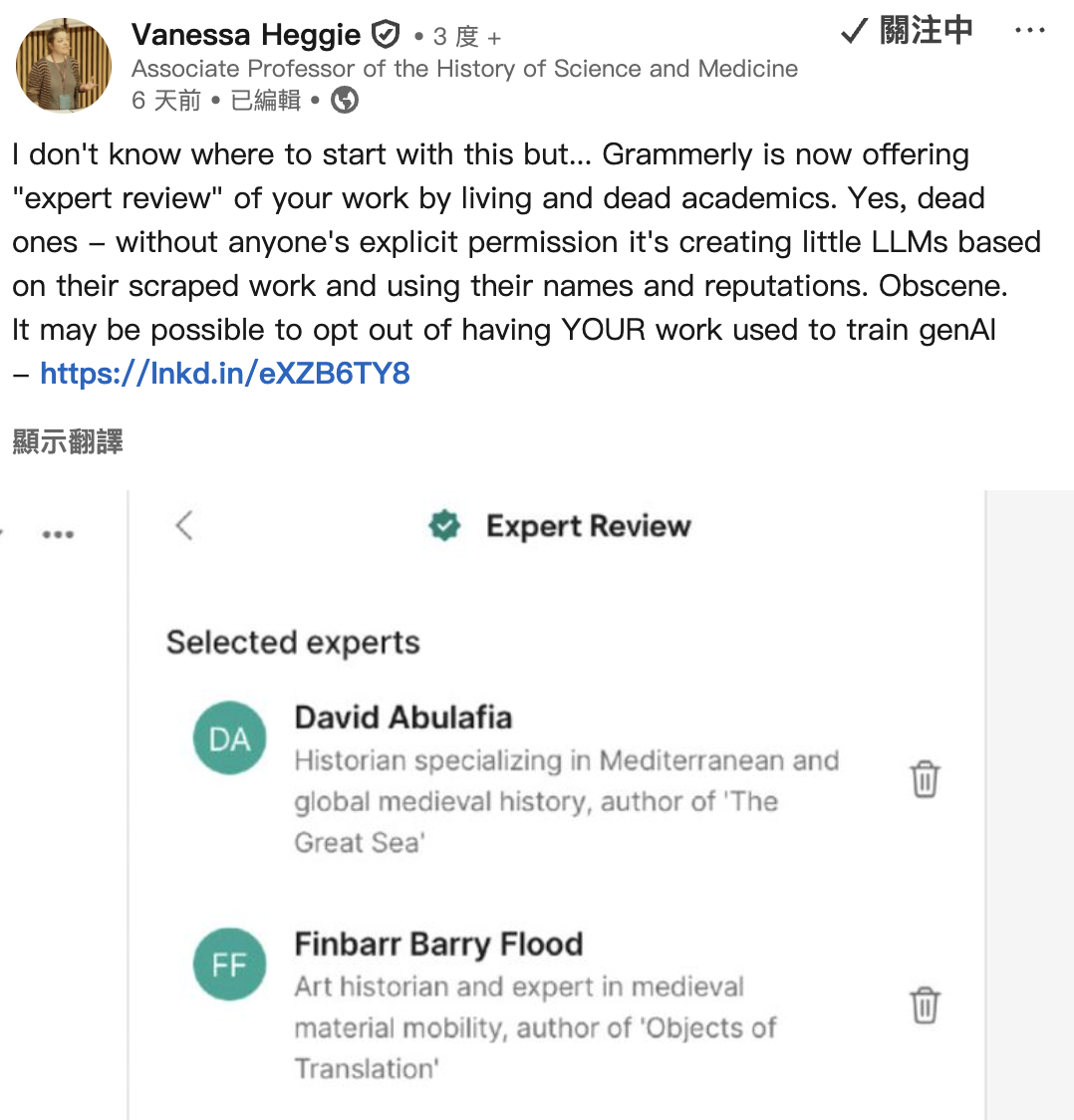

Vanessa Heggie, professeure d’histoire à l’Université de Birmingham (Royaume-Uni), a publiquement critiqué cette fonctionnalité sur LinkedIn, affirmant que Grammarly utilise les travaux de chercheurs pour entraîner ses modèles linguistiques, en utilisant leur nom et leur réputation comme rôle d’expert IA. Elle s’interroge : ces chercheurs ont-ils autorisé l’utilisation de leurs œuvres pour entraîner ces modèles ou pour fournir une « revue IA » sous leur nom ?

Source : LinkedIn Vanessa Heggie, professeure d’histoire à Birmingham, critique publiquement cette fonctionnalité

Heggie souligne que plusieurs chercheurs, voire des chercheurs décédés, sont utilisés comme « experts » par l’IA. Elle considère qu’utiliser leurs travaux et leur réputation sans consentement constitue une pratique inacceptable.

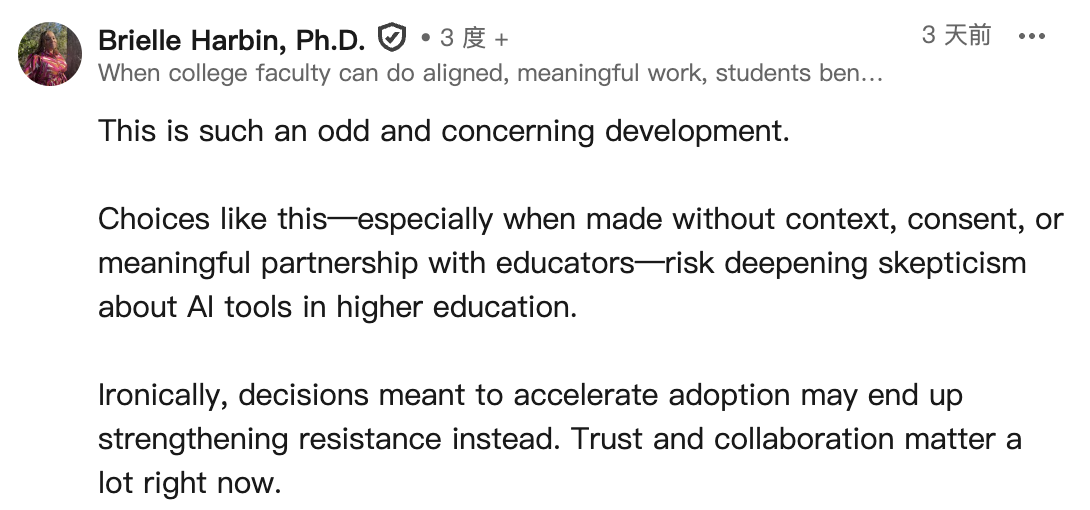

Une autre universitaire, Brielle Harbin, ancienne professeure adjointe de sciences politiques à l’Académie navale américaine, a également exprimé son malaise. Elle indique qu’en absence de transparence, d’autorisation ou de partenariat, la création de modèles de commentaires sous le nom de chercheurs par des entreprises IA pourrait renforcer la méfiance dans le secteur éducatif.

Source : LinkedIn Brielle Harbin, ancienne professeure adjointe à l’Académie navale américaine, partage ses inquiétudes

Harbin estime que le secteur de l’enseignement supérieur reste prudent face à l’IA. Si les entreprises technologiques ignorent la collaboration et l’éthique dans la conception de leurs produits, cela pourrait provoquer une opposition accrue plutôt qu’une adoption accélérée.

Grammarly se repositionne comme plateforme IA, l’assistant d’écriture évolue vers un agent de productivité

Créée en 2009, Grammarly était initialement un outil d’assistance grammaticale et rédactionnelle basé sur l’IA. Avec l’évolution rapide de l’IA générative, la société a progressivement transformé ses produits d’un simple assistant d’écriture en une plateforme multifonctionnelle de productivité IA. En octobre 2025, la société mère a annoncé un rebranding, passant sous le nom de « Superhuman », symbolisant que ses produits ne se limitent plus à la correction grammaticale, mais incluent une série d’agents IA pour diverses tâches.

Aujourd’hui, la gamme de produits s’étend à la recherche, la rédaction d’e-mails, la gestion d’agenda et l’automatisation des flux de travail. « Expert Review » est l’un des nouveaux agents IA lancés. Selon la société, cette fonctionnalité vise à aider étudiants, chercheurs et professionnels à améliorer la qualité de leurs écrits. Par exemple, lors de la rédaction de propositions marketing, rapports académiques ou documents commerciaux, le système analyse le contenu et fournit des commentaires simulant ceux d’un expert.

L’entreprise insiste sur le fait que cette fonction ne prétend pas que ces experts ont réellement participé à la revue, ni que leur approbation est donnée, mais qu’elle synthétise leurs travaux pour proposer des recommandations.

Cependant, cette « simulation de perspective d’expert » est critiquée pour risquer d’induire en erreur l’utilisateur, qui pourrait croire que ces commentaires sont directement liés aux chercheurs eux-mêmes.

L’imitation de célébrités par IA, nouvelle tendance dans la tech

Grammarly n’est pas la seule entreprise à tenter de simuler des figures célèbres ou des chercheurs par IA. Plusieurs sociétés technologiques ont lancé des produits similaires, espérant tirer parti de l’image de personnalités connues pour enrichir l’interaction IA.

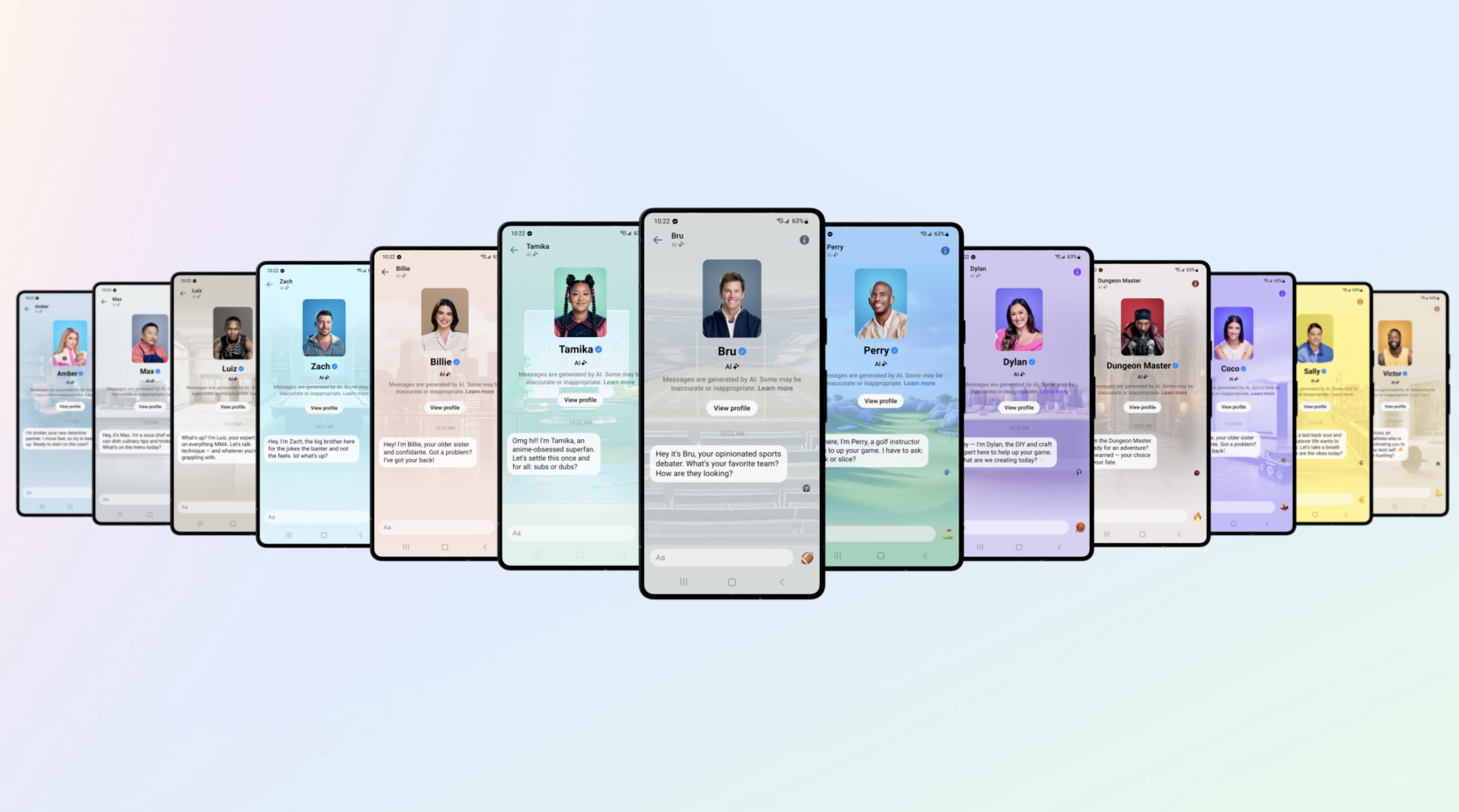

En 2023, Meta a lancé une série de chatbots de célébrités sur sa plateforme Meta AI, incluant des versions de Snoop Dogg, Tom Brady, Kendall Jenner ou Naomi Osaka. Ces IA, utilisant l’image et le ton des célébrités, ont pour but d’attirer les utilisateurs à expérimenter la conversation avec l’IA.

Source : Meta a lancé une série de chatbots de célébrités sur sa plateforme Meta AI

Le secteur de l’éducation a également adopté cette tendance. La plateforme d’apprentissage en ligne Khan Academy a lancé « Khanmigo », un assistant IA permettant aux étudiants d’incarner des personnages historiques. Par exemple, ils peuvent dialoguer avec Winston Churchill ou Harriet Tubman pour mieux comprendre l’histoire et la pensée de ces figures.

Cependant, à mesure que les modèles IA deviennent plus capables de simuler le style personnel, les questions de consentement et de droits à la personnalité se font plus pressantes. Certains experts soulignent que lorsque l’IA adopte la voix ou l’image d’un chercheur, écrivain ou célébrité, cela peut influencer la perception publique de leur point de vue. La communauté académique estime que si les entreprises veulent utiliser la pensée ou l’image de chercheurs ou de figures publiques, elles devront mettre en place des mécanismes d’autorisation plus clairs et transparents. Sinon, même si cela reste une « source d’inspiration », cela pourrait poser des problèmes de réputation, de propriété intellectuelle et d’éthique académique.