AIトークンエコノミーが本格化:NVIDIAのCEO、ジェンスン・フアン氏への独占インタビューで、コンピューティングパワーが「新たな電力」として台頭する現状を深掘り

最近のインタビューで、Jensen Huang氏は「コンピューティングは“コスト”から、価値を直接生み出す“プロダクト”へと変化している」と明言しました。

この考え方は一見抽象的に思えるかもしれませんが、AI時代の本質的な問い——「生産の中核要素は何か?」——に迫るものです。

NVIDIA創業者としてのHuang氏の視点は独自です。彼はアプリケーション層のユーザー成長やモデル層のパラメータ規模を語るのではなく、コンピューティング自体が取引可能な経済単位となるかという基盤を再定義しています。

コストセンターから生産エンジンへ

インターネット時代、データセンターの役割は明快でした。

データの保存、リクエスト処理、アプリケーションのサポート——企業のコスト構造の一部として機能していました。クラウドコンピューティングやSaaSも「コスト構造の最適化」が主目的で、直接的な販売アウトプットを生むものではありませんでした。

AIがこの構図を一変させました。モデルがテキストや画像、コードを生成し複雑なタスクを実行できるようになると、各計算は単なるリソース消費ではなく「成果の生産」へと変わりました。これらの成果はユーザーが消費したり、直接価格が付けられたりします。

この変化により、データセンターは単なるコストセンターではなく、工場のような役割を担うようになったのです。投入されるのは電力・チップ・モデル、アウトプットはコンテンツ・意思決定・自動化アクションです。これらすべてのアウトプットは、「Token」という一つの概念に集約されます。

Token:AI時代の最小生産単位

ここでいうTokenは暗号資産のトークンではなく、AIシステムの基本的な計測単位です。モデルに質問すればTokenを消費し、モデルが回答を生成すればTokenが「生産」されます。API料金もToken消費量に基づいて設定されています。

これは技術的な細部のように聞こえるかもしれませんが、真の変化はコンピューティングが初めて、正確に計測・価格付け・取引できる単位となったことです。

歴史的に見ても、これは重要な転換点です。産業時代には電力が(kWhで)計測可能となりインフラとなり、インターネット時代には帯域幅やストレージが課金対象となり商業化されました。

今、AIは「知能」自体を計測可能な資源へと変えました。Tokenは単なる技術概念ではなく、新たな「経済単位」として登場しています。

なぜ計算資源は電力のように消費されるのか

Huang氏はインタビューで大胆な予測を示しました。将来的には計算資源への支出が経済の中で大きな割合を占める可能性があるというものです。

その論理は電力の発展と似ています。

電力が登場した当初は単なる産業コストでしたが、電化が進むとあらゆる産業が電力に依存し、最終的には不可欠な基盤資源となりました。

AIも同じ道をたどるかもしれません。より多くの業務がAIで処理される——執筆、コーディング、設計、分析、意思決定——その本質は計算資源とTokenの消費です。

こうして新たな消費構造が生まれます。

- 企業は単なるソフトウェア購入から「知能の購入」へ

- ユーザーは単なるツール利用から「計算資源の消費」へ

- 経済活動は計算資源中心へとシフト

これが「計算資源=電力」という概念です。

真の転換点:推論コストの急増

多くの人はAIコストを「モデルの学習」と捉えますが、Huang氏はこのインタビューで推論が主要なコスト要因になりつつあると繰り返し強調しました。初期のAIは受動的なツールで、問いかければ答えるという離散的な計算でしたが、今やAIは継続稼働型のシステムへと進化しています。特にAgentの台頭で状況は大きく変わりました。

- タスクは一度の呼び出しではなく複数回の推論で構成される

- システムは複数のAIを同時に稼働できる

- AIが他のAIを自律的に呼び出すことも可能

これにより、計算は「都度消費」から「継続的消費」へと移行しました。Huang氏の言葉通り、「思考は高コスト」です。

AIが「思考」し始めると、計算資源への需要は線形ではなく指数関数的に増加します。

ユーザー成長からAgent成長へ

インターネット時代の成長指標が「ユーザー数」だったのに対し、AI時代は「Agent数」が鍵になるかもしれません。これは見落とされがちですが、極めて重要な変化です。ユーザーは有限ですが、Agentは複製可能です。

AIアシスタントは複数のタスクを同時にこなし、システムは数千のAgentを同時稼働でき、Agent自身が新たなAgentを生み出すことも可能です。これにより新たな成長モデルが生まれます。計算資源需要はもはや人間ではなく「機械の数」で決まるのです。そして機械の成長には上限がありません。

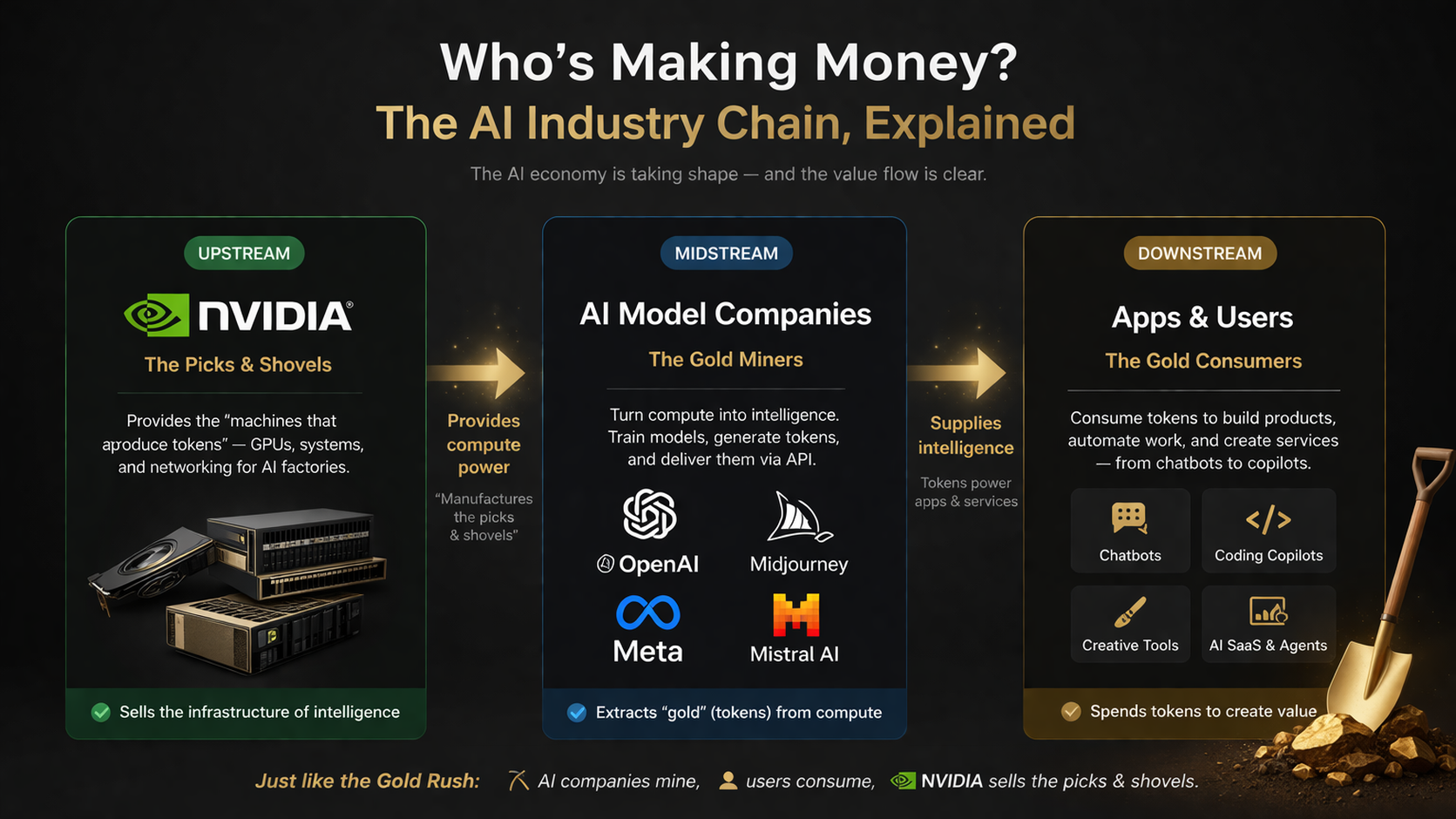

誰が利益を得るのか?明確な産業チェーン

この構造の中で、AI産業チェーン全体が非常に明確になります。

一端には、計算資源をTokenに変換してユーザーに提供するモデル企業があります。もう一端には、これらのTokenを消費して製品やサービスを構築するアプリケーション層があります。上流にはNVIDIAのような「Tokenを生産する機械」を供給する企業があります。

この構図はゴールドラッシュ時代を彷彿とさせます。

- AI企業は「金を採掘」

- ユーザーは「金を消費」

- NVIDIAは「シャベルを売る」

「金」への需要がある限り、シャベルを売るビジネスは強いままです。

見落とされがちな変数:チップではなくエネルギー

多くの人はAIのボトルネックをチップだと考えていますが、Huang氏はインタビューでより本質的な視点を示しました。本当の制約はエネルギーかもしれません。

ただし、彼の見解は「電力が足りない」のではなく、「利用効率が低い」という点です。

従来の電力網は極端なピーク需要に合わせて設計されており、大半の時間は遊休状態です。AIデータセンターにはダイナミックな調整能力という強みがあります。

たとえば、性能を下げたり、タスクを遅らせたり、ワークロードを移したりしても、全体のシステムには大きな影響を与えません。つまり、計算資源システムは電力システムより柔軟性が高い可能性があるのです。この柔軟性が今後の競争の鍵となります。

産業革命に近づく変化

これらの要素を組み合わせると、より大きなビジョンが見えてきます。

- Tokenが計算資源をコモディティ化

- AIファクトリーがデータセンターに生産属性を付与

- 推論コストが計算資源の継続的消費を促進

- Agentが需要を無限に拡大

これらの変化は単なる技術的アップグレードではなく、生産モデルそのものの再構築です。インターネットが情報流通を変えたように、AIは「生産プロセス自体」を変革しています。だからこそHuang氏は、AIを産業化を想起させる言葉で語るのです。

Huang氏の定義では、AIはソフトウェアではなく、新たな生産システムです。

結論

コンピューティングが計測・価格付け・取引され、データセンターが工場のように価値を継続的に提供し、計算資源が電力のように消費される——こうしたすべての流れが示すのは、AIがツールからインフラへと進化しているということです。テクノロジーがインフラになると、その変化は漸進的ではなく、構造的なものとなります。

この観点から見ると、このインタビューの本質は未来予測ではなく、私たちはすでに「AI産業化」のスタート地点にいるという判断にあるのかもしれません。

関連記事

Fartcoinとは何か?FARTCOINについて知っておくべきすべて

AIエージェントが暗号資産を主流にする方法

VirtualsのAIXBTとは何ですか?AIXBTについて知る必要があるすべてのこと

Virtuals Protocol: AIエージェントのトークン化

クリプトナラティブとは何ですか?2025年のトップナラティブ(更新版)