GrammarlyのAI専門家による校正が議論を呼ぶ!学界からは、無許可で故人の学者を意図的に模倣していると批判の声

Grammarlyは「Expert Review」を導入し、AIによる学者模擬コメントを行い、未許可の名前使用や学術倫理の問題を引き起こしている。

GrammarlyがAI「専門家レビュー」機能を導入、学界から疑問の声

人工知能ツールは執筆や研究産業に浸透し続けているが、最新の「AIによる専門家模擬コメント」機能は、倫理や許可の問題について激しい議論を呼んでいる。著名なライティングツールのGrammarlyは最近、「Expert Review」というAI機能をリリースし、ユーザーが文書作成時にAIを使って特定の学者や評論者の視点を模擬し、内容に対して提案やコメントを行えるようにした。

この機能は、ユーザーが作成中のテキストを分析し、テーマに基づいて適切な「専門家」を自動推薦し、その後大規模言語モデルを用いてコメントを生成する。例として:

- メディア評論に関するテーマでは、システムが『ニューヨーク・タイムズ』の元公共編集者マーガレット・サリバンやPoliticoの元メディアジャーナリストジャック・シャーファーの意見スタイルを引用し、文章修正を支援。

- 法律やインターネットガバナンスの話題では、ハーバード大学のローレンス・レスリッグ教授の分析手法を模擬し、テクノロジー倫理や情報プライバシーでは、AI倫理研究者のティムニット・ゲブルやコーネルテックのヘレン・ニッセンバウム教授の見解を引用。

Grammarlyは、この機能は実際にこれらの専門家が審稿しているわけではなく、公開された研究や論文をもとに「彼らの思想に触発された」コメントを生成していると説明している。システムはテーマに応じて影響力のある学者や評論家を自動選択し、その作品を読むよう促す仕組みだ。

しかしながら、この設計は学界から強い批判を招いている。特に、いくつかの学者は自分の名前がAIの評論役として使われていることに気づき、事前に許可や協力を得ていなかったと指摘している。

学者は無許可の名義使用や故人の模擬に批判

最も議論を呼んでいるのは、AIツールが故人の学者の評論スタイルを模擬している点だ。ある学者は、「これはまるで『AIによる学者の復活』のようであり、その名義で評価を行うことは問題だ」と述べている。

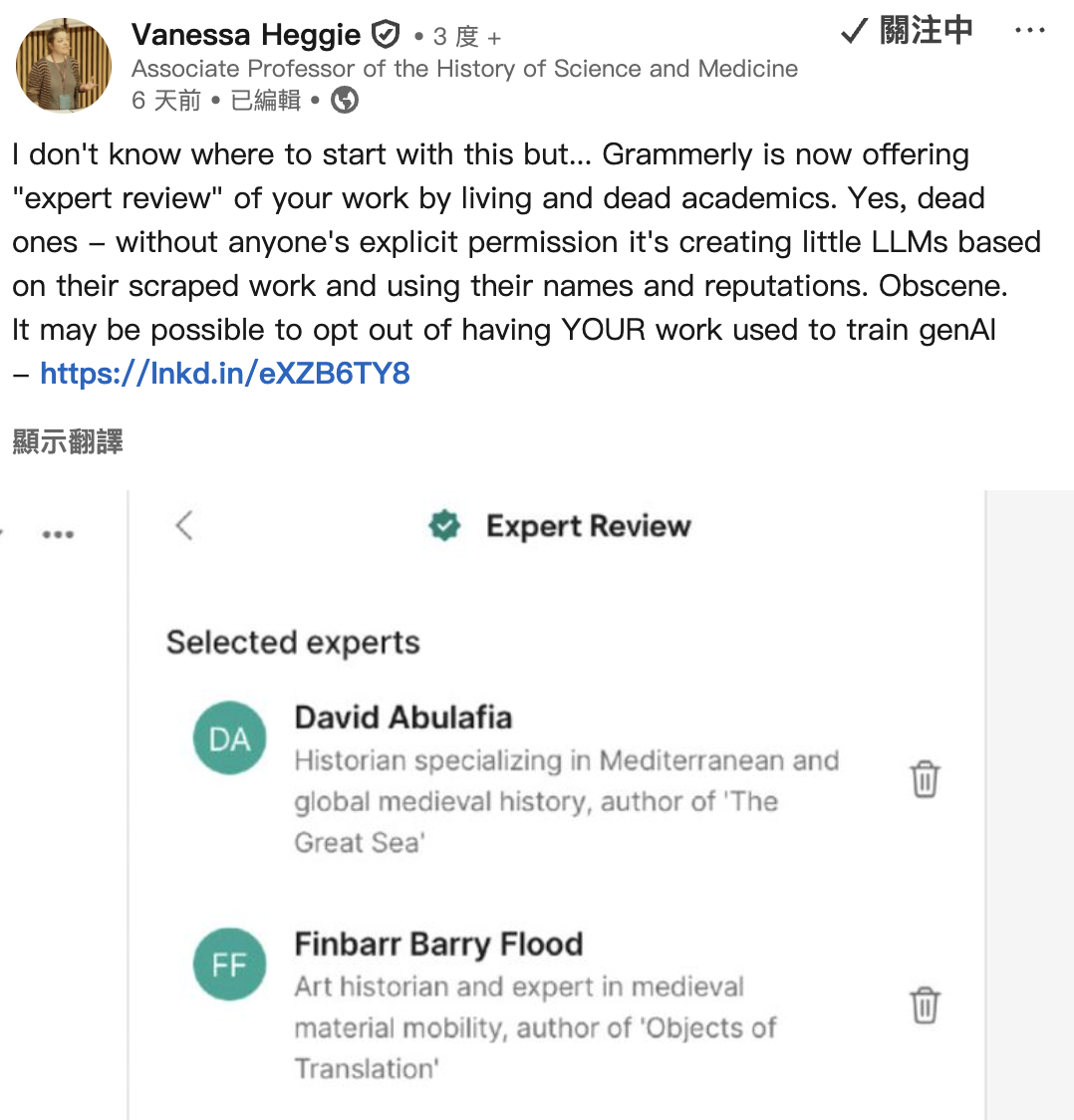

英国バーミンガム大学の歴史学教授ヴァネッサ・ヘギーはLinkedIn上でこの機能を公然と批判し、Grammarlyが学者の研究成果を用いて言語モデルを構築し、その名前と評判をAIの評論役として使っていると指摘した。彼女は、これらの学者が自分の作品をモデル訓練に使うことや、「AIによる審稿」に自身の名前を提供することを許可したのか疑問を呈している。

画像出典:LinkedIn 英国バーミンガム大学歴史学教授ヴァネッサ・ヘギーがLinkedInでこの機能を批判

ヘギーは、多くの学者がすでに亡くなっているにもかかわらず、その名前がAIの評論役として使われていることに懸念を示している。彼女は、許可なく学者の研究や学術的名声を利用してAIモデルを構築する行為は受け入れ難いと述べている。

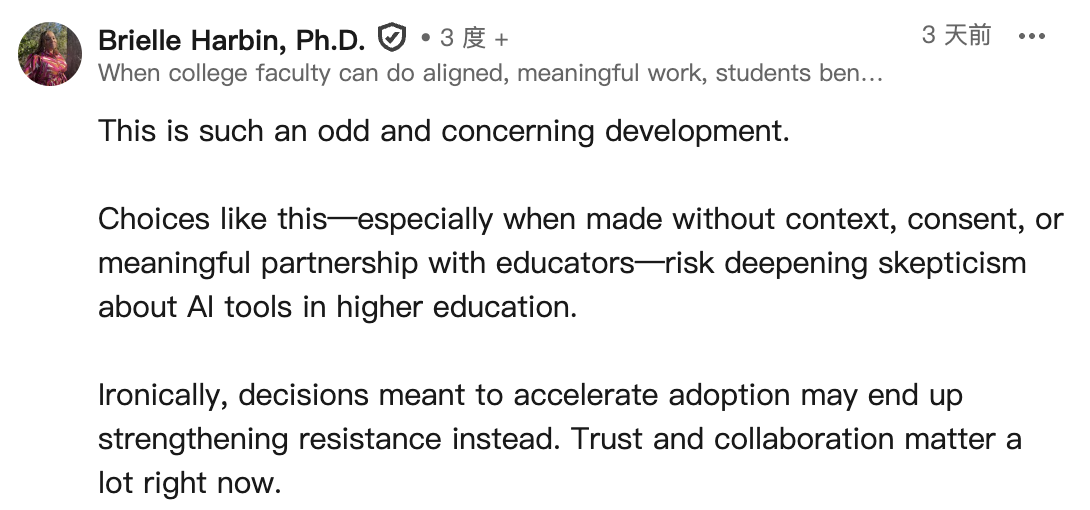

もう一人の学者、元米海軍士官学校政治学准教授のブリエル・ハービンも、この機能に対して不安を表明している。彼女は、背景説明や許可、協力関係なしに、AI企業が学者の名義で評論モデルを作成することは、教育界のAIツールに対する信頼をさらに損なう可能性があると指摘している。

画像出典:LinkedIn 元米海軍士官学校政治学准教授ブリエル・ハービンもこの点に懸念

ハービンは、現在高等教育界はAIツールに対して慎重な姿勢を取っているとし、テクノロジー企業が学界との協力や倫理的配慮を無視して製品を設計すれば、AI採用を促進したい決定が逆に反発を招く恐れがあると警告している。

GrammarlyはAIプラットフォームへと変貌、ライティングアシスタントは生産性代理へ

Grammarlyは2009年に最初にリリースされ、当初はAIによる文法・ライティング支援ツールとして位置付けられた。生成型AI技術の急速な発展に伴い、近年は単なるライティングアシスタントから多機能なAI生産性プラットフォームへと進化している。2025年10月、Grammarlyの親会社はブランドのリブランディングを発表し、企業のポジショニングを「Superhuman」に変更。これは、同社の製品がもはや文法チェックだけでなく、さまざまなAI作業代理(AI Agents)へと進化したことを示す。

現在、同社の製品ラインは研究支援、メール作成、スケジュール管理、ワークフロー自動化など多岐にわたる。Expert Reviewもその新たなAI代理サービスの一つだ。公式説明によると、Expert Reviewは学生、研究者、専門家の文章改善を支援することを目的としている。例えば、マーケティング提案書、学術レポート、ビジネス文書を作成する際に、システムが内容を分析し、模擬専門家のコメントを提供する。

同社は、この機能は実在の専門家が審稿しているわけではなく、あくまで大規模言語モデルを用いて関連研究成果を整理し提案しているに過ぎないと強調している。

しかしながら、「専門家の視点を模擬する」この設計は、誤解を招きやすく、これらのコメントが学者本人と直接関係していると誤認させる可能性があるとの批判もある。

AIによる有名人模擬はテック業界の新潮流

Grammarlyだけでなく、他のAI企業も有名人や学者の模擬に挑戦している。近年、多くのテック企業が類似の製品を展開し、有名人物のイメージを活用してAIのインタラクション体験を向上させようとしている。

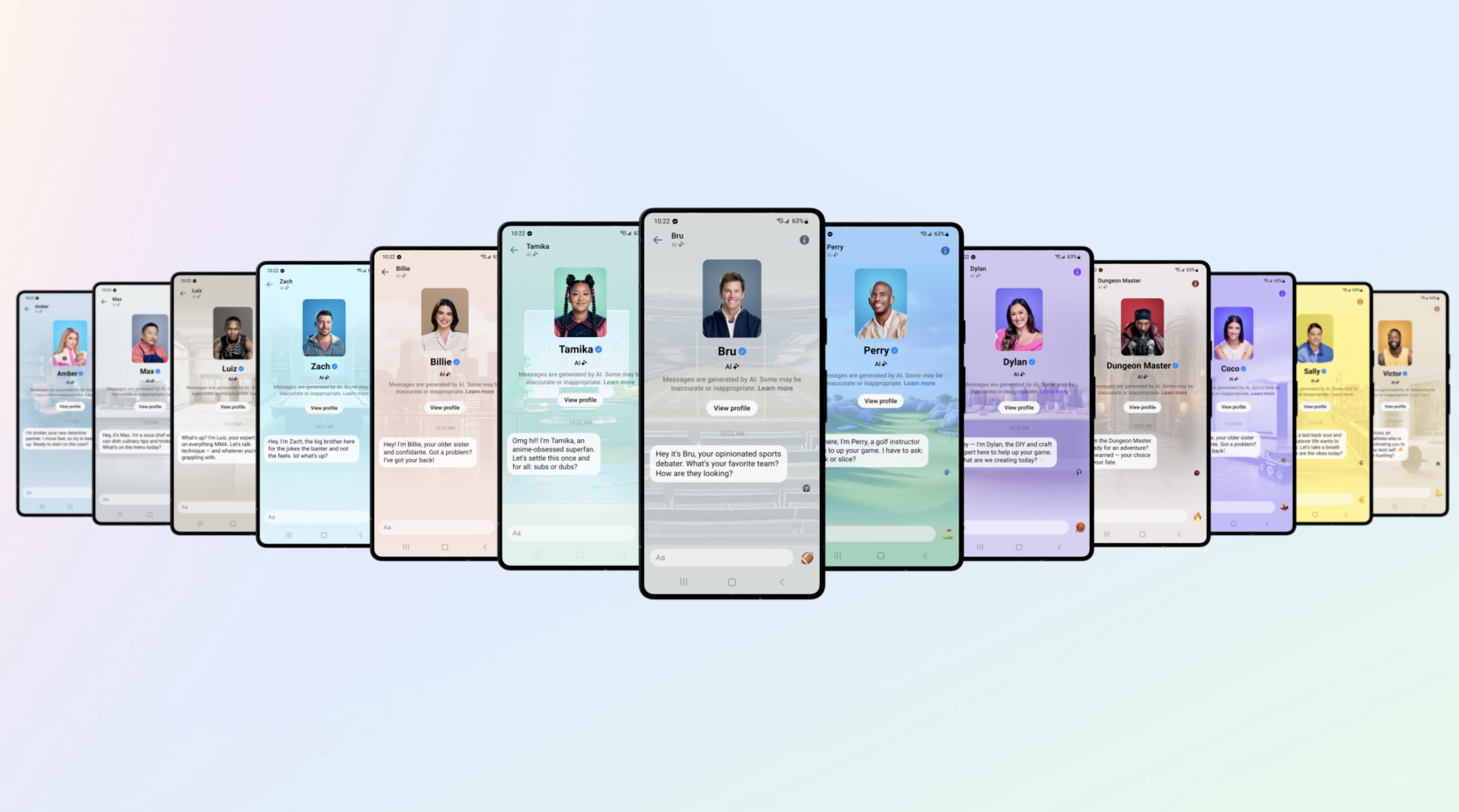

2023年、MetaはMeta AIプラットフォーム向けに、ラッパーのSnoop Dogg、NFLスターのトム・ブレイディ、モデルのケンダル・ジェンナー、テニス選手の大坂なおみなどを原型とした名人チャットボットをリリースした。これらのAIキャラクターは有名人のイメージと語調を模倣し、ユーザーのAIチャット体験を促進している。

画像出典:Meta MetaはMeta AIプラットフォーム向けに名人チャットボットを展開

教育分野でも類似の動きが見られる。オンライン教育プラットフォームのKhan Academyは、AIアシスタント「Khanmigo」を導入し、学生が歴史上の人物とロールプレイ的に対話できる仕組みを提供している。例えば、学生はウィンストン・チャーチルやハリエット・タブマンと模擬対話を行い、歴史背景や思想を理解する。

しかし、AIモデルが個人のスタイルを模倣できるようになるにつれ、許可や人格権に関する議論も高まっている。**一部の専門家は、AIが学者や作家、著名人の名義で意見を提供する場合、その人物の見解に対する理解に影響を与える可能性があると指摘している。**学界では、今後AI企業が学者や著名人の思想やイメージを使用する際には、より明確な許可や透明性のある説明が必要になると考えられている。さもなければ、「インスピレーション源」であっても、名誉毀損や知的財産権、学術倫理に関わる複雑な問題に発展しかねない。