Bagaimana cara kerja Dolphin Network? Analisis menyeluruh mengenai proses inferensi AI terdesentralisasi secara lengkap.

Perkembangan pesat model AI mendorong lonjakan permintaan GPU secara global. Ketika model bahasa besar (LLM), Agen AI, dan aplikasi otomatisasi semakin berkembang, platform cloud AI terpusat tradisional menghadapi tantangan biaya tinggi, konsentrasi sumber daya, dan tekanan skalabilitas. Dalam situasi ini, jaringan GPU terdesentralisasi menjadi arah utama bagi infrastruktur AI Web3.

Dolphin Network merupakan jaringan inference AI yang dikembangkan untuk menjawab tren tersebut. Tujuan utamanya adalah mengumpulkan sumber daya GPU yang tersebar di seluruh dunia ke dalam infrastruktur AI terbuka, serta mengoordinasikan pengembang, node GPU, dan jaringan melalui mekanisme insentif POD.

Apa Struktur Inti Dolphin Network?

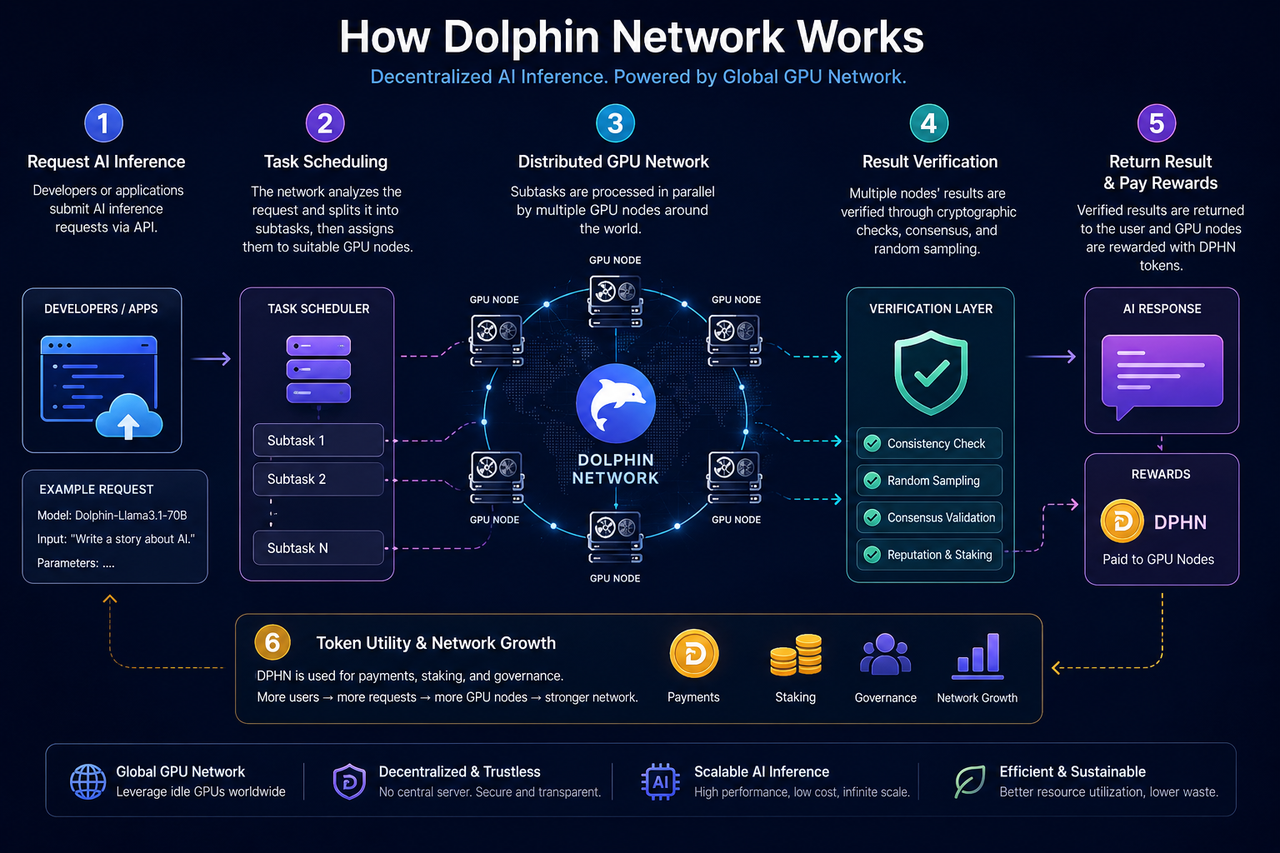

Arsitektur inti Dolphin Network terdiri atas tiga komponen: pengaju permintaan inference AI, jaringan node GPU, dan mekanisme verifikasi-koordinasi.

Pengembang atau aplikasi dapat mengirimkan permintaan inference AI—seperti generasi teks, inference chat, pemanggilan model, atau tugas Agen AI—ke jaringan. Sistem secara dinamis mengalokasikan permintaan ke node yang sesuai berdasarkan status node GPU, kebutuhan tugas, dan ketersediaan sumber daya.

Node GPU berasal dari kontribusi pengguna global. Peserta dapat bergabung dengan jaringan menggunakan GPU idle, menjalankan tugas inference secara lokal, dan mendapatkan hadiah token sesuai kontribusi mereka.

Untuk menjaga integritas hasil, Dolphin menerapkan mekanisme verifikasi dan ekonomi yang mengoordinasikan perilaku node, termasuk sampling acak, peninjauan tugas, dan sistem staking.

Bagaimana Permintaan Inference AI Masuk ke Jaringan?

Saat pengembang berinteraksi dengan Dolphin Network, permintaan pertama kali diarahkan ke lapisan penjadwalan tugas.

Lapisan ini menganalisis jenis tugas, kebutuhan GPU, dan sumber daya model. Setiap model AI mungkin memerlukan konfigurasi memori, kecepatan inference, dan daya komputasi yang berbeda, sehingga jaringan secara dinamis mencocokkan permintaan ke node berdasarkan status mereka.

Pada platform cloud AI terpusat, proses ini dikelola oleh satu pusat data. Di Dolphin, tugas didistribusikan ke jaringan node GPU terdesentralisasi.

Beberapa tugas dapat dipecah menjadi permintaan inference yang lebih kecil untuk meningkatkan efisiensi dan concurrency jaringan.

Bagaimana Node GPU Memproses Tugas Inference AI?

Node GPU merupakan sumber daya komputasi utama Dolphin Network.

Operator node biasanya menginstal perangkat lunak khusus dan mengizinkan sistem menggunakan GPU lokal untuk tugas inference AI. Ketika tugas diberikan, node mengunduh model atau parameter inference yang relevan dan melakukan komputasi secara lokal.

Setelah selesai, node mengirimkan hasil inference ke jaringan dan menunggu proses verifikasi untuk memastikan validitas hasil. Hanya tugas yang lolos verifikasi yang berhak mendapatkan hadiah token.

Pendekatan ini berbeda dengan penambangan GPU tradisional. Jika jaringan PoW berfokus pada komputasi hash, node GPU Dolphin menjalankan tugas inference AI nyata, sehingga lebih menyerupai “marketplace hash power yang tersedia.”

Bagaimana Dolphin Memverifikasi Hasil Inference AI?

Inference AI berbeda dengan transaksi blockchain standar, karena hasilnya tidak bisa divalidasi dengan rumus matematika sederhana. Dolphin mengandalkan mekanisme tambahan untuk mencegah node mengirimkan hasil yang salah.

Metode umum adalah sampling acak—memilih tugas secara acak untuk ditinjau agar memastikan konsistensi hasil di beberapa node. Pengiriman data abnormal secara berulang dapat menurunkan reputasi node atau mendiskualifikasinya dari hadiah.

Beberapa jaringan AI terdesentralisasi juga menerapkan staking. Node harus melakukan stake token untuk berpartisipasi, dan perilaku berbahaya dapat menyebabkan penalti pada aset di-stake.

Insentif ekonomi ini dirancang untuk menyelaraskan perilaku node dan meningkatkan kredibilitas jaringan.

Apa Perbedaan Dolphin dengan Inference Cloud AI Tradisional?

Platform cloud AI tradisional biasanya mengandalkan pusat data besar yang terpusat—entitas tunggal mengontrol klaster GPU, deployment model, dan layanan API.

Dolphin mengusung arsitektur jaringan GPU terbuka. Node GPU berasal dari pengguna global, sehingga pengembang dapat mengakses layanan inference AI di lingkungan yang lebih terbuka dan tidak bergantung pada satu penyedia.

Dolphin juga mengedepankan model AI terbuka dan berbagi sumber daya. Beberapa jaringan mendukung deployment model open-source, aturan sistem kustom, dan skenario Agen AI terbuka.

Namun, jaringan AI terdistribusi menghadapi tantangan seperti stabilitas, latensi jaringan, dan variasi kualitas node, sehingga masih berada pada tahap awal pengembangan.

Tantangan Apa yang Dihadapi Dolphin Network?

Jaringan inference AI terdesentralisasi menawarkan keterbukaan dan berbagi sumber daya, namun menghadapi tantangan praktis.

Performa node GPU sangat bervariasi. Perbedaan memori hardware, bandwidth, dan kemampuan inference dapat memengaruhi stabilitas jaringan secara keseluruhan.

Verifikasi hasil inference AI juga tetap kompleks. Tidak seperti transaksi blockchain, output AI bersifat probabilistik, sehingga meningkatkan biaya verifikasi.

Seiring model AI semakin besar, penjadwalan klaster GPU berskala besar secara efisien di lingkungan terdistribusi menjadi tantangan utama bagi proyek AI DePIN.

Ketidakpastian regulasi menjadi faktor lain. Model AI terbuka dapat menimbulkan kekhawatiran terkait data, hak cipta, dan generasi konten, sehingga jaringan infrastruktur AI harus menghadapi risiko regulasi jangka panjang.

Ringkasan

Dolphin Network adalah jaringan inference AI terdesentralisasi yang menggabungkan AI dan DePIN, dengan tujuan membangun infrastruktur AI terbuka menggunakan node GPU global. Jaringan ini mengoordinasikan pengembang dan node GPU melalui penjadwalan tugas, inference terdistribusi, verifikasi acak, dan mekanisme insentif DPHN.

Dibandingkan platform cloud AI terpusat tradisional, Dolphin menekankan keterbukaan, berbagi sumber daya, dan ketahanan terhadap sensor, sehingga menjadi arah utama untuk infrastruktur AI Web3.

FAQ

Bagaimana Dolphin Memanfaatkan Node GPU?

Holder GPU dapat menginstal node dan menyumbangkan sumber daya GPU idle untuk menjalankan tugas inference AI serta memperoleh hadiah DPHN.

Apa Tahapan dalam Proses Inference AI Dolphin?

Tahapan utama meliputi pengajuan tugas, penjadwalan node, eksekusi inference GPU, verifikasi hasil, dan distribusi hadiah.

Mengapa Dolphin Dianggap Sebagai Proyek DePIN?

Sumber daya intinya adalah hardware GPU dunia nyata, dan jaringan ini mengoordinasikan infrastruktur terdistribusi melalui insentif berbasis token.

Apa Perbedaan Dolphin dengan Platform Cloud AI Tradisional?

Platform cloud AI tradisional mengandalkan pusat data terpusat; Dolphin menggunakan jaringan GPU terbuka untuk menyediakan layanan inference AI terdistribusi.

Apa Peran DPHN dalam Jaringan?

DPHN digunakan untuk pembayaran inference AI, hadiah node, staking, dan sebagai insentif ekonomi dalam jaringan.

Artikel Terkait

Tokenomik USD.AI: Analisis Kedalaman Kasus Penggunaan Token CHIP dan Mekanisme Insentif

Analisis Sumber Keuntungan USD.AI: Cara Pinjaman Infrastruktur AI Menghasilkan Keuntungan

Analisis Kedalaman Audiera GameFi: Cara Dance-to-Earn Memadukan AI dengan Permainan Ritme

Apa itu privacy smart contract? Bagaimana Aztec mengimplementasikan programmable privacy?

Aztec vs Zcash vs Tornado Cash: Analisis Komparatif Perbedaan Utama dalam Tiga Solusi Privasi