Anthropic denuncia al gobierno de Trump: la etiqueta de "riesgo en la cadena de suministro" es una represalia ilegal

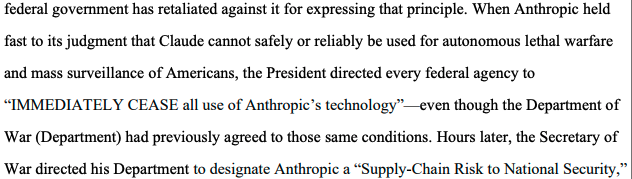

La empresa desarrolladora del software de inteligencia artificial Claude, Anthropic, presentó una demanda el lunes en un tribunal federal en California contra el gobierno de Trump, acusando al gobierno de lanzar una “acción de represalia ilegal” debido a que Anthropic se negó a permitir que el ejército utilizara su tecnología sin restricciones, incluyendo su uso en armas autónomas letales y vigilancia masiva interna. Es la primera vez en la historia de Estados Unidos que una empresa nacional es considerada un riesgo en la cadena de suministro militar.

Etiqueta de riesgo en la cadena de suministro: reconocimiento sin precedentes del Pentágono

El inicio de esta batalla legal fue una decisión final del 3 de marzo de 2026 del Secretario de Defensa Pete Hegseth, que clasificó a Anthropic como una empresa de riesgo en la cadena de suministro militar. Las consecuencias legales de esta clasificación son directas y severas: cualquier persona o empresa que tenga negocios con el ejército no podrá realizar transacciones con Anthropic, lo que equivale a expulsarla completamente del mercado de adquisiciones federales.

Cabe destacar que, hasta ahora, este tipo de clasificación de riesgo en la cadena de suministro solo se había aplicado a empresas relacionadas con fuerzas hostiles extranjeras, nunca a empresas estadounidenses. Anthropic calificó esta acción en la demanda como “una medida sin precedentes e ilegal” y afirmó: “La Constitución no permite que el gobierno utilice su enorme poder para castigar a una empresa por su discurso protegido.”

El proceso legal cuenta con una amplia lista de acusados, incluyendo a Pete Hegseth (Secretario de Defensa), Scott Bessent (Secretario del Tesoro), Marco Rubio (Secretario de Estado) y otros 17 organismos y funcionarios gubernamentales, abarcando varios departamentos clave del gobierno federal de EE. UU.

La línea roja de Anthropic: armas letales y vigilancia masiva

(Fuente: CourtListener)

(Fuente: CourtListener)

Según lo declarado por Anthropic en la demanda, Hegseth exigió a la compañía “renunciar completamente a sus restricciones de uso”, pero Anthropic se negó porque esas restricciones forman parte de su contrato con el gobierno, y están diseñadas para evitar que Claude sea utilizado en dos usos específicos:

Sistemas de armas autónomas letales: sistemas de decisión de matar automatizados que no requieren la confirmación final humana.

Vigilancia masiva de ciudadanos estadounidenses: recopilación y análisis a gran escala de datos personales de ciudadanos mediante IA.

Anthropic afirmó claramente en la demanda: “Anthropic nunca ha probado Claude para estos usos. Actualmente, Anthropic no está segura de si Claude puede operar de manera confiable o segura si se usa para apoyar guerras autónomas letales.”

Esta postura coincide con los principios de seguridad de IA que Anthropic ha mantenido durante mucho tiempo, pero entra en conflicto fundamental con la política del gobierno de Trump de ampliar el uso de IA en el ámbito militar. Es importante señalar que desde 2024, el gobierno de EE. UU. y el Pentágono han estado utilizando tecnología de Anthropic, y Claude es la primera IA desplegada en entornos confidenciales. La clasificación también vino acompañada de una orden ejecutiva de Trump que prohíbe a los empleados federales usar Claude.

Apoyo colectivo de ingenieros de OpenAI y Google: respuesta de la industria de IA

Tras el estallido de la batalla legal, la reacción en la industria de IA fue rápida y amplia. El lunes, más de 30 ingenieros y científicos de OpenAI y Google, incluido Jeff Dean, director científico de Google, presentaron un amicus brief en apoyo a Anthropic.

Estos profesionales advirtieron en el documento: “Permitir que continúe esta acción punitiva contra una de las principales empresas de IA en EE. UU. sin duda afectará negativamente la competitividad industrial y científica de EE. UU. en inteligencia artificial y otros campos.” La preocupación subyacente es más amplia: si el gobierno puede usar la clasificación de riesgo en la cadena de suministro para reprimir a las empresas nacionales de IA, podría debilitar la ventaja competitiva de EE. UU. frente a China en la carrera global de IA.

Preguntas frecuentes

¿Qué impacto específico tiene la etiqueta de riesgo en la cadena de suministro en Anthropic?

Según la ley estadounidense, ser clasificado como empresa de riesgo en la cadena de suministro significa que cualquier persona o entidad que tenga negocios con el ejército no puede realizar transacciones con la empresa clasificada. Esto equivale a eliminar a Anthropic del ecosistema de adquisiciones federales, afectando no solo contratos militares directos, sino también a todos los proveedores y socios que tengan relación con el gobierno.

¿Por qué Anthropic se niega a permitir usos relacionados con armas letales?

La postura de Anthropic es que Claude nunca ha sido probado ni evaluado para escenarios de armas autónomas letales, y actualmente no puede garantizar su fiabilidad o seguridad en tales aplicaciones. Además, los principios de seguridad de IA de la compañía se oponen a desplegar sistemas de decisión autónoma de alto riesgo sin pruebas exhaustivas, especialmente en contextos militares que involucran vidas humanas.

¿Qué significa el apoyo de ingenieros de Google y OpenAI a Anthropic?

El respaldo de más de 30 ingenieros y científicos de empresas competidoras refleja la profunda preocupación de la industria de IA por la posible interferencia del gobierno mediante la clasificación en la cadena de suministro. Su apoyo apunta a un interés común: si el gobierno puede usar estas herramientas para reprimir a empresas de IA que no se ajusten a sus restricciones, cualquier compañía que se niegue a abrir sus tecnologías podría enfrentarse a un destino similar.