Se não compreender a inteligência artificial até ao final deste conteúdo, a próxima década irá deixá-lo desorientado

A maioria das pessoas considera que a IA é apenas um chatbot.

Compreendo o raciocínio: abre o ChatGPT, pede para corrigir um e-mail e obtém o resultado. Parece magia. Sai convencido de que percebe o processo. Mas isso equivale a passar um cartão de crédito num restaurante e pensar que sabe como a Visa gera receitas. Usou o produto, mas não viu o sistema.

Dediquei grande parte do último ano a tentar perceber para onde realmente flui o dinheiro na IA, e o mais honesto é admitir que demorei demasiado tempo a deixar de olhar para o nível errado. Fixei-me no ChatGPT, no Claude e no Gemini, nas ferramentas acessíveis, enquanto 700 mil milhões de dólares eram silenciosamente investidos em infraestruturas que nem sabia nomear. Chips desconhecidos. Tecnologias de embalagem com siglas quase fictícias. Sistemas de arrefecimento. Centrais elétricas. Está a ser derramado betão no Texas, Iowa e Hyderabad.

Ninguém que conheço discutia estes temas há um ano. Agora, discutem.

Este artigo é extenso. Se não tem disponibilidade neste momento, guarde-o nos favoritos e regresse mais tarde. Quero percorrer toda a cadeia de valor da IA, camada a camada, desde a eletricidade que alimenta os centros de dados até à aplicação no seu telemóvel, e quero fazê-lo de forma compreensível, mesmo para quem nunca leu um relatório anual.

Explicarei o jargão à medida que o utilizar. Associarei números reais a cada afirmação. E serei transparente sobre as áreas em que ainda não tenho certezas, porque são algumas.

Vamos começar.

I - O bolo de cinco camadas (e porque ninguém discute as quatro de baixo)

A IA é infraestrutura. Tal como a internet, tal como a eletricidade, precisa de fábricas. ~ Jensen Huang

A maioria das pessoas entende a IA como: um computador inteligente responde a perguntas.

É como dizer que a internet é "um sítio para ver vídeos". Não está tecnicamente errado, mas perde o essencial.

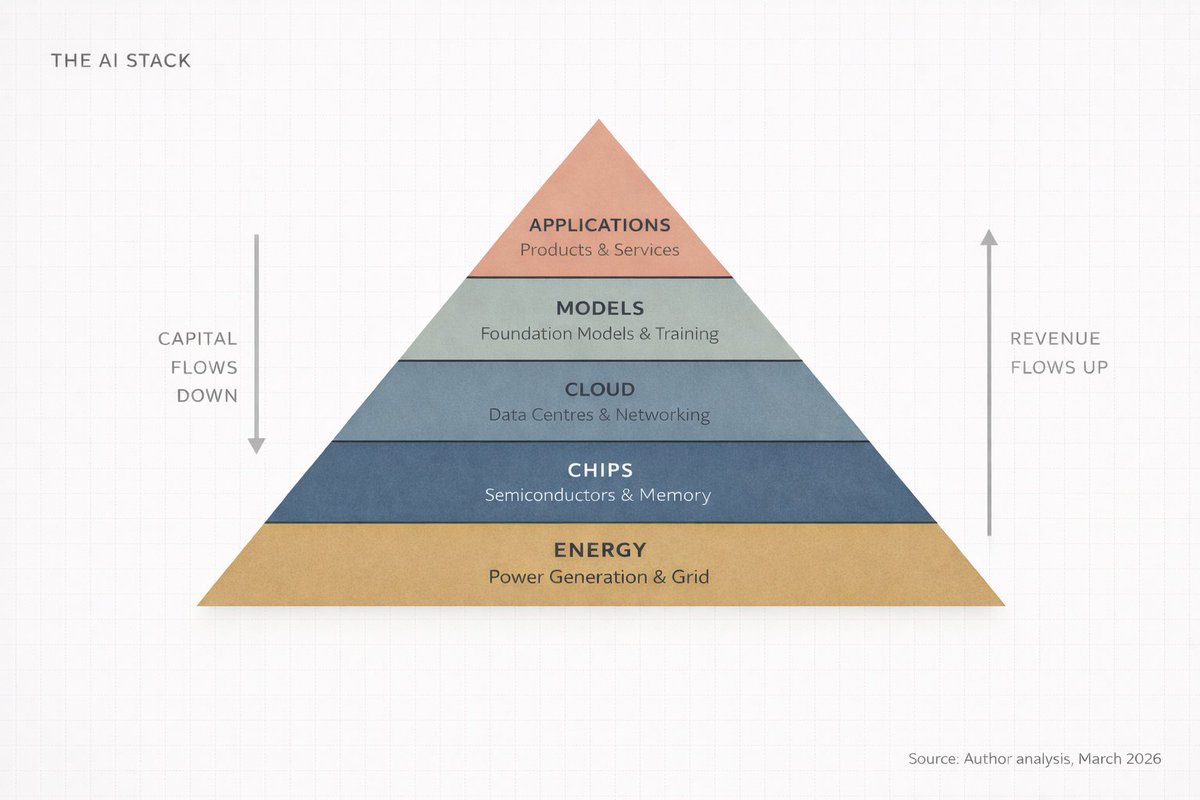

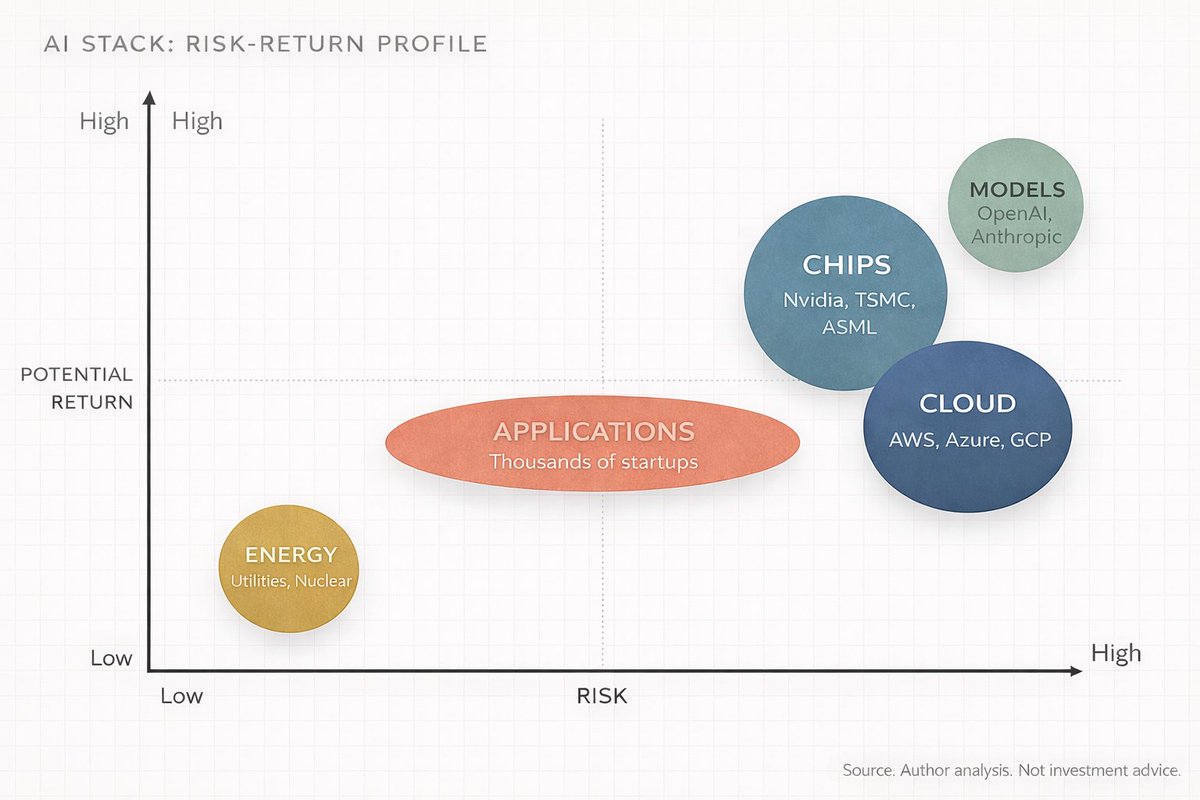

Jensen Huang, CEO da Nvidia, descreveu a IA em Davos, em janeiro de 2026, como um sistema de cinco camadas: energia, chips, cloud, modelos e aplicações. Chamou-lhe "a maior construção de infraestrutura da história da humanidade".

Reflita sobre o conceito: infraestrutura. Estradas, redes elétricas, sistemas de água. São os elementos que sustentam a civilização, e só se pensa neles quando falham. A IA está a tornar-se esse tipo de elemento. Invisível, indispensável e extremamente dispendiosa de construir.

Chamo a isto o Stack da IA. Cinco camadas, dispostas em sequência, em que cada uma alimenta a seguinte, e o dinheiro circula nos dois sentidos.

Aqui está a versão mais simples:

- Energia. É necessária eletricidade para alimentar os computadores. Muita.

- Chips. São necessários processadores especializados para os cálculos. Não são o cérebro do seu portátil.

- Cloud. São precisos armazéns gigantes repletos destes chips, ligados por redes ultrarrápidas.

- Modelos. É o software de IA, o "cérebro" que aprende padrões a partir de dados.

- Aplicações. Produtos que as pessoas realmente utilizam: ChatGPT, Pesquisa Google, o detector de fraude do seu banco.

Focar-se apenas na Camada 5 equivale a ignorar 80% da realidade.

E aqui está o ponto crucial para investidores, fundadores ou qualquer pessoa a tentar perceber o futuro: o dinheiro não flui de forma homogénea entre estas camadas. Concentra-se, compõe-se e, neste momento, está a concentrar-se em áreas onde poucos olham.

II - Siga o dinheiro (não está onde imagina)

A mente de todos vai para a camada das aplicações. ChatGPT, Copilot, Claude, Perplexity. São os produtos tangíveis, por isso parecem ser toda a história.

Mas há um elemento que todos ignoram.

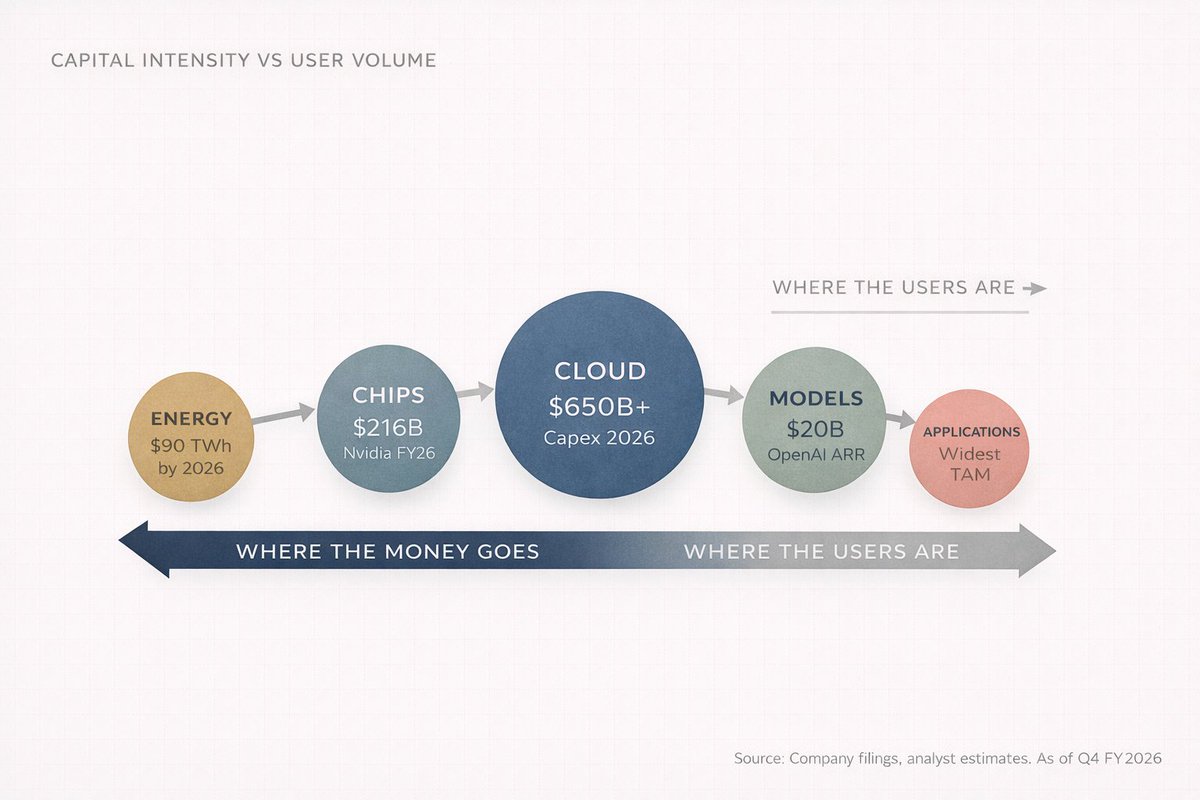

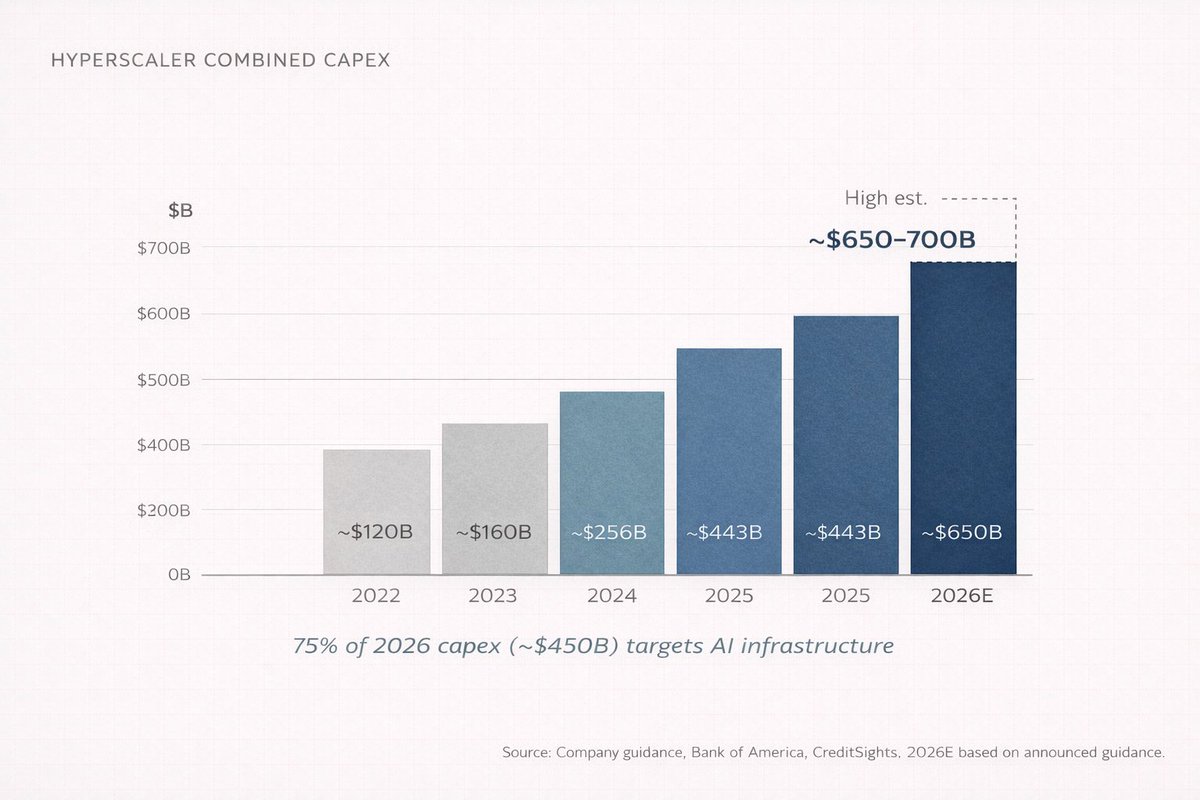

Em 2026, as quatro maiores empresas cloud (Amazon, Microsoft, Google e Meta) preveem gastar entre 650 mil milhões e 700 mil milhões de dólares em despesas de capital. Juntas. Num único ano. É quase equivalente ao PIB da Suíça. E quase 75% desse valor, cerca de 450 mil milhões, destina-se diretamente à infraestrutura de IA.

Não para chatbots. Não para aplicações. Para edifícios, chips, cabos e sistemas de arrefecimento.

Ninguém discute isto em eventos sociais. É por aí que se percebe onde está o dinheiro.

Reflita: antes de alguém poder usar o ChatGPT, alguém tem de construir um centro de dados do tamanho de um centro comercial, enchê-lo com dezenas de milhares de processadores especializados, ligá-los com equipamentos de rede que valem mais do que muitas empresas, e fornecer energia suficiente para alimentar uma pequena cidade. Todos os dias.

Isto abrange da Camada 1 à Camada 3. As camadas invisíveis. Onde o capital substancial é aplicado.

"E a OpenAI? Não estão a gerar milhares de milhões?"

Estão. A OpenAI alcançou 20 mil milhões de dólares de receitas recorrentes anualizadas no final de 2025, subindo de 6 mil milhões um ano antes e 2 mil milhões no anterior. É um crescimento de 10 vezes em dois anos. Nunca uma empresa escalou receitas tão rapidamente a partir dessa base.

Mas há um detalhe. A OpenAI queimou cerca de 9 mil milhões de dólares em caixa em 2025 e prevê uma queima de 17 mil milhões em 2026. Os custos de inferência (o custo de executar a IA quando faz uma pergunta) atingiram 8,4 mil milhões em 2025 e prevêem chegar a 14,1 mil milhões em 2026. Não esperam tornar-se positivos em fluxo de caixa antes de 2029 ou 2030.

Para onde vai esse dinheiro?

Desce pelo stack. Para a Microsoft Azure (a OpenAI paga à Microsoft 20% das receitas totais até 2032). Para a Nvidia pelos chips. Para as empresas que constroem e equipam centros de dados. Para as companhias de eletricidade.

Há uma circularidade notável: a Microsoft investe na OpenAI; a OpenAI gasta esse dinheiro na Azure; a Azure usa as receitas para comprar mais chips Nvidia; a NVIDIA reporta lucros recorde; todos celebram; e o dinheiro continua a descer.

A maioria dos utilizadores está no topo do stack. A maioria do lucro está na base. Essa desconexão é a essência da tese.

Primeira lição da cadeia de valor da IA: as receitas sobem, o capital desce.

III - Já viu este filme

Todos os problemas da humanidade são problemas de engenharia, e problemas de engenharia podem ser resolvidos. ~ Buckminster Fuller

Para perceber o que está a acontecer com a IA, estude o que aconteceu com a eletricidade entre 1880 e 1920.

Quando Thomas Edison construiu a primeira central elétrica comercial em 1882, na Pearl Street em Manhattan, a eletricidade era vista como uma curiosidade. Uma forma sofisticada de iluminar uma sala. Para quê, se os candeeiros a gás funcionavam?

Em 40 anos, a eletricidade reorganizou todas as indústrias. Fabrico, transportes, comunicações, medicina, entretenimento. As empresas vencedoras não foram as que inventaram a lâmpada, mas as que construíram centrais, instalaram fios de cobre e fabricaram geradores.

General Electric, Westinghouse, as companhias de serviços públicos, os mineiros de cobre, os construtores.

O mesmo padrão está a repetir-se com a IA, mas em anos e não décadas.

IA → centros de dados → chips → matérias-primas → energia

Eletricidade → fábricas → máquinas → matérias-primas → carvão/água

A progressão é quase idêntica. E os vencedores voltam a estar na infraestrutura, não nas aplicações.

Chamo a isto Gravidade da Infraestrutura. Sempre que surge uma nova plataforma informática, a criação inicial de riqueza acontece nos instrumentos para trabalhar. As aplicações aparecem depois. Recebem toda a atenção mediática. Mas a infraestrutura obtém toda a margem.

A NVIDIA registou 215,9 mil milhões de dólares de receitas no ano fiscal de 2026 (terminado em janeiro de 2026), mais 65% que no ano anterior. O segmento de centros de dados fez 62,3 mil milhões no último trimestre, crescendo 75% face ao ano anterior. Esse segmento representa agora mais de 91% das receitas totais da Nvidia. Uma empresa a faturar 68 mil milhões num trimestre, e nove em cada dez desses dólares vêm de uma única linha de negócio.

A TSMC, que fabrica os chips da Nvidia (e quase todos os outros), captou quase 70% do mercado global de foundry em 2025, com vendas de 122,5 mil milhões de dólares. A Samsung, concorrente mais próximo, teve 7,2%. Um domínio que faria a Standard Oil sentir-se desconfortável.

A infraestrutura vence sempre primeiro. A dúvida é quanto tempo dura a janela.

Pergunte a alguém sobre a revolução da internet e dirá Google, Amazon e Facebook. Pergunte onde o dinheiro inicial foi realmente ganho e a resposta é Cisco, Corning e as empresas de fibra. Mesma história, década diferente.

IV - A parte incómoda

O mercado de ações é um dispositivo para transferir dinheiro dos impacientes para os pacientes. ~ Charlie Munger

Admito: quando comecei a analisar a IA como investidor, cometi o erro comum.

Olhei para a camada das aplicações. Vi o ChatGPT a crescer. Vi a Anthropic a captar milhares de milhões. Pensei: as empresas de IA vão vencer, por isso invista nas empresas de IA.

Três factos mudaram a minha perspetiva, em sequência, cada um sobrepondo-se ao anterior.

Primeiro, percebi que quase todas as "empresas de IA" estavam a perder dinheiro. OpenAI, Anthropic, Mistral, xAI. Todas gastam mais do que ganham. Não por serem maus negócios, mas porque os custos de computação são estruturais. Cada vez que pede uma resposta a um modelo de IA, há um custo real. Quanto mais inteligente o modelo, mais computação precisa, logo maior o custo.

As empresas vistas como "vencedoras da IA" são, na verdade, as que mais gastam.

Segundo, percebi que as empresas de infraestrutura estavam a gerar lucros com margens que não via desde os primeiros tempos da Google. As margens brutas da NVIDIA rondavam os 75%. A TSMC expandia capacidade e aumentava preços porque a procura excedia largamente a oferta. Estas empresas não têm um problema de monetização; têm um problema de não conseguir construir rápido o suficiente. São problemas muito diferentes.

Terceiro, e este foi o incómodo, percebi que pensava na IA como consumidor e não como engenheiro. O consumidor vê a aplicação. O engenheiro vê o stack.

Depois de ver o stack, não se consegue deixar de ver.

Cada anúncio de IA torna-se um anúncio de capex. Cada melhoria de modelo torna-se uma encomenda de chips. Cada nova funcionalidade torna-se um contrato de arrendamento de centro de dados. Toda a indústria começa a parecer um conjunto de círculos concêntricos, e quanto mais perto do centro, mais concentrados ficam os lucros.

Talvez seja um engenheiro de software a seguir modelos de IA. Talvez seja um investidor de retalho que comprou Nvidia a 300 dólares e tenta perceber o que vem a seguir. Talvez esteja na Índia a assistir a esta revolução à distância, a perguntar como tudo se liga ao seu portefólio.

(Ou talvez seja tudo isso, o que é a posição mais interessante.)

O princípio é o mesmo. O consumidor vê o produto. O investidor vê a cadeia de fornecimento. Os melhores investidores veem a cadeia antes de o produto chegar ao mercado.

Isto parece organizado em retrospetiva, mas não foi. Passei semanas a reconsiderar. Tive de desaprender padrões da era SaaS, onde o valor estava na camada das aplicações. Procurava a "próxima OpenAI" quando devia olhar para quem a OpenAI pagava. A IA é estruturalmente diferente da SaaS. Os requisitos de computação são tão massivos que a infraestrutura captura mais valor, pelo menos nesta fase.

Compreender o stack muda a forma como lê cada notícia, como avalia empresas, como aloca capital.

Vou escrever muito mais neste registo. Análises profundas sobre investimento, IA e os sistemas por trás da circulação real de riqueza. Se não quer depender do algoritmo para receber o próximo, o melhor é seguir e ativar as notificações.

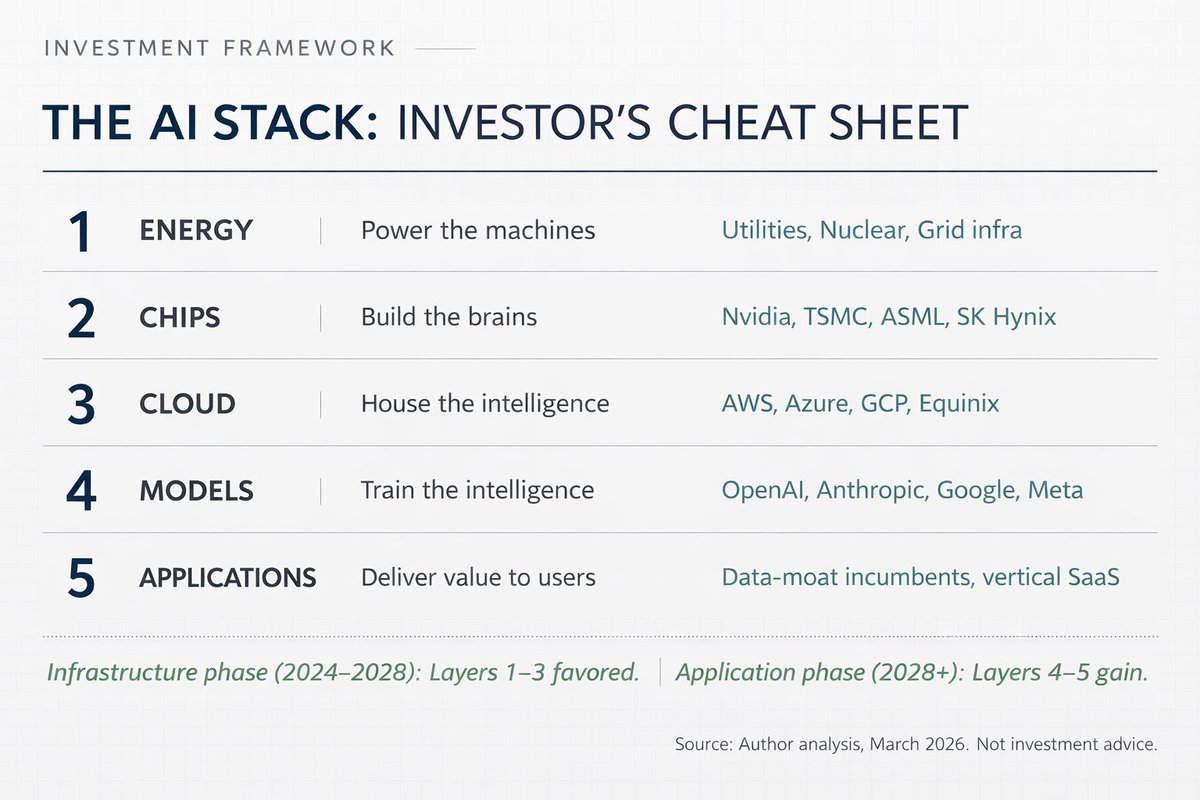

V - O mapa do investidor: análise camada a camada

Está a ficar longo, por isso vou acelerar. Eis a análise de cada camada do Stack da IA, o que acontece em cada uma, quem são os intervenientes relevantes e onde estão as oportunidades de investimento.

Fique comigo.

Camada 1: Energia

Os centros de dados de IA consomem quantidades extraordinárias de energia. Uma única sessão de treino de IA pode consumir tanta eletricidade como uma pequena cidade num ano. Prevê-se que estas instalações consumam cerca de 90 terawatts-hora por ano até 2026, um aumento de quase dez vezes face a 2022.

Isto cria uma tese de investimento clara: quem conseguir gerar, transmitir e entregar energia fiável aos centros de dados irá beneficiar. Empresas de energia nuclear, gás natural e renováveis junto a grandes clusters de centros de dados. Empresas de serviços públicos com capacidade excedente. Empresas a construir infraestrutura de rede.

Jensen Huang disse em outubro de 2025: "A energia autogerada dos centros de dados pode avançar muito mais rápido do que colocá-la na rede." Empresas já estão a construir geração de energia dedicada ligada diretamente aos centros de dados, ignorando a rede. Isso surpreendeu-me. Estas empresas tecnológicas estão a tornar-se, basicamente, seus próprios fornecedores de energia.

Quem beneficia: empresas de serviços públicos (especialmente as com capacidade nuclear), produtores independentes de energia, empresas de transformadores, equipamentos de manobra e outras infraestruturas elétricas. Na Índia, empresas de equipamentos e transmissão de energia vão beneficiar à medida que os campus hyperscaler se expandem na Ásia.

Camada 2: Chips

Esta é a camada mais conhecida, por causa da Nvidia. Mas é mais complexa do que uma empresa.

A camada dos chips tem subcamadas, cada uma com estrutura competitiva distinta. No topo, estão os designers: Nvidia (GPUs), AMD (GPUs e CPUs), Broadcom (ASICs personalizados), Qualcomm e, cada vez mais, os próprios hyperscalers (TPUs da Google, Trainium da Amazon, Maia da Microsoft). Depois, os fabricantes. A TSMC domina a fabricação, com quase 70% de quota global. A Samsung está longe, com 7,2%. A Intel tenta reconstruir o negócio de foundry, mas é um projeto de vários anos sem resultado garantido.

Depois há a camada dos equipamentos: ASML é a única empresa no mundo que fabrica as máquinas de litografia ultravioleta extrema para chips avançados. Applied Materials, Lam Research e Tokyo Electron estão ao lado. Abaixo, temos memória (os modelos de IA precisam de enormes quantidades de memória de alta largura de banda, e SK Hynix, Samsung e Micron são os três intervenientes relevantes) e embalagem (embalagem avançada de chips como a tecnologia CoWoS da TSMC tornou-se um verdadeiro estrangulamento).

A concentração é notável. A Nvidia detém uma quota estimada de 92% do mercado de GPU para centros de dados de IA. A TSMC fabrica chips para Nvidia, AMD, Broadcom, Qualcomm, Apple e quase todos os grandes designers. A ASML é literalmente o único fornecedor de máquinas de litografia EUV no planeta.

Uma empresa desenha. Uma constrói. Uma fabrica a máquina que constrói. Esse nível de concentração é simultaneamente uma tese de investimento e um risco geopolítico. Poucos ponderam ambos ao mesmo tempo.

Camada 3: Cloud e centros de dados

É aqui que vivem os chips. Instalações gigantes, em escala de armazém, cheias de servidores, ligadas por redes de alta velocidade e mantidas frescas por sistemas de gestão térmica cada vez mais elaborados (arrefecimento líquido está a tornar-se padrão).

O mercado é dominado por três hyperscalers: Amazon Web Services (31% de quota), Microsoft Azure (24%) e Google Cloud (11%). A Oracle está a crescer agressivamente, com um objetivo de capex de 50 mil milhões de dólares para 2026.

Mas a camada cloud vai muito além dos hyperscalers. A Foxconn (Hon Hai) monta cerca de 40% dos servidores de IA do mundo. Arista Networks e Credo Technology (cuja cotação subiu 117% em 2025 devido à transferência eficiente de dados) constroem a infraestrutura de rede. Vertiv trata do arrefecimento líquido. Os REIT de centros de dados como Equinix e Digital Realty detêm terrenos e edifícios. Alguém tem de derramar o betão. Cada camada tem a sua própria cadeia de fornecimento.

Os hyperscalers estão a gastar 90% do seu fluxo operacional de caixa em capex em 2026, segundo estimativas do Bank of America. É um aumento face aos 65% em 2025. Morgan Stanley prevê que estas empresas vão pedir emprestado mais de 400 mil milhões este ano para financiar a expansão, mais do dobro dos 165 mil milhões de 2025. Esse número impressionou-me. 400 mil milhões de dívida emitida num só ano, só para construir armazéns de computadores.

Camada 4: Modelos

Esta é a camada do "cérebro". As empresas que treinam e constroem os modelos de IA.

Os grandes nomes: OpenAI (série GPT, mais de 20 mil milhões de ARR), Anthropic (Claude, cerca de 19 mil milhões de receitas anualizadas no início de 2026), Google DeepMind (Gemini), Meta AI (Llama, open source), Mistral e xAI (empresa de Elon Musk, a construir Grok).

Esta camada é simultaneamente a mais mediática e a menos rentável. As receitas da OpenAI crescem a um ritmo nunca visto, mas está a queimar 17 mil milhões em caixa em 2026. Anthropic cresce rápido mas depende fortemente de rondas de financiamento massivas (5 mil milhões a uma avaliação de 170 mil milhões no início de 2026).

O problema de negócio é estrutural: os modelos melhoram com mais investimento em computação, mas esse gasto cresce mais rápido do que as receitas. É como gerir um restaurante em que cada prato exige ingredientes mais caros, mas os clientes esperam o mesmo preço. As margens ficam comprimidas. Não sei quando isso muda. Talvez nunca.

Para investidores, esta camada é de alto risco e potencial elevado. A maioria destas empresas é privada. A exposição em mercados públicos vem através dos fornecedores cloud que as alojam (Microsoft detém uma participação significativa na OpenAI e corre os seus sistemas na Azure) e das empresas de chips cujos produtos são consumidos durante o treino.

Camada 5: Aplicações

Esta é a camada visível. ChatGPT, Pesquisa Google com Gemini, Microsoft Copilot no Office, deteção de fraude por IA no banco, recomendações da Netflix, melhoramento de fotos no telemóvel.

A camada das aplicações é a mais ampla e concorrida. Milhares de startups e incumbentes estão a construir aqui. Será eventualmente a maior camada em termos de mercado endereçável (algumas estimativas colocam acima de 2 biliões de dólares até ao início da década de 2030), mas neste momento é também a camada com margens mais baixas e maior incerteza sobre quem irá vencer.

O fator diferenciador é os dados. Empresas com dados únicos e proprietários vão construir vantagens duradouras. Salesforce tem dados de CRM empresarial. Bloomberg tem dados financeiros. Epic tem registos de saúde. Empresas com esse tipo de fosso de dados podem afinar modelos de IA de formas que um chatbot genérico não consegue.

Para investidores, a camada das aplicações é onde estará o maior potencial a prazo, mas também onde a maior parte do capital será destruído. A maioria das startups de IA vai falhar. As que sobrevivem vão crescer de forma agressiva.

Os melhores retornos nos próximos 3 a 5 anos provavelmente são assim: infraestrutura agora, aplicações depois. O capital mais inteligente já está posicionado de acordo.

As empresas que vão realmente vencer na Camada 5 são as que detêm dados que ninguém mais acede. E a maioria nem se autodenomina empresa de IA.

VI - "Mas isto não é só uma bolha?"

O principal problema do investidor, e até o seu pior inimigo, provavelmente é ele próprio. ~ Benjamin Graham

Vou direto ao assunto.

"E o colapso das dot-com? Não é a mesma coisa? Investimento massivo em infraestrutura, sem lucros, euforia generalizada?"

É uma questão legítima e merece resposta.

A diferença está aqui: na era dot-com, as empresas investiram em infraestrutura para uma procura que ainda não existia. Construíram redes de fibra ótica e servidores web para um público que ainda usava dial-up. A infraestrutura foi construída, a procura só apareceu 5 a 7 anos depois, e tudo o que ficou pelo meio foi liquidado.

Em 2026, a procura por IA já está aqui. A NVIDIA não consegue fabricar chips rápido o suficiente. A capacidade avançada de embalagem da TSMC está esgotada. Os preços de aluguer de cloud computing estão a subir. A OpenAI adicionou 400 milhões de utilizadores ativos semanais entre março e outubro de 2025. Os modelos estão a ser usados, a computação consumida, os clientes a pagar.

Isso não significa ausência de risco. Há riscos significativos, e penso nisso mais do que gostaria. Três em particular:

Primeiro, má alocação de capital. As empresas estão a gastar mais de 650 mil milhões em centros de dados em 2026. Se as receitas dos serviços de IA não surgirem rápido o suficiente para justificar esse investimento, algumas vão enfrentar compressão séria de margens. O fluxo de caixa livre da Amazon pode até ficar negativo este ano. É a Amazon, a empresa que inventou o cloud computing.

Segundo, risco de concentração. A cadeia de fornecimento de IA está perigosamente concentrada. A TSMC fabrica quase 70% dos chips do mundo. A ASML é o único fornecedor de máquinas EUV. A NVIDIA desenha 92% dos GPUs de centros de dados de IA. Qualquer perturbação pode afetar todo o stack. Um sismo em Hsinchu, Taiwan, pode atrasar o desenvolvimento global de IA anos. Isso devia preocupar.

Terceiro, a questão DeepSeek. Em janeiro de 2025, o laboratório chinês DeepSeek lançou um modelo que se aproximou do desempenho de ponta a uma fração do custo de treino. Isto desafia a ideia de que maior investimento equivale automaticamente a melhor IA. Se modelos open source e eficientes continuarem a reduzir o fosso, a tese de investimento em infraestrutura enfraquece. DeepSeek não destruiu a tese, mas introduziu uma variável nova.

O enquadramento é este: a McKinsey estima que o investimento cumulativo em centros de dados pode chegar a 6,7 biliões de dólares globalmente até 2030. A PwC estima que a IA pode contribuir com 15,7 biliões para o PIB global até 2030. A IDC projeta que soluções e serviços de IA vão gerar um impacto cumulativo de 22,3 biliões de dólares até 2030.

Mesmo que esses números estejam 50% errados, estamos perante a maior mudança económica impulsionada pela tecnologia desde a internet. A questão é magnitude, não direção.

Ouço muita gente dizer "sou céptico quanto à IA", como se fosse uma posição. Muito bem. Seja céptico quanto aos modelos, quanto aos prazos. Mas não ignore a cadeia de fornecimento. Uma é uma postura intelectual saudável. A outra custa dinheiro.

Daqui a cinco anos, os nomes vencedores deste ciclo parecerão óbvios. Sempre acontece. O jogo agora é ver a estrutura antes de todos.

VII - Jogue na camada certa

Pense na IA como um videojogo com cinco níveis, empilhados.

Nível 1 (Energia) é o tutorial. Essencial, pouco glamoroso e quase impossível de perder. Baixo risco, retornos estáveis. São os NPC que nunca morrem mas sempre pagam.

Nível 2 (Chips) é o boss fight. Maior concentração de poder, maiores margens, mas também maior exposição à disrupção e ao risco geopolítico. Recompensas enormes, dificuldade máxima.

Nível 3 (Cloud) é o servidor multiplayer. Toda a gente joga aqui. Os hyperscalers são os administradores do servidor e ficam com uma parte de tudo.

Nível 4 (Modelos) é a arena PvP. Competição brutal, inovação rápida e a maioria dos jogadores é eliminada. Só os melhor equipados sobrevivem.

Nível 5 (Aplicações) é o mundo aberto. Possibilidades infinitas, mas sem loot garantido. Tem de encontrar as suas próprias missões.

A meta-estratégia é simples: não precisa de jogar todos os cinco níveis. A maioria tenta jogar o Nível 5 porque é o mais visível. O dinheiro inteligente está a farmar nos Níveis 2 e 3 porque é onde a XP está mais alta agora.

Onde está no stack determina o que deve focar.

Para os não técnicos: não precisa de perceber como funciona um GPU. Precisa de perceber que alguém tem de os fabricar, alguém de os alojar e alguém de fornecer energia. Esses "alguéns" são empresas cotadas com resultados trimestrais acessíveis.

Para os técnicos, já sabe que os modelos estão a melhorar. O que pode subestimar é a rapidez com que as limitações físicas (energia, arrefecimento, embalagem de chips) estão a tornar-se o principal estrangulamento. A próxima década de progresso em IA vai ser ganha ou perdida na engenharia, não nos papers de arquitetura.

Para o investidor, a cadeia de valor da IA são cinco operações empilhadas, cada uma com perfil de risco-recompensa distinto, horizonte temporal próprio e conjunto de vencedores específico. Tratar "IA" como um único setor é como tratar "tecnologia" como um único setor em 1998. O intervalo entre os melhores e piores resultados dentro de "IA" é enorme.

Isto não dura para sempre. A certa altura, a infraestrutura amadurece, a camada das aplicações consolida, e o valor sobe no stack, tal como aconteceu com a internet. Amazon, Google e Facebook (a aplicação da era da internet) acabaram por captar mais valor do que as empresas de fibra ótica e servidores.

Mas ainda não estamos aí com a IA. Estamos na fase da infraestrutura, dos instrumentos para trabalhar. E os instrumentos estão a gerar dinheiro.

Quem compreende o stack completo verá as transições antes de acontecerem. Todos os outros serão surpreendidos, vezes sem conta, por onde o dinheiro realmente flui.

Daqui a 10 anos, perceber o stack da IA será tão básico como compreender um balanço.

Aprenda o stack. Mapeie as camadas. Siga o capital.

Esse é o jogo.

~ Anish Moonka

Aviso legal:

-

Este artigo é republicado a partir de [AnishA_Moonka]. Todos os direitos de autor pertencem ao autor original [AnishA_Moonka]. Caso existam objeções a esta republicação, contacte a equipa Gate Learn, que tratará do assunto prontamente.

-

Aviso de responsabilidade: As opiniões e pontos de vista expressos neste artigo são exclusivamente do autor e não constituem qualquer aconselhamento de investimento.

-

As traduções do artigo para outros idiomas são realizadas pela equipa Gate Learn. Salvo indicação em contrário, é proibido copiar, distribuir ou plagiar os artigos traduzidos.

Artigos relacionados

Tokenomics do USD.AI: análise aprofundada dos casos de utilização do token CHIP e dos mecanismos de incentivos

Análise das Fontes de ganhos de USD.AI: como os empréstimos de infraestrutura de IA geram retorno

A aplicação da Render em IA: como o hashrate descentralizado potencia a inteligência artificial

Render, io.net e Akash: análise comparativa das redes DePIN de poder de hash

Análise da arquitetura do protocolo Audiera: funcionamento dos sistemas económicos nativos para agentes