Anthropic подает в суд! Обвиняет администрацию Трампа в ответных мерах и блокировке Claude, 37 исследователей ИИ поддерживают

Anthropic подала в суд на федеральное правительство, выступая против включения в список рисков цепочки поставок и ограничения использования Claude на 6 месяцев, а также обострения споров о военном применении ИИ и вопросах безопасности.

Обвинение в «рисках цепочки поставок»: Anthropic подает в суд на федеральное правительство

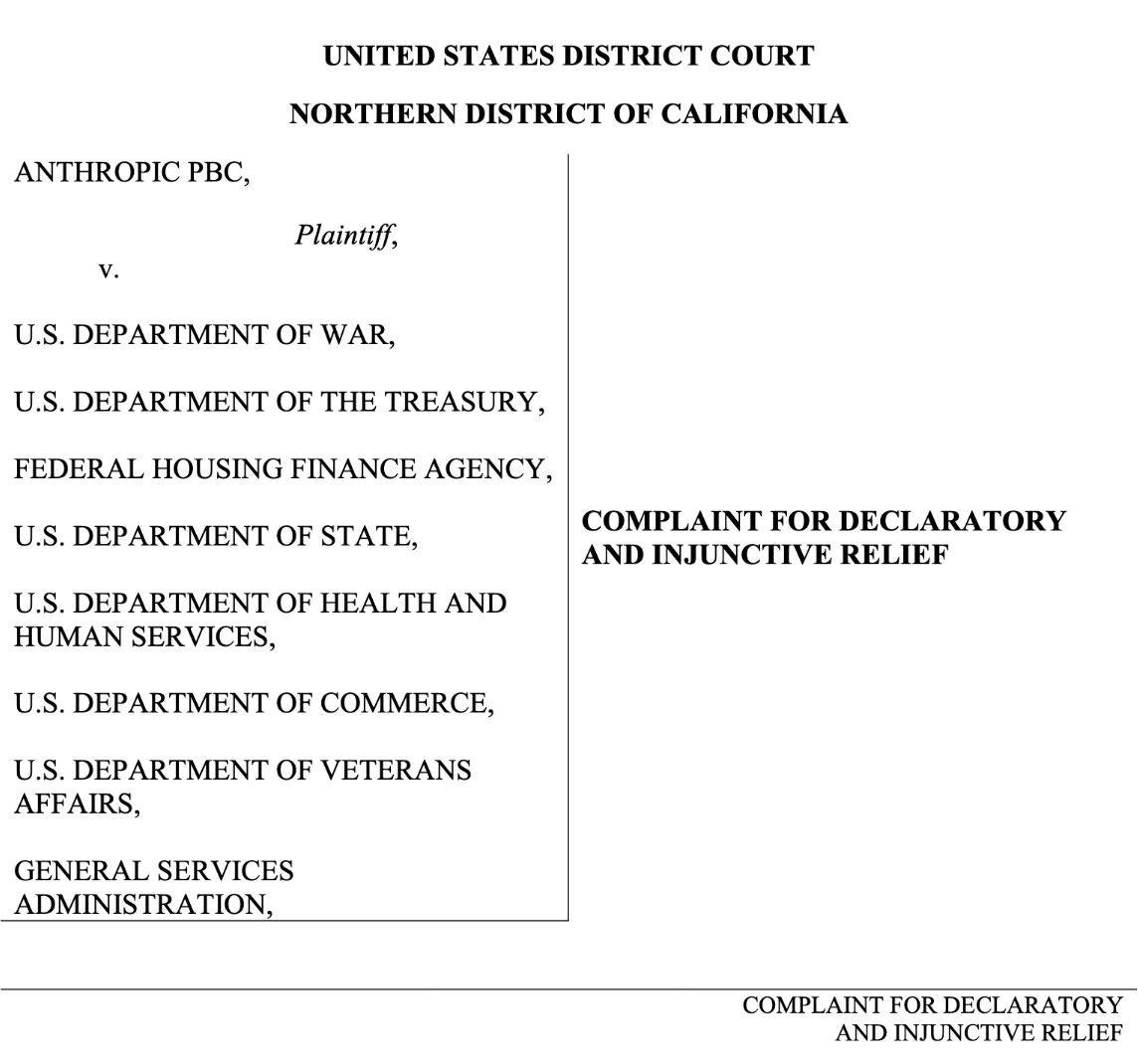

Компания по разработке искусственного интеллекта Anthropic недавно подала иск в федеральный суд США, обвиняя администрацию Трампа в включении её в список «рисков цепочки поставок» (supply chain risk) и требуя от федеральных агентств прекратить использование её ИИ-систем. Компания считает, что такие меры являются актом ответных репрессивных мер. Иск подан в Северный окружной федеральный суд Калифорнии.

В исковом заявлении Anthropic указывает, что действия правительства не основаны на законе и наносят значительный ущерб деятельности компании и её партнёрским отношениям. В документах указаны в качестве ответчиков несколько государственных учреждений и должностных лиц, включая Министерство обороны США, министра обороны Пита Хегсета (Pete Hegseth), министра финансов Скотта Бессента (Scott Bessent), государственного секретаря Марко Рубио (Marco Rubio) и министра торговли Говарда Лутника (Howard Lutnick).

Источник: Anthropic. Anthropic подала иск в федеральный суд США, обвиняя администрацию Трампа в включении её в список «рисков цепочки поставок» и требуя прекратить использование её ИИ-систем

Тег «риски цепочки поставок» обычно применяется к технологическим компаниям, связанным с государствами-агрессорами, например, поставщикам, которые могут содержать шпионское ПО или вредоносные программы. Anthropic отмечает, что включение американской ИИ-компании в этот список негативно сказывается на её репутации и деловых связях. Компания заявляет, что через судебные процедуры она стремится прояснить законность действий правительства и защитить интересы бизнеса, клиентов и партнёров.

Споры о военном применении ИИ, разрыв переговоров по контрактам с Минобороны

Основной причиной конфликта стала разница во взглядах Anthropic и Министерства обороны США на использование технологий ИИ. Ранее Anthropic вела переговоры о контракте на сумму около 2 миллиардов долларов с Пентагоном. В ходе переговоров военное ведомство требовало, чтобы система ИИ могла использоваться во всех законных целях, включая военные сценарии. Anthropic настаивала на сохранении двух ограничений по безопасности:

- Запретить использование модели Claude для массового слежения за гражданами США;

- Запретить использование в полностью автономных смертельных оружейных системах.

Компания считает эти ограничения важными принципами безопасного управления ИИ. В течение всего времени стороны не могли достичь согласия. В феврале 2026 года правительство США включило Anthropic в список «рисков цепочки поставок» и потребовало прекратить использование системы Claude в течение 6 месяцев.

В иске Anthropic указывает, что правительство использует административную власть для давления на компанию, пытаясь заставить её изменить политику безопасности ИИ. Юристы компании заявляют, что Конституция США не допускает, чтобы правительство применяло к компаниям санкции за их публичную позицию.

Дополнительные материалы

Национальная безопасность против этики: Anthropic отказывается удалять защитные функции Claude, вступая в конфликт с Минобороны США

Техно-общество поддерживает, 37 исследователей ИИ подали судебное мнение

Конфликт между Anthropic и правительством быстро вызвал обсуждение в технологической индустрии. Вскоре после подачи иска 37 исследователей ИИ из компаний OpenAI и Google направили в суд свои комментарии, выразив поддержку Anthropic. Они считают, что если правительство будет наказывать компании за разногласия по вопросам безопасности ИИ, это может ослабить позиции США в мировой индустрии искусственного интеллекта.

В своих заявлениях они отмечают, что использование аргумента национальной безопасности для преследования ИИ-компаний может иметь долгосрочные негативные последствия для технологической среды и исследовательской деятельности. Некоторые ученые также указывают, что термин «риски цепочки поставок» обычно применяется к ситуациям, связанным с опасениями по поводу иностранных программных продуктов. В случае Anthropic это не соответствует сути риска.

Генеральный директор компании SingularityNET Бен Гёрцель (Ben Goertzel) заявил, что отказ от использования ИИ для массового слежения или автономных систем убийства не представляет угрозы безопасности. Если военные нуждаются в таких функциях, они могут выбрать другие системы ИИ.

Источник: DigFin. Генеральный директор SingularityNET Бен Гёрцель

Обострение конфликта между правительством и технологическим сектором, расширение споров по ИИ

На фоне иска Белый дом быстро отреагировал, заявив, что правительство не допустит ограничения использования ключевых технологий для вооружённых сил США. Представитель Белого дома подчеркнул, что правительство должно обеспечить возможность использования необходимых технологий в законных целях для защиты национальной безопасности.

Этот спор также затрагивает более широкие вопросы технологической политики. Ранее администрация Трампа смягчила экспортные ограничения на чипы для ИИ в Китай и критиковала политические позиции некоторых технологических компаний, что усугубило напряженность между Кремниевой долиной и Вашингтоном.

Anthropic заявляет, что после включения в черный список некоторые компании, сотрудничающие с Минобороны, могут быть вынуждены доказать, что их системы не используют Claude. Это требование может вызвать цепную реакцию в деловых связях.

Некоторые крупные технологические компании продолжают поддерживать Anthropic. Google заявил, что продолжит предоставлять своим облачным клиентам технологии Anthropic, но без использования в военных целях. Microsoft и Amazon также выразили намерение продолжать сотрудничество в коммерческом секторе.

Anthropic подала в суд ходатайство о признании действий правительства незаконными и о приостановке применения «рисков цепочки поставок». После начала судебного разбирательства обсуждение вопросов безопасности ИИ, национальной безопасности и корпоративной автономии продолжает расширяться.

Дополнительные материалы

OpenAI сотрудничает с армией США, вызывая бойкот! Загрузка приложения Claude обогнала конкурентов — разбор этических и политических аспектов

Wall Street Journal: После запрета Anthropic администрацией Трампа США и Израиль продолжают зависеть от Claude для атак на Иран