Anthropic предъявила иск правительству Трампа: ярлык «риски цепочки поставок» является незаконной местью

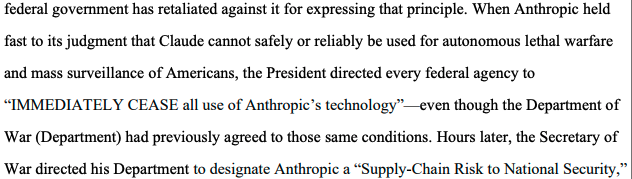

Искусственный интеллект Claude, разработанный компанией Anthropic, в понедельник подал иск в федеральный суд Калифорнии против правительства Трампа, обвиняя его в «незаконных репрессивных действиях» за отказ разрешить армии неограниченно использовать технологии компании — в том числе для смертельно опасных автономных оружий и масштабного внутреннего наблюдения. Это первый случай в истории США, когда отечественная компания признана риском для военной цепочки поставок.

Метка риска цепочки поставок: беспрецедентное признание Пентагоном

Началом этого судебного разбирательства стало окончательное решение министра обороны Пита Хегсета 3 марта 2026 года — включить Anthropic в список компаний, представляющих риск для военной цепочки поставок. Юридические последствия этого признания крайне серьезны — любые лица или компании, имеющие дела с армией, не смогут вести с Anthropic никакой бизнес, что фактически исключает их из федеральных закупок.

Стоит отметить, что ранее подобное признание риска цепочки поставок применялось только к компаниям, подозреваемым в связях с иностранными противниками, и никогда — к американским компаниям. В иске Anthropic называет это «беспрецедентным и незаконным» действием и утверждает: «Конституция не допускает использование правительства своего огромного влияния для наказания компании за защищённую свободу слова.»

В судебном процессе участвуют многочисленные ответчики, включая Пита Хегсета (министр обороны), Скотта Бессента (министр финансов), Марко Рубио (государственный секретарь) и еще 17 государственных учреждений и чиновников, охватывающих ключевые департаменты федерального правительства.

Ключевые красные линии Anthropic: смертельное оружие и масштабное наблюдение

(Источник: CourtListener)

(Источник: CourtListener)

По заявлениям Anthropic в иске, Хегсет требует от компании «полностью отказаться от ограничений использования» — что Anthropic отвергает, поскольку эти ограничения являются частью их правового контракта с правительством и предназначены для предотвращения использования Claude в двух конкретных целях:

Смертельно опасные автономные системы оружия: автоматизированные системы убийства, не требующие окончательного решения человека

Массовое наблюдение за гражданами США: использование ИИ для масштабного сбора и анализа личных данных граждан

Anthropic ясно заявляет: «Компания никогда не тестировала Claude для этих целей. В настоящее время Anthropic не уверена, сможет ли Claude надежно или безопасно функционировать при использовании для поддержки смертельных автономных войн.»

Эта позиция соответствует долгосрочной политике Anthropic по приоритету безопасности ИИ, однако противоречит расширяющейся военной политике правительства Трампа по применению ИИ. Важно отметить, что с 2024 года американское правительство и Пентагон используют технологии Anthropic, а Claude стал первым ИИ, внедренным в секретных рабочих средах. Также данное признание сопровождается указом Трампа о прекращении использования Claude федеральными служащими.

Поддержка отрасли: инженеры OpenAI и Google объединяются

После начала судебных разбирательств реакция индустрии ИИ была быстрой и широкой. В понедельник более 30 инженеров и ученых из OpenAI и Google, включая главного ученого Google Джеффа Дина, подали амикус-бриев — юридическую поддержку — в поддержку Anthropic.

Эти специалисты предупреждают: «Если позволить продолжать такие меры наказания одной из ведущих американских компаний в области ИИ, это без сомнения негативно скажется на промышленной и научной конкуренции США в области искусственного интеллекта и других технологий.» В этом заявлении выражается более глобальная озабоченность — что правительственное давление на отечественные ИИ-компании под предлогом риска цепочки поставок может ослабить конкурентоспособность США в глобальной гонке за ИИ против Китая.

Часто задаваемые вопросы

Какое конкретное влияние окажет метка риска цепочки поставок на Anthropic?

По американскому законодательству, компания, признанная риском цепочки поставок, не может вести бизнес с любыми лицами или организациями, связанными с армией. Это фактически исключает Anthropic из всей системы федеральных закупок, затрагивая не только прямые военные контракты, но и всех поставщиков и партнеров, связанных с правительством.

Почему Anthropic отказалась открывать использование для смертельных оружий?

Компания считает, что Claude никогда не проходила тестирование или оценку безопасности для таких целей, и в настоящее время не может гарантировать надежность или безопасность при использовании в подобных сценариях. Кроме того, принципы безопасности ИИ Anthropic выступают против развертывания высокорискованных автономных систем без достаточного тестирования, особенно в военных целях, связанных с человеческими жизнями.

Что означает поддержка инженеров Google и OpenAI для Anthropic?

Подписавшие — более 30 инженеров и ученых из конкурирующих компаний — демонстрируют, что индустрия ИИ обеспокоена возможными последствиями правительственного давления через метки риска цепочки поставок. Их поддержка подчеркивает общий интерес: если правительство сможет использовать такие инструменты для давления на несогласные компании, любые компании, отказавшиеся от раскрытия своих технологий, могут оказаться под угрозой.