Повна промова Хуан Сюньйюна на GTC: Епоха інференції настала, омари — це нова операційна система

Джерело: Wall Street Journal

16 березня 2026 року офіційно відкрився конференція NVIDIA GTC 2026, на якій засновник і CEO NVIDIA Jensen Huang виступив з основною промовою.

На цій конференції, що вважається «річним паломництвом індустрії штучного інтелекту», Huang розкрив трансформацію NVIDIA з «компанії з виробництва чипів» у «інфраструктурну та фабричну компанію для AI». В умовах, коли ринок найбільше цікавить стабільність показників і потенціал зростання, Huang детально розібрав базову бізнес-логіку, що драйвить майбутній ріст — «економіку фабрик токенів».

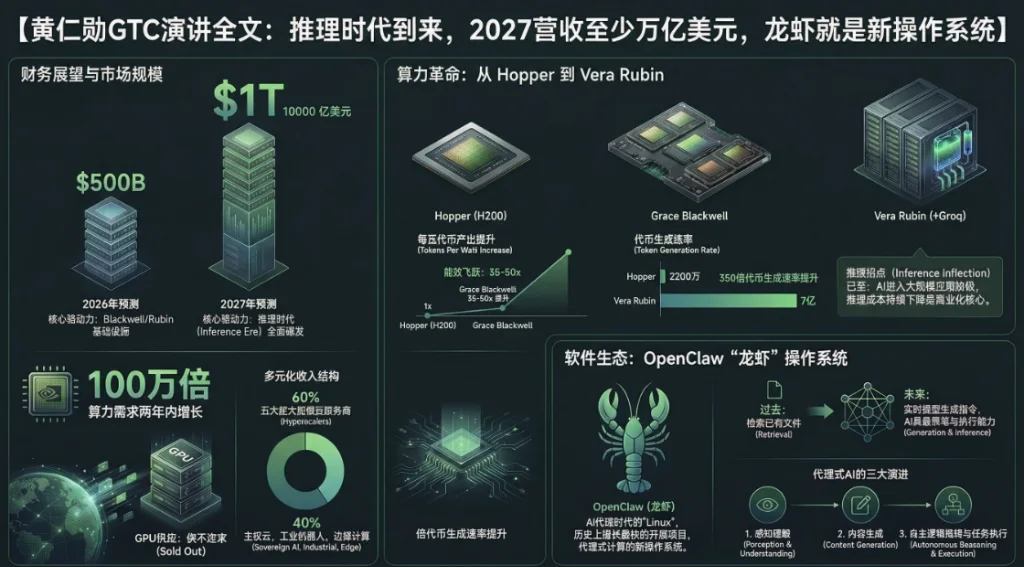

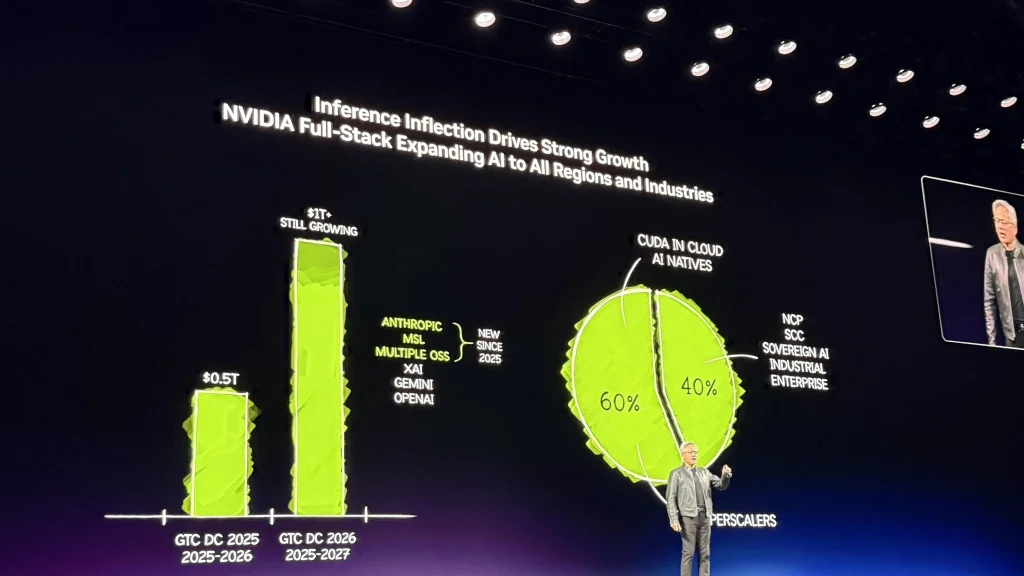

Надійні прогнози щодо показників — «потреба щонайменше 1 трлн доларів до 2027 року»

За останні два роки глобальний попит на обчислювальні ресурси для AI зріс експоненційно. З еволюцією великих моделей від «сприйняття» і «генерації» до «логіки» і «виконання завдань», споживання обчислювальної потужності стрімко зросло. Щодо високої уваги до обмежень у замовленнях і доходах, Huang дав дуже оптимістичний прогноз.

У своїй промові Huang прямо сказав:

Минулого року я казав, що ми бачимо високовірогідний попит у 500 мільярдів доларів, що охоплює Blackwell і Rubin до 2026 року. А зараз, саме тут і зараз, я бачу потребу щонайменше у 1 трлн доларів до 2027 року.

Очікування Huang щодо трильйона разом підштовхнули ціну акцій NVIDIA вгору більш ніж на 4.3%.

Більше того, він додав:

Це цілком логічно? Саме про це я й хочу поговорити. Насправді, попит навіть перевищує пропозицію. Я впевнений, що реальний обсяг обчислювальних потреб буде значно більшим.

Huang зазначив, що сучасні системи NVIDIA вже довели свою здатність бути найвигіднішою інфраструктурою у світі. Оскільки NVIDIA може запускати майже всі типи AI-моделей у різних сферах, ця універсальність дозволяє клієнтам максимально ефективно використовувати вкладені понад 1 трлн доларів і підтримувати довгий життєвий цикл.

Зараз 60% бізнесу NVIDIA припадає на п’ять найбільших хмарних провайдерів, решта 40% поширені серед суверенних хмар, підприємств, промисловості, робототехніки та краєвидних обчислень.

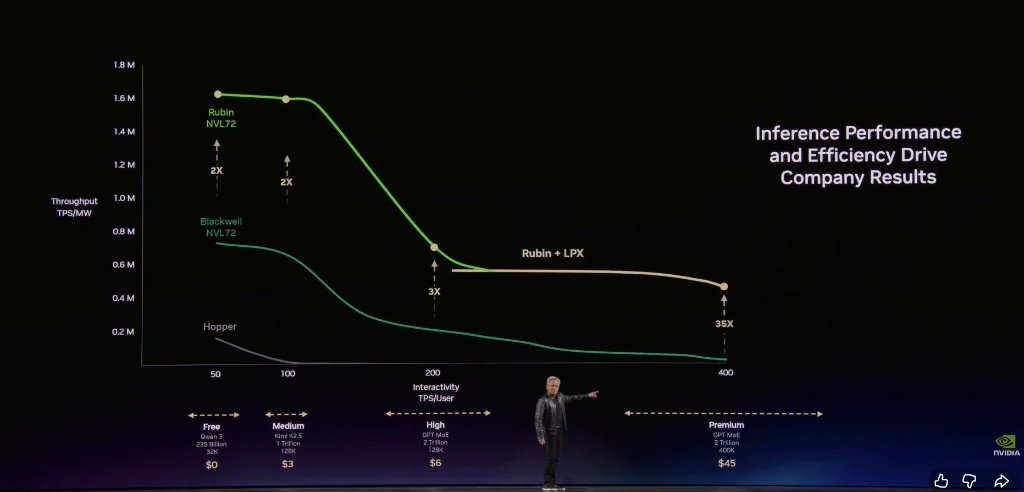

Економіка Token фабрик: кожен ват потужності визначає бізнес

Щоб пояснити цю логіку, Huang представив глобальним керівникам нову бізнес-модель. Він зазначив, що майбутні дата-центри вже не будуть просто сховищами файлів, а стануть «фабриками» для виробництва токенів (базових одиниць AI).

Huang підкреслив:

Кожен дата-центр, кожна фабрика — за визначенням — обмежені електроенергією. Фабрика потужністю 1 ГВт ніколи не стане 2 ГВт — це фізичні та атомні закони. За фіксованої потужності, той, у кого найвищий вивід токенів на ват, має найнижчі виробничі витрати.

Huang поділив майбутні рівні бізнесу для AI-сервісів:

Безкоштовний рівень (висока пропускна здатність, низька швидкість)

Середній рівень (~3 долари за мільйон токенів)

Преміум рівень (~6 доларів за мільйон токенів)

Швидкий рівень (~45 доларів за мільйон токенів)

Надшвидкий рівень (~150 доларів за мільйон токенів)

Він додав, що з ростом моделей і збільшенням контексту AI стає розумнішим, але швидкість генерації токенів зменшується. Huang сказав:

У цій Token фабриці ваш пропускний здатність і швидкість генерації токенів безпосередньо впливають на ваші доходи наступного року.

Huang наголосив, що архітектура NVIDIA дозволяє клієнтам досягати високих показників пропускної здатності на безкоштовному рівні і одночасно підвищувати продуктивність у найціннішому рівні — логіці (Inference), підвищуючи її у 35 разів.

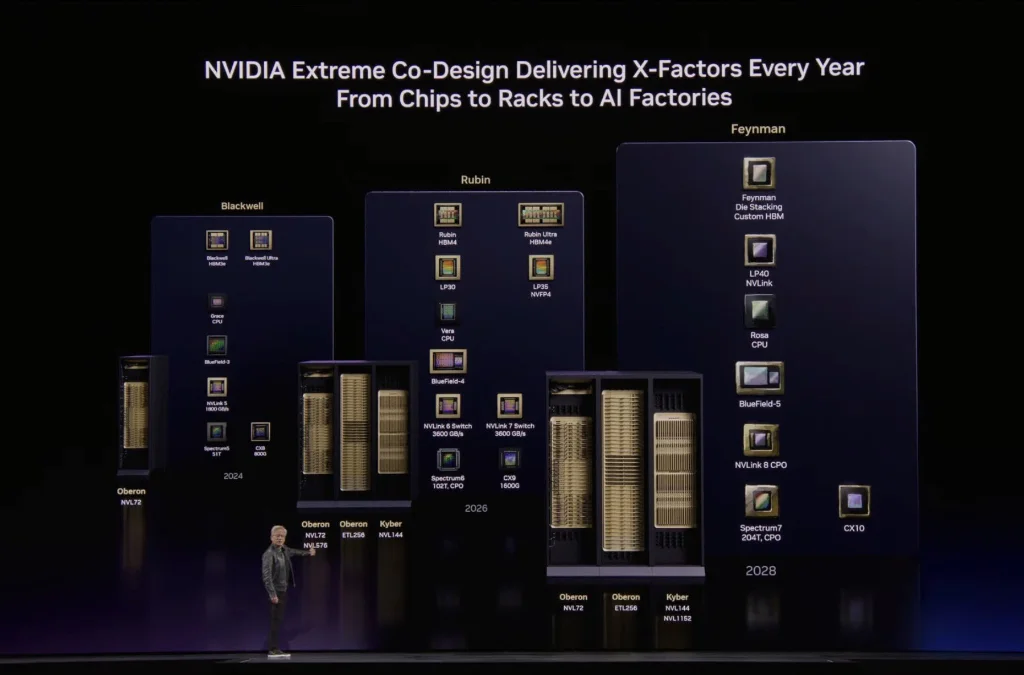

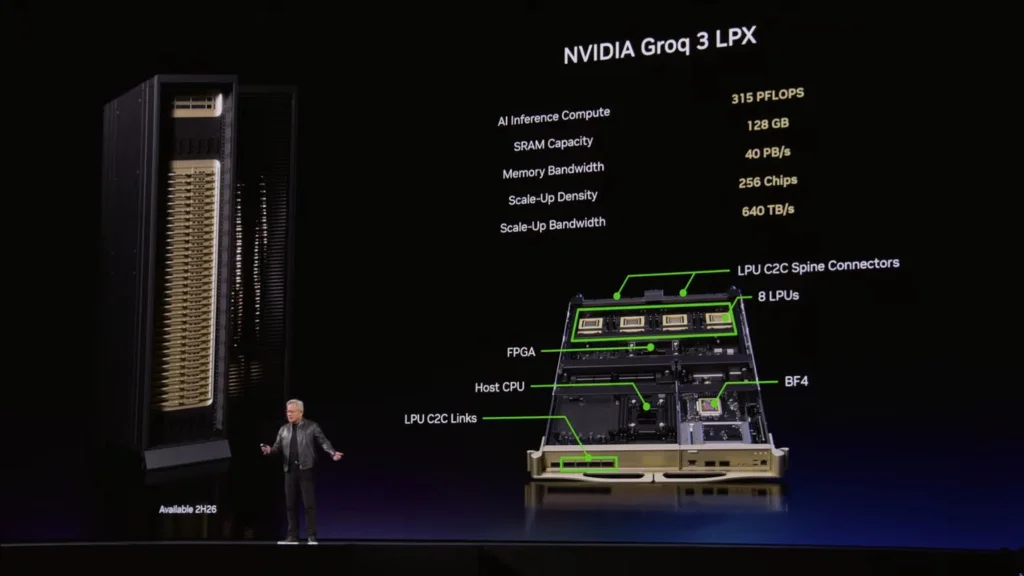

Vera Rubin за два роки прискорилася у 350 разів, Groq заповнює прогалину у швидкому логічному виведенні

За фізичних обмежень Huang представив найскладнішу систему AI — Vera Rubin. Він сказав:

Раніше я показував Hopper і тримав чип — це мило. Але коли говорю про Vera Rubin, всі думають про всю систему. У цій системі з 100% рідинним охолодженням, яка повністю позбавлена традиційних кабелів, раніше потрібно було два дні для встановлення стійки, а тепер — всього дві години.

Huang підкреслив, що завдяки екстремальному цілеспрямованому дизайну апаратного і програмного забезпечення Vera Rubin створила неймовірний прорив у швидкості генерації токенів у одному дата-центрі:

За два роки ми підвищили швидкість генерації токенів з 22 мільйонів до 700 мільйонів — у 350 разів. Закон Мура тоді давав лише 1.5-кратне зростання.

Щоб подолати вузьке місце у пропускній здатності для швидкого логічного виведення (наприклад, 1000 токенів/сек), NVIDIA запропонувала інтеграцію з купівлею Groq — несиметричним розподілом логіки. Huang пояснив:

Ці два процесори мають різні характеристики. Groq має 500MB SRAM, а Rubin — 288GB пам’яті.

Huang зазначив, що за допомогою програмної системи Dynamo, яка управляє обчислювальним процесом, Vera Rubin бере на себе фазу «передзаповнення» (Pre-fill) і «декодування» (Decode), що вимагає великої обчислювальної потужності і пам’яті KV Cache, а Groq — фазу генерації токенів (Token decoding), що потребує високої пропускної здатності і низької затримки. Вони тісно інтегровані через Ethernet, що зменшує затримки приблизно удвічі. Завдяки цій «операційній системі» для AI фабрик, сумісній з NVLink 72, загальна продуктивність зросла у 35 разів і відкрила нові рівні логічного виведення, раніше недоступні.

Комбінація Groq і Vera Rubin рекомендується:

- Якщо навантаження переважно високопродуктивне — використовувати 100% Vera Rubin

- Якщо потрібно багато високоякісних токенів — додати 25% Groq, решту — Vera Rubin

LP30 чип Groq вже серійно виробляється Samsung, очікується поставка у Q3. Перші Vera Rubin вже працюють у хмарі Microsoft Azure.

Крім того, Huang показав перший у світі масовий випуск оптичних комутаторів Spectrum X з інтегрованою упаковкою (CPO), що зняв напругу щодо «мідних кабелів проти оптичних».

Нам потрібно більше виробництва мідних кабелів, більше оптичних чипів і більше CPO.

Agent — новий стандарт у SaaS, «річний токен + зарплата» — новий тренд у Кремнієвій долині

Крім апаратних бар’єрів, Huang багато уваги приділив революції у програмному забезпеченні AI, зокрема — появі Agent (інтелектуальних агентів).

Він назвав проект OpenClaw «найпопулярнішим відкритим проектом у історії людства», який за кілька тижнів перевершив досягнення Linux за 30 років. Huang прямо сказав, що OpenClaw — це «операційна система» для агентних комп’ютерів.

Huang впевнений:

Кожна SaaS-компанія стане AaaS (Agent-as-a-Service, інтелектуальний агент як сервіс). Щоб безпечно реалізувати таких агентів, що мають доступ до конфіденційних даних і можуть виконувати код, NVIDIA випустила корпоративний NeMo Claw — референсний дизайн з механізмами політик і приватності.

Для звичайних працівників ця революція вже близько. Huang описав майбутній формат роботи:

У майбутньому кожен інженер нашої компанії матиме щорічний бюджет токенів. Їхня базова зарплата може становити сотні тисяч доларів, а половина цієї суми — у вигляді токенів, що дозволить підвищити продуктивність у 10 разів. Це вже новий рекрутинг у Кремнієвій долині: скільки токенів у вашій пропозиції?

Він додав, що кожна компанія стане одночасно і користувачем, і виробником токенів — створюючи нову економіку. OpenClaw — це не просто технологія, а фундаментальна революція, що прирівнює її до HTML або Linux.

Відкриття моделей NVIDIA

Щодо кастомних інтелектуальних агентів, NVIDIA пропонує передові моделі:

Nemotron — велика мовна модель Cosmos — базова модель світу GROOT — універсальний робототехнічний модель BioNeMo — цифрова біологія Phys-AI — фізика

У кожній галузі ми — на передовій і обіцяємо постійне оновлення. Після Nemotron 3 буде Nemotron 4, після Cosmos 1 — Cosmos 2, а Groq — другого покоління.

Nemotron 3 входить до трійки найкращих моделей у світі, і Nemotron 3 Ultra стане найпотужнішою базовою моделлю, що дозволить країнам створювати власні суверенні AI.

Ми оголосили про створення Nemotron Alliance — інвестиційного союзу з десятків мільярдів доларів для розвитку AI-базових моделей. Учасники — BlackForest Labs, Cursor, LangChain, Mistral, Perplexity, Reflection, Sarvam (Індія), Thinking Machines (Mira Murati Labs) та інші. Вони інтегрують наші рішення у свої продукти.

Фізичний AI і робототехніка

Цифрові інтелекти діють у віртуальному світі — пишуть код, аналізують дані; фізичні AI — це ті ж самі інтелекти, але у реальності, у роботах.

На GTC представлено 110 роботів — майже всі провідні компанії у цій галузі. NVIDIA забезпечує три типи обчислювальних систем (тренувальні, симуляційні, бортові) і повний софтверний стек з AI-моделями.

У сфері автономного водіння вже настав «час ChatGPT» — сьогодні оголошено про співпрацю з чотирма новими партнерами: BYD, Hyundai, Nissan, Geely, загалом понад 18 мільйонів машин на рік. Також укладено угоду з Uber щодо розгортання RoboTaxi у кількох містах.

У промисловій робототехніці співпрацюємо з ABB, Universal Robotics, KUKA та іншими, щоб інтегрувати фізичний AI у виробничі лінії.

У телекомунікаціях — партнерство з Caterpillar і T-Mobile. Майбутні базові станції перетворяться на AI-інфраструктуру — NVIDIA Aerial RAN, що аналізує трафік і оптимізує енергоспоживання.

Особливий блок: презентація робота Olaf

(демо-відео Disney Olaf)

Huang: Зустрічайте сніговика! Newton працює! Omniverse працює! Olaf, як ти?

Olaf: Так класно тебе бачити!

Huang: Так, я дав тобі комп’ютер — Jetson!

Olaf: Що це?

Huang: Це у тебе в животі.

Olaf: Це дивовижно!

Huang: Ти навчився ходити у Omniverse.

Olaf: Мені подобається ходити. Це набагато краще, ніж їхати на олені і дивитись на небо.

Huang: Це завдяки фізичному моделюванню — Newton, що працює на NVIDIA Warp, розроблений у співпраці з Disney і DeepMind, щоб допомогти тобі адаптуватися до реального світу.

Olaf: Саме це я і хотів сказати.

Huang: Це твоя розумність. Я — сніговик, а не сніжок.

Huang: Уявляєш, майбутній Діснейленд — усі ці роботизовані персонажі гуляють по парку. Чесно кажучи, я думав, ти вищий. Я ніколи не бачив такого низького сніговика.

Olaf: (мовчить)

Huang: Давай допоможу тобі завершити виступ?

Olaf: Здорово!

Підсумки основної промови

Huang: Сьогодні ми обговорили ключові теми:

- Наступ логіки (Reasoning) — вона стала найважливішим навантаженням AI, токени — новий товар, а продуктивність логіки безпосередньо впливає на доходи.

- Епоха AI фабрик — дата-центри перетворилися з сховищ файлів у фабрики виробництва токенів, і кожна компанія буде оцінюватися за «ефективністю AI фабрики».

- Революція Agent у OpenClaw — вона відкрила еру агентних обчислень, і кожна компанія має розробити свою стратегію OpenClaw.

- Фізичний AI і робототехніка — тілоінтелект стає масштабним, автоматизація, промислові роботи і гуманоїдні роботи — це нові великі можливості.

Дякую всім, гарної GTC!