Grammarly推AI專家審稿惹議!學界批:未經授權且刻意模仿已故學者

Grammarly 推出“Expert Review”以 AI 模擬學者評論,引發未經授權使用姓名與學術倫理爭議。

Grammarly 推出 AI“專家審稿”功能,引發學界質疑

人工智慧工具持續滲透寫作與研究產業,但最新一波“AI 模擬專家評論”功能,卻引發學術界對倫理與授權問題的激烈討論。知名寫作工具 Grammarly 近期推出名為“Expert Review”的 AI 功能,允許使用者在撰寫文件時,透過 AI 模擬特定學者或評論者的視角,對文章內容提出建議與評論。

該功能會分析使用者正在撰寫的文本,並根據主題自動推薦合適的“專家”,接著透過大型語言模型生成評論。例如:

- 在媒體評論相關主題中,系統可能引用《紐約時報》前公共編輯 Margaret Sullivan 或 Politico 前資深媒體作家 Jack Shafer 的觀點風格,協助使用者修改文章。

- 在法律與網路治理議題中,系統也可能模擬哈佛大學法學教授 Lawrence Lessig 的分析方式;在科技倫理或資訊隱私議題中,則可能引用 AI 倫理研究者 Timnit Gebru 或康奈爾科技學院資訊科學教授 Helen Nissenbaum 的研究觀點。

Grammarly 表示,這項功能並非真正由這些專家審稿,而是利用其公開發表的研究與文章,生成“受其思想啟發”的評論。公司指出,系統會根據文章主題,自動選擇相關產業具有影響力的學者或評論者,並提示使用者進一步閱讀其作品。

然而,這種設計方式仍在學界引發強烈質疑,尤其是部分學者發現,自己的名字被用於 AI 評論角色,但事前並未獲得任何授權或合作邀請。

學者批評未經授權使用名義,甚至模擬已故學者

批評聲浪中最具爭議的一點,在於 AI 工具可能模擬已故學者的評論風格。部分學者指出,這種做法等同於“讓 AI 復活學者”,以其名義對文章進行評價。

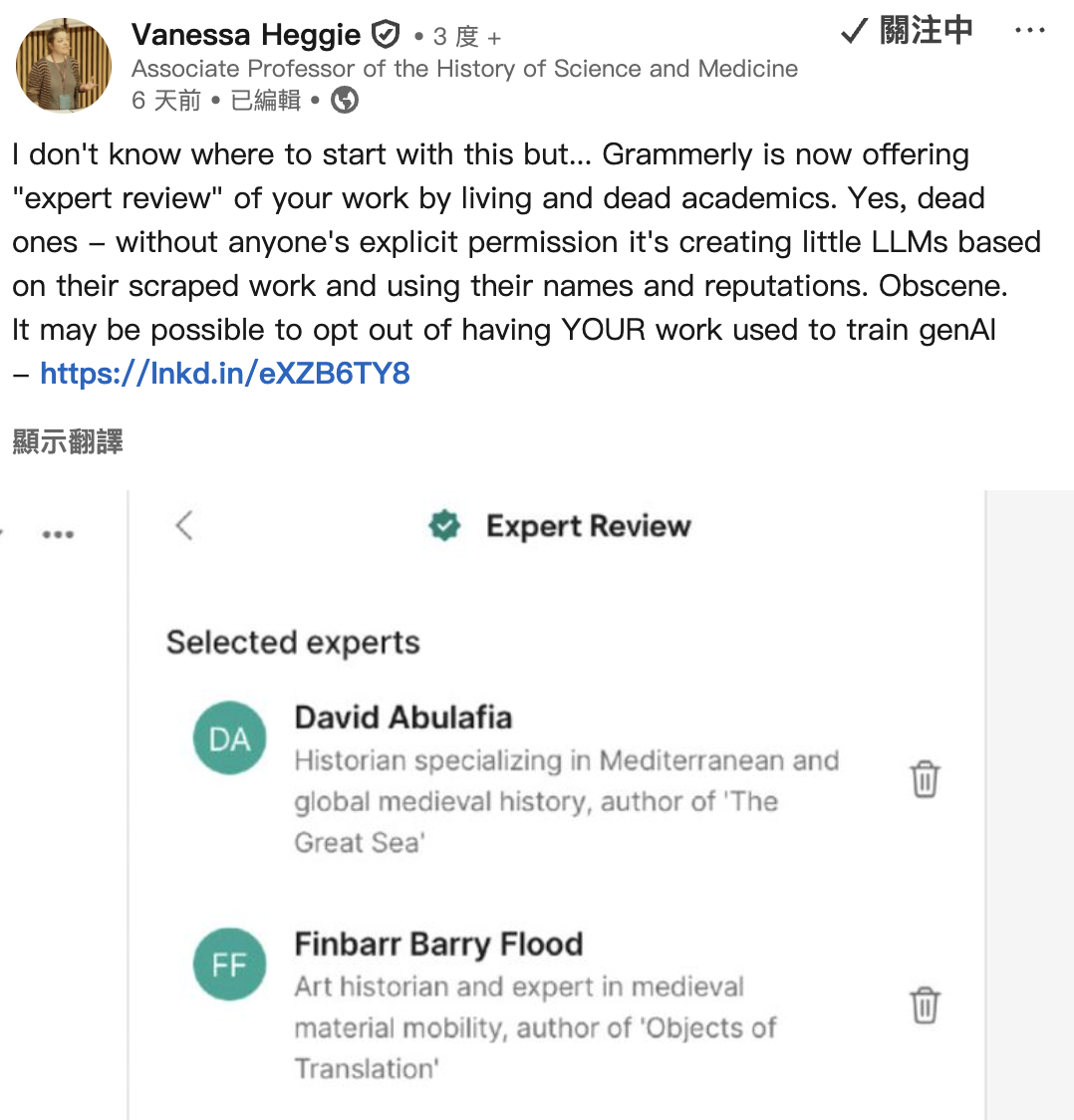

英國伯明罕大學歷史學教授 Vanessa Heggie 在 LinkedIn 上公開批評此功能,指出 Grammarly 正在使用學者的研究成果建立語言模型,並以其姓名與聲譽作為 AI 評論角色。她質疑,這些學者是否曾授權公司使用其作品訓練模型,或同意以自身名義提供“AI 審稿”。

圖源:LinkedIn 英國伯明罕大學歷史學教授 Vanessa Heggie 在 LinkedIn 上公開批評此功能

Heggie 表示,許多學者甚至已經過世,卻仍被 AI 工具當成評論角色。她認為,未經同意就利用學者的研究成果與學術聲譽建立 AI 模型,是一種令人難以接受的行為。

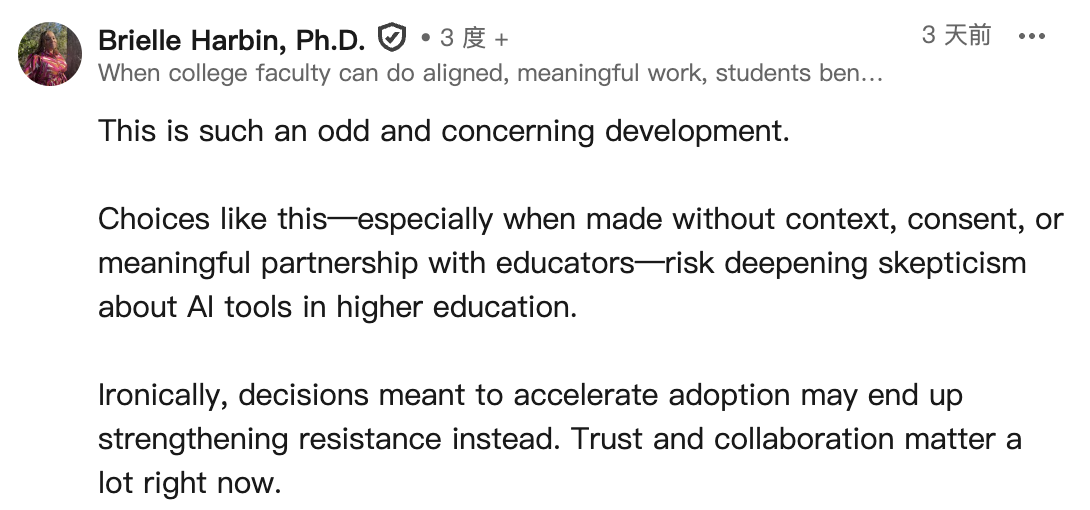

另一名學者、前美國海軍學院政治學副教授 Brielle Harbin 也表示,這項功能讓人感到不安。她指出,在沒有任何背景說明、授權或合作關係的情況下,AI 公司直接以學者名義建立評論模型,可能會加深教育界對 AI 工具的不信任。

圖源:LinkedIn 前美國海軍學院政治學副教授 Brielle Harbin 也表示,這項功能讓人感到不安

Harbin 認為,目前高等教育產業對 AI 工具仍處於觀望階段。若科技公司在設計產品時忽視學界合作與倫理問題,原本希望加速 AI 採用的決策,反而可能引發更大的抵制聲浪。

Grammarly 轉型 AI 平台,寫作助手走向生產力代理

Grammarly 最早於 2009 年推出,原本定位為 AI 文法與寫作輔助工具。隨著生成式 AI 技術快速發展,公司近年逐步將產品從單一寫作助手轉型為多功能 AI 生產力平台。2025 年 10 月,Grammarly 母公司宣佈品牌重塑,將企業定位轉為“Superhuman”,象徵其產品不再只是文法檢查工具,而是一系列 AI 工作代理(AI Agents)。

目前公司產品線已拓展至多種應用,包括研究協助、電子郵件撰寫、行程管理與工作流程自動化等功能。Expert Review 便是其中一項新推出的 AI 代理服務。在官方說明中,Grammarly 表示 Expert Review 旨在協助學生、研究者與專業人士改善寫作品質。例如當使用者撰寫行銷提案、學術報告或商業文件時,系統會分析文本內容,並提供模擬專家的評論。

公司強調,該功能並未聲稱這些專家真的參與審稿,也不代表專家對內容背書,而是透過大型語言模型整理相關學者的研究成果,提出建議。

不過,這種“模擬專家視角”的設計方式,仍被批評可能誤導使用者,使人誤以為這些評論與學者本人有直接關聯。

AI 模仿名人成為科技產業新趨勢

Grammarly 並非唯一嘗試模擬名人或學者的 AI 公司。近年多家科技企業都推出類似產品,希望利用知名人物形象提升 AI 互動體驗。

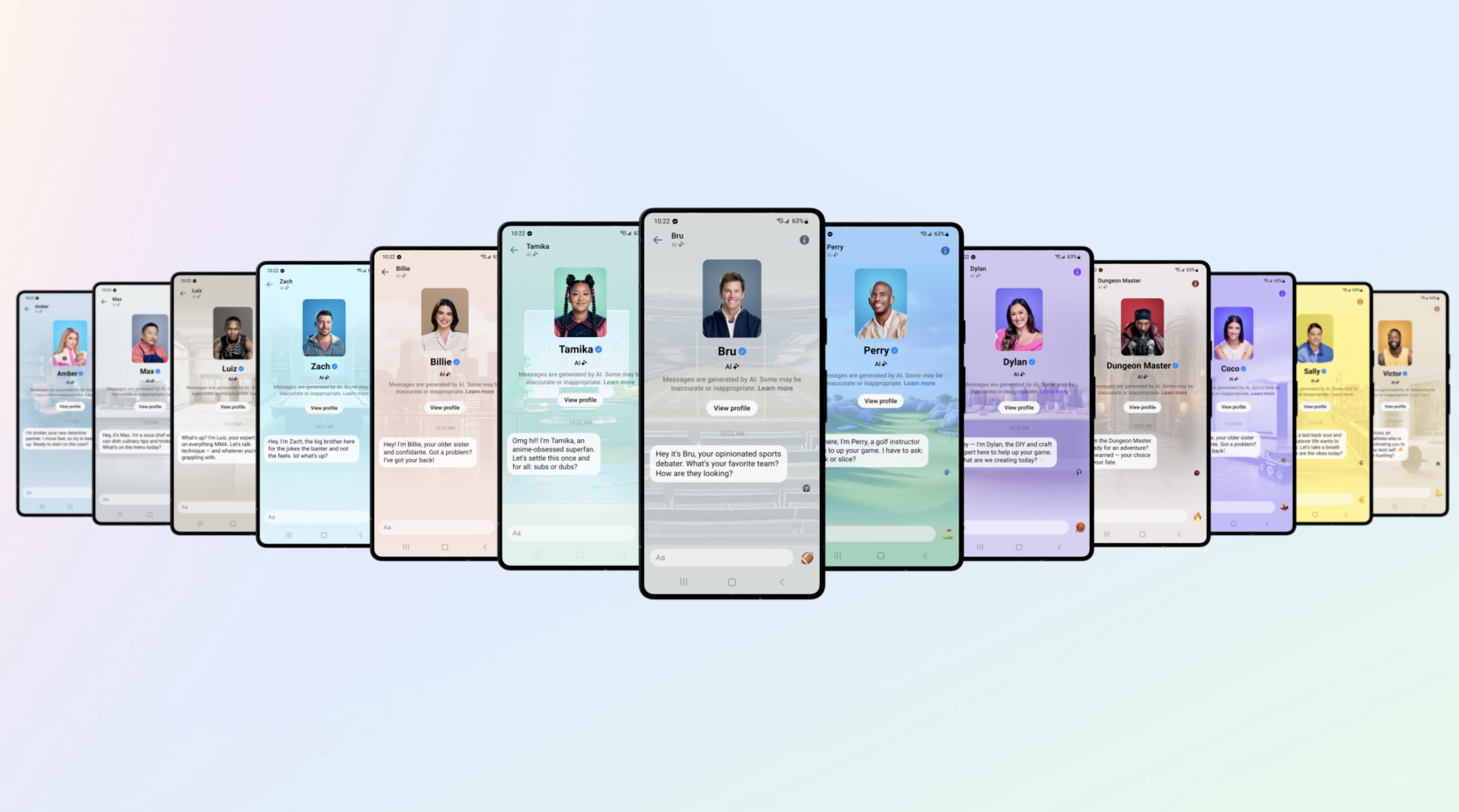

2023 年,Meta 曾為其 Meta AI 平台推出一系列名人聊天機器人,包括以饒舌歌手 Snoop Dogg、NFL 球星 Tom Brady、模特兒 Kendall Jenner 以及網球選手 Naomi Osaka 為原型的 AI 角色。這些 AI 角色以名人形象與語氣進行互動,吸引使用者嘗試 AI 聊天服務。

圖源:Meta 曾為其 Meta AI 平台推出一系列名人聊天機器人

教育產業也出現類似模式。線上教育平台 Khan Academy 推出的 AI 助教“khanmigo”,允許學生與歷史人物進行角色扮演式對話。例如學生可以模擬與英國前首相邱吉爾(Winston Churchill)或美國地下鐵路領袖哈莉特·塔布曼(Harriet Tubman)進行交流,以理解歷史背景與思想。

然而,隨著 AI 模型越來越能模擬個人風格,關於授權與人格權的討論也逐漸升溫。**部分專家指出,當 AI 系統以某位學者、作家或名人的身份提供意見時,可能影響公眾對該人物觀點的理解。**學界人士認為,未來若 AI 公司要使用學者或名人的思想與形象,可能需要更清楚的授權機制與透明說明。否則,即使技術上只是“靈感來源”,仍可能涉及名譽、知識產權與學術倫理等複雜問題。