Anthropic 起诉川普政府:「供应链风险」标签属于非法报复

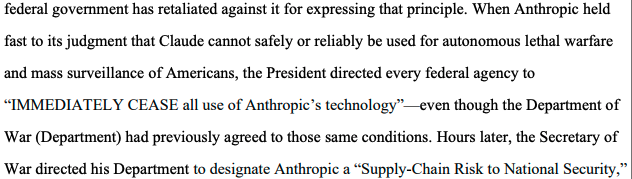

人工智能软件Claude的开发商Anthropic周一在加州联邦法院对川普政府提起诉讼,指控政府对该公司发动了一场“非法报复行动”,理由是Anthropic拒绝允许军方不受限制地使用其技术——包括用于致命性自主武器和大规模国内监控。这是美国历史上首次有一家本土公司被认定为军事供应链风险。

供应链风险标签:五角大楼的史无前例认定

此次法律战的起点,是国防部长Pete Hegseth在2026年3月3日最终确定的一项决定:将Anthropic列为军事供应链风险企业。这项认定的法律后果直接且严重——任何与军方有业务往来的个人或企业,将不得同时与Anthropic进行任何交易,等同于从联邦采购市场中彻底将其驱逐。

值得注意的是,这种供应链风险认定在过去仅被用于那些被认定与外国敌对势力存在关联的公司,从未适用于美国本土企业。Anthropic在诉讼中将此称为“史无前例且非法”的行为,并主张:“宪法不允许政府动用其巨大的权力来惩罚一家受保护的言论公司。”

此次法律挑战的被告阵容庞大,包括Pete Hegseth(国防部长)、Scott Bessent(财政部长)、Marco Rubio(国务卿)以及另外17个政府机构和官员,涵盖美国联邦政府的多个核心部门。

Anthropic的核心红线:致命武器与大规模监控

(来源:CourtListener)

(来源:CourtListener)

根据Anthropic在诉讼中的陈述,Hegseth要求该公司“彻底放弃其使用限制”——而Anthropic拒绝的原因,是这些限制条款本身就是其政府合同的组成部分,旨在防止Claude被用于两类特定用途:

致命性自主武器系统:即不需要人类最终决策确认的自动化杀伤决策系统

对美国公民的大规模监控:利用AI技术进行大规模收集和分析公民个人数据

Anthropic在诉讼中明确表示:“Anthropic从未针对这些用途测试过Claude。目前Anthropic并不确信,如果将Claude用于支持致命的自主战争,它能否可靠或安全地运行。”

这一立场与Anthropic长期以来的AI安全优先原则一致,但与川普政府扩大军事AI应用的政策方向发生了根本性冲突。值得注意的是,美国政府和五角大楼自2024年起一直在使用Anthropic技术,Claude更是第一个被部署在机密工作环境中的AI。这次标签认定也伴随着川普直接下令联邦雇员停止使用Claude的行政指令。

OpenAI与Google工程师联署声援:AI行业的集体响应

法律战爆发后,AI行业的反应迅速且广泛。周一,来自OpenAI和Google的30多名工程师与科学家,包括Google首席科学家Jeff Dean,提交了一份法律支持文件(amicus brief),公开声援Anthropic。

这些业界人士在文件中警告:“如果允许这种惩罚美国领先AI公司之一的行动继续下去,无疑会对美国在人工智能及其他领域的工业和科学竞争力产生负面影响。”这一说法指向一个更宏观的担忧——若美国政府以供应链风险为由打压本土AI公司,可能削弱美国在全球AI竞赛中对抗中国的核心优势。

常见问题

“供应链风险”标签对Anthropic的具体影响是什么?

根据美国法律,被列为供应链风险企业意味着任何与军方有业务往来的个人或实体,都不得同时与被列名公司进行交易。这相当于把Anthropic从整个联邦政府采购生态中切除,影响不仅限于直接军事合同,还包括所有有政府业务的供应商和合作伙伴。

Anthropic为何拒绝开放致命武器相关用途?

Anthropic的立场是Claude从未针对致命性自主武器场景进行过测试和安全评估,公司目前无法确保在此类应用场景下的可靠性和安全性。此外,Anthropic一贯的AI安全原则反对在没有充分测试的情况下部署高风险的自主决策系统,尤其在涉及人命的军事场景中。

Google和OpenAI工程师声援Anthropic意味着什么?

30名来自竞争对手公司的工程师和科学家跨越商业竞争联署声援,反映出AI行业对政府以供应链标签干预AI公司的深切忧虑。他们的声援指向一个共同利益:若政府可以用此类工具打压不配合的AI公司,任何拒绝开放技术限制的公司都可能面临相同命运。