OpenAI 发布 GPT-5.4 Mini 与 Nano:速度翻倍、专为 AI 子代理时代设计,最低每百万 token 仅 $0.2

OpenAI 于今(18)日正式推出两款轻量新模型 GPT-5.4 Mini 与 GPT-5.4 Nano,前者速度较前代提升 2 倍、定价每百万输入 token 仅 $0.75,后者更以超低延迟与极具竞争力的 $0.20 定价抢攻高吞吐量市场。

(前情提要:OpenAI 推出 GPT-5.2!冲着取代专业人士、幻觉更低,API 费用整理)

(背景补充:OpenAI 最强 GPT-5 发布会全整理:免费开放、功能亮点、gpt-5、gpt-5-mini 和 gpt-5-nano API 价格)

本文目录

切换

- GPT-5.4 Mini:2 倍速度,全能型轻量主力

- GPT-5.4 Nano:超低延迟,冲着高吞吐量场景而来

- 子代理架构:小模型不是降级版,是系统设计的一部分

OpenAI 在今(18)日午夜同步推出 GPT-5.4 Mini 与 GPT-5.4 Nano 两款小型语言模型。这两款模型并非旗舰等级,而是被明确设计为混合 AI 系统中的执行层:由更强大的旗舰模型统筹排程,大量小型模型在背后并行完成日常计算工作。

OpenAI 将这套架构称为“以部分精确度换取速度与成本效益的显著提升”,而这场取舍,正是当前 AI 产业从单一大模型走向“多代理协作”的缩影。

GPT-5.4 Mini:2 倍速度,全能型轻量主力

GPT-5.4 Mini 是这次发布的核心产品,主打速度与多工能力的平衡。相比前代,它的推理速度提升了 2 倍,并在代码生成、多模态理解与工具调用等关键能力上全面升级。

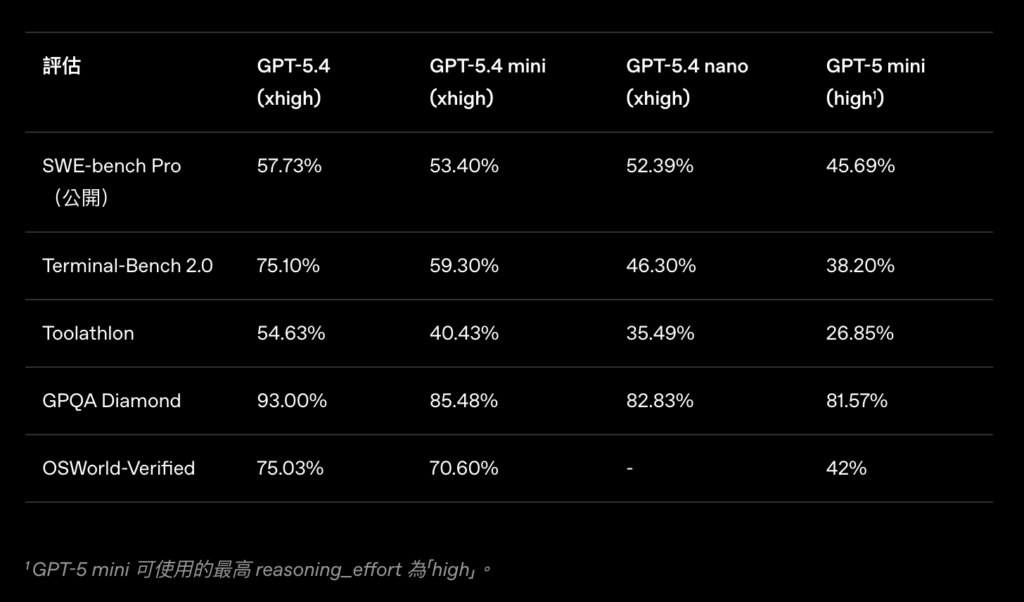

在基准测试方面,GPT-5.4 Mini 在 SWE-Bench Pro(GitHub issue 自动修复)达到 54.4%,在 OSWorld-Verified(桌面操作自动化)则达到 72.1%,两项数字均代表当前同级模型的领先水平。

功能层面,它支持文字与图片混合输入、工具调用、网络与文件搜索,以及电脑操作 UI 互动,几乎覆盖现代 AI 应用的完整需求链。OpenAI 官方列出的主要使用场景包括:代码助手、IDE 集成、代码审查、截图解读、电脑使用子代理,以及需要即时响应的互动系统。

定价方面,GPT-5.4 Mini 的输入定为每百万 token $0.75,输出则为 $4.50,延续 OpenAI 近期积极压低成本的策略方向。

可用性上,GPT-5.4 Mini 即日起在 ChatGPT(免费层与 Go 订阅层)、Codex 及 OpenAI API 全面开放,同时也可通过 Azure AI Foundry 部署。

GPT-5.4 Nano:超低延迟,冲着高吞吐量场景而来

GPT-5.4 Nano 定位更为明确:OpenAI 将它称为“目前最小、最具成本效益的模型”,专为对延迟极度敏感、需要大规模并行处理的场景量身打造。

在基准测试上,Nano 的 SWE-Bench Pro 分数为 52.4%,OSWorld 则为 39.0%,虽略逊于 Mini,但考虑其超低的定价,性价比相当突出。

功能范围上,Nano 支持指令跟随、函数调用、基础代码、图片理解、分类与资料提取,能够应对大多数结构化任务需求,但并不支持复杂的桌面操作或深度推理任务。

定价方面,Nano 的输入仅需每百万 token $0.20,输出 $1.25,约为 Mini 定价的四分之一,适合需要大量自动化调用的企业用户。官方列举的场景包括:分类与资料提取、代码子代理支持、高量自动化、请求路由、表单处理,以及客服工作流程。

值得注意的是,GPT-5.4 Nano 目前仅限 API 访问,不会出现在 ChatGPT 的用户界面中,明确定位为开发者与企业端产品。

子代理架构:小模型不是降级版,是系统设计的一部分

OpenAI 为这两款模型打出的宣传语是“为子代理时代而生”,这句话背后有其具体的产品逻辑。

在多代理 AI 系统中,旗舰模型(如 GPT-5 或 o 系列推理模型)负责高层规划与复杂判断,而大量重复性、结构化的子任务:网页采集、资料转换、表单填写、代码片段生成,则可以交由更小、更快、更便宜的模型平行处理。GPT-5.4 Mini 与 Nano 正是为这个执行层角色而设计。

这套思路也解释了为何两款模型都强调工具调用与电脑操作能力:在自动化程度愈来愈高的 AI 应用架构中,能够稳定执行指令、与外部系统互动的小型模型,其商业价值并不亚于参数量更大的旗舰模型。