يُطلق DeepSeek V4-Pro بتكلفة أقل بنسبة 98% من GPT-5.5 Pro

أصدرت DeepSeek إصدارات تجريبية من DeepSeek-V4-Pro وDeepSeek-V4-Flash في 24 أبريل 2026، وكلاهما نماذج مفتوحة الوزن بقدرة نافذة سياق من مليون توكن وأسعار أقل بكثير من البدائل الغربية المتقاربة. تبلغ تكلفة نموذج V4-Pro $1.74 لكل مليون توكنات إدخال و$3.48 لكل مليون توكنات إخراج—أي تقريبًا 1/20 من سعر Claude Opus 4.7 ويمثل 98% أقل من GPT-5.5 Pro، وفقًا للمواصفات الرسمية للشركة.

هندسة النموذج والنطاق

يتميز DeepSeek-V4-Pro بـ 1.6 تريليون معامل إجمالي، ما يجعله أكبر نموذج مفتوح المصدر في سوق LLM حتى الآن. ومع ذلك، يتم تفعيل 49 مليار معامل فقط لكل تمريرة استدلال واحدة، باستخدام ما تسميه DeepSeek نهج “Mixture-of-Experts” الذي تم تحسينه منذ V3. يسمح هذا التصميم للموديل الكامل بالبقاء خاملاً بينما يتم تفعيل الأجزاء ذات الصلة فقط لأي طلب معين، مما يقلل تكاليف الحوسبة مع الحفاظ على سعة المعرفة.

يعمل DeepSeek-V4-Flash على نطاق أصغر بـ 284 مليار معامل إجمالي و13 مليار معامل نشط. ووفقًا لمعايير DeepSeek، فإنه “يحقق أداء استدلالًا مماثلاً لإصدار Pro عند منحه ميزانية تفكير أكبر”.

يدعم كلا النموذجين مليون توكن من السياق كميزة قياسية—أي تقريبًا 750,000 كلمة، أو تقريبًا ثلاثية “Lord of the Rings” كاملة بالإضافة إلى نص إضافي.

ابتكار تقني: آليات الانتباه على نطاق واسع

عالجت DeepSeek مشكلة التوسع الحوسبي الكامنة في معالجة السياق الطويل من خلال اختراع نوعين جديدين من آليات الانتباه، كما ورد بالتفصيل في الورقة التقنية للشركة المتاحة على GitHub.

تواجه آليات الانتباه التقليدية في الذكاء الاصطناعي مشكلة توسع قاسية: في كل مرة يتضاعف فيها طول السياق، ترتفع تكلفة الحوسبة تقريبًا إلى أربعة أضعاف. تتضمن حلول DeepSeek نهجين متكاملين:

Compressed Sparse Attention يعمل على خطوتين. يقوم أولاً بضغط مجموعات من التوكنات—على سبيل المثال، كل 4 توكنات—إلى مُدخل واحد. بعد ذلك، بدلًا من الانتباه إلى جميع المُدخلات المضغوطة، يستخدم “Lightning Indexer” لاختيار النتائج الأكثر صلة فقط لأي استعلام معين. يؤدي هذا إلى تقليص نطاق انتباه النموذج من مليون توكن إلى مجموعة أصغر بكثير من الأجزاء المهمة.

Heavily Compressed Attention يتبع نهجًا أكثر حدة، حيث ينهار كل 128 توكنًا إلى مُدخل واحد دون اختيار متفرق. ورغم أنه يفقد التفاصيل الدقيقة، فإنه يوفر نظرة عالمية رخيصة للغاية. تعمل آليتا الانتباه في طبقات متناوبة، مما يسمح للنموذج بالحفاظ على كلّ من التفاصيل والملخص.

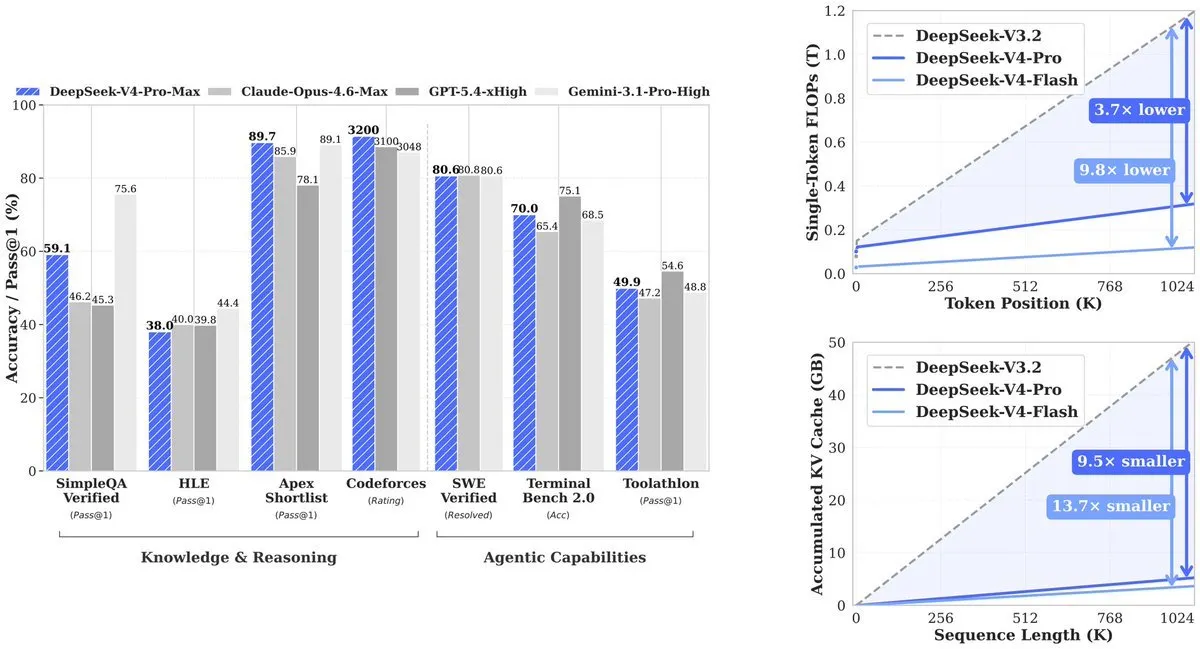

النتيجة: يستخدم V4-Pro 27% من الحوسبة التي احتاجها سلفه (V3.2). ينخفض KV cache—الذاكرة اللازمة لتتبع السياق—إلى 10% من V3.2. يدفع V4-Flash الكفاءة أكثر: 10% من الحوسبة و7% من الذاكرة مقارنةً بـ V3.2.

أداء المعايير والتموضع التنافسي

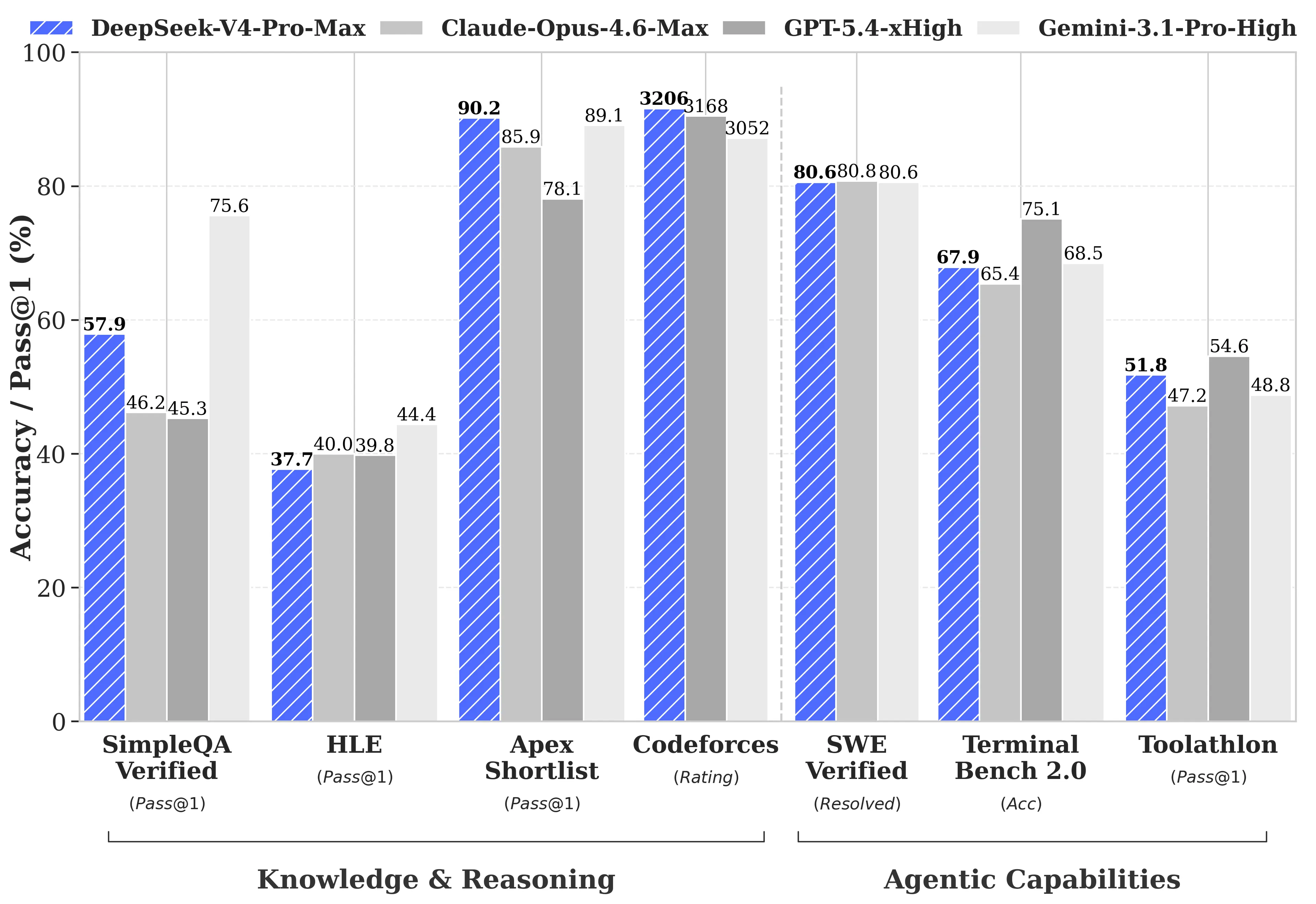

نشرت DeepSeek مقارنات شاملة للمعايير مقابل GPT-5.4 وGemini-3.1-Pro، بما في ذلك المجالات التي يتأخر فيها V4-Pro عن المنافسين. في مهام الاستدلال، يتأخر استدلال V4-Pro عن GPT-5.4 وGemini-3.1-Pro بما يقارب ثلاثة إلى ستة أشهر، وفقًا لتقرير DeepSeek التقني.

حيث يتفوق V4-Pro:

- Codeforces (البرمجة التنافسية): سجل V4-Pro 3,206، مما يجعله في المرتبة تقريبًا 23 بين المشاركين البشر الفعليين في المسابقات

- Apex Shortlist (مسائل رياضيات وSTEM مُنسّقة): معدل اجتياز 90.2% مقابل 85.9% لOpus 4.6 و78.1% لـ GPT-5.4

- SWE-Verified (حل قضايا GitHub): 80.6%، مطابقًا لـ Claude Opus 4.6

حيث يتراجع V4-Pro:

- MMLU-Pro (تعدد المهام): Gemini-3.1-Pro بنسبة 91.0% مقابل 87.5% لـ V4-Pro

- GPQA Diamond (المعرفة المتخصصة): Gemini بنسبة 94.3 مقابل 90.1 لـ V4-Pro

- Humanity’s Last Exam (مستوى دراسات عليا): Gemini-3.1-Pro بنسبة 44.4% مقابل 37.7% لـ V4-Pro

في مهام السياق الطويل، يتصدر V4-Pro نماذج مفتوحة المصدر ويتفوق على Gemini-3.1-Pro في CorpusQA (محاكاة تحليل وثائق واقعي بسياق مليون توكن)، لكنه يخسر أمام Claude Opus 4.6 في MRCR، والذي يقيس استرجاع معلومات محددة مدفونة بعمق داخل نص طويل.

قدرات الوكلاء والترميز

يمكن لـ V4-Pro التشغيل في Claude Code وOpenCode وأدوات ترميز ذكاء اصطناعي أخرى. ووفقًا لمسح DeepSeek الداخلي لـ 85 مطورًا استخدموا V4-Pro كعامل ترميز أساسي لديهم، قال 52% إنه جاهز ليكون نموذجهم الافتراضي، ومال 39% إلى “نعم”، وأقل من 9% قالوا “لا”. وأظهرت اختبارات DeepSeek الداخلية أن V4-Pro يتفوق على Claude Sonnet ويقترب من Claude Opus 4.5 في مهام الترميز الوكيلي.

صنفت Artificial Analysis V4-Pro في المرتبة الأولى بين جميع نماذج open-weight على GDPval-AA، وهو معيار يختبر أعمال معرفة قيّمة اقتصاديًا عبر مهام المالية والقانون والبحث. سجل V4-Pro-Max 1,554 Elo، متقدمًا على GLM-5.1 (1,535) وMiniMax’s M2.7 (1,514). يسجل Claude Opus 4.6 على نفس المعيار 1,619.

يقدم V4 “التفكير المتداخل” الذي يحتفظ بسلسلة الفكر الكاملة عبر استدعاءات الأدوات. في النماذج السابقة، عندما يقوم الوكيل بعدة استدعاءات أدوات—مثل البحث في الويب، ثم تشغيل الكود، ثم البحث مجددًا—يتم مسح سياق تفكير النموذج بين الجولات. يحافظ V4 على استمرارية التفكير عبر الخطوات، مما يمنع فقدان السياق في سير العمل الآلي المعقد.

المشهد التنافسي وسياق التسعير

يأتي إصدار V4 وسط نشاط كبير في مجال الذكاء الاصطناعي. قامت Anthropic بشحن Claude Opus 4.7 في 16 أبريل 2026. أطلق OpenAI GPT-5.5 في 23 أبريل 2026، مع تسعير GPT-5.5 Pro عند $30 لكل مليون توكن إدخال$180 و(لكل مليون توكن إخراج). يتفوق GPT-5.5 على V4-Pro في Terminal Bench 2.0 (82.7% مقابل 70.0%)، والذي يختبر سير عمل وكلاء أوامر معقدة عبر سطر الأوامر.

أطلقت Xiaomi MiMo V2.5 Pro في 22 أبريل 2026، مقدمة قدرات multimodal كاملة $1 صورة, صوت, فيديو$3 عند (إدخال) وإخراج لكل مليون توكن. أطلقت Tencent Hy3 في اليوم نفسه الذي أطلق فيه GPT-5.5.

لأجل منظور التسعير: أشار الرئيس التنفيذي لشركة Cline Saoud Rizwan إلى أنه لو كان Uber قد استخدم DeepSeek بدلًا من Claude، فإن ميزانية Uber للذكاء الاصطناعي لعام 2026—التي يُفترض أنها تكفي لأربعة أشهر من الاستخدام—كانت ستستمر سبع سنوات.

![Pricing comparison and Uber budget analysis]https://img-cdn.gateio.im/social/moments-0ee5a4bf95-cbc5686e31-8b7abd-badf29

النشر والتوفر

كلا من V4-Pro وV4-Flash مرخّصان بموجب MIT ومتاحان على Hugging Face. النماذج متاحة كنص فقط حتى الآن؛ ذكرت DeepSeek أنها تعمل على قدرات multimodal. يمكن تشغيل كلا النموذجين مجانًا على عدة أجهزة محلية أو تخصيصهما وفقًا لاحتياجات الشركة.

تقوم نقاط نهاية deepseek-chat الحالية لدى DeepSeek وdeepseek-reasoner بالفعل بتوجيه الطلبات إلى V4-Flash في وضع non-thinking ووضع thinking على التوالي. ستتقاعد نقاط النهاية القديمة deepseek-chat وdeepseek-reasoner في 24 يوليو 2026.

قامت DeepSeek بتدريب V4 جزئيًا على شرائح Huawei Ascend، متجاوزةً قيود التصدير الأمريكية. وذكرت الشركة أنه بمجرد أن تأتي 950 عقدة فائقة جديدة إلى الإنترنت لاحقًا في عام 2026، سينخفض سعر نموذج Pro المنخفض أصلًا أكثر.

الآثار العملية

بالنسبة للمؤسسات، قد يتغير هيكل التسعير حسابات الفائدة مقابل التكلفة. نموذج يتصدر معايير open-source بسعر $1.74 لكل مليون توكن إدخال يجعل معالجة المستندات على نطاق واسع، والمراجعة القانونية، وخطوط توليد الكود أرخص بكثير مقارنةً بمدة ستة أشهر سابقة. يسمح سياق مليون توكن بمعالجة قواعد أكواد كاملة أو إيداعات تنظيمية في طلب واحد بدلًا من تقسيمها عبر عدة استدعاءات.

بالنسبة للمطورين وبناة المنتجات الفرديين، يعتبر V4-Flash الاعتبار الأساسي. بسعر $0.14 لإدخال و$0.28 لإخراج لكل مليون توكن، فهو أرخص من النماذج التي كانت تُعتبر ضمن خيارات “الميزانية” قبل عام، مع التعامل مع معظم المهام التي يديرها إصدار Pro.