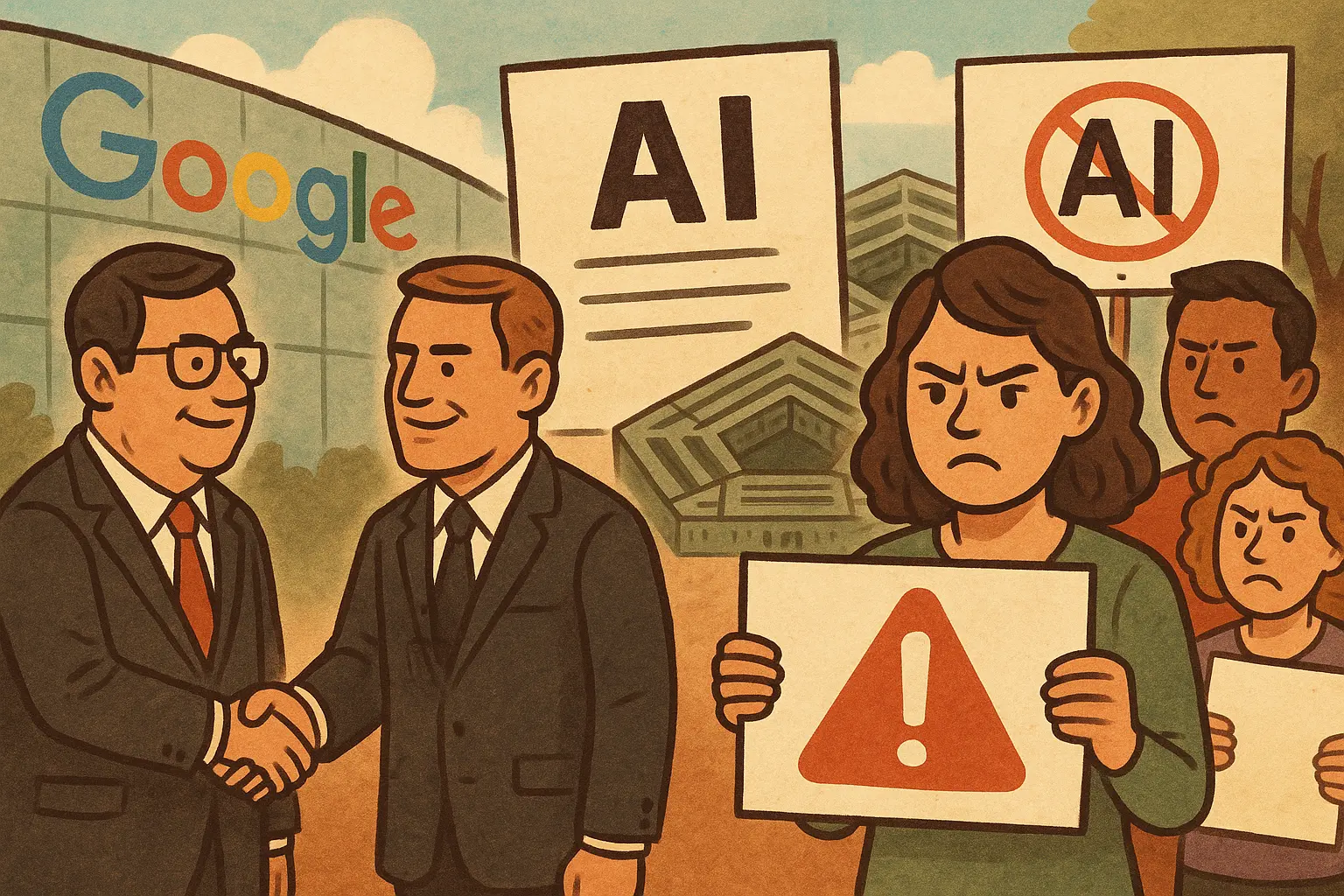

Google et le Pentagone signent un accord confidentiel d’IA, un appel des employés s’y oppose

Selon The Information dans son rapport du 28 avril, Google a signé un accord visant à fournir au Pentagone des modèles d’intelligence artificielle (IA) destinés à des tâches confidentielles. Le New York Times, citant des personnes informées, indique que cet accord permet au ministère de la Défense américain d’utiliser l’IA de Google à des fins gouvernementales légitimes, dans des termes similaires à l’accord de déploiement d’IA confidentielle signé par le Pentagone le mois dernier avec OpenAI et xAI.

Contenu de l’accord et contexte multi-acteurs

D’après le New York Times, citant des personnes informées, l’accord entre Google et le Pentagone permet au DoD d’utiliser les modèles d’IA de Google dans des travaux confidentiels. Le Pentagone a achevé le mois dernier des signatures similaires avec OpenAI et xAI, autorisant le déploiement de modèles d’IA sur des réseaux confidentiels ; l’accord de Google constitue le dernier exemple en date d’une extension de la coopération en matière d’IA pour le Pentagone.

Un porte-parole de Google a déclaré au New York Times : « Nous sommes honorés de faire partie d’une large coalition composée de laboratoires d’IA, d’équipes techniques et d’entreprises cloud de premier plan, afin de fournir des services et des infrastructures d’IA pour la sécurité nationale. » De son côté, Decrypt a demandé à Google un commentaire à ce sujet ; au moment de la publication du rapport, Google n’avait pas encore répondu.

Lettre ouverte des employés : exhortation à refuser des charges de travail confidentielles

D’après le rapport du New York Times, avant la signature de l’accord, des centaines d’employés de Google avaient signé une lettre ouverte et l’avaient adressée au PDG Sundar Pichai, exhortant l’entreprise à ne pas fournir au Pentagone des systèmes d’IA destinés à des tâches confidentielles.

La lettre ouverte écrit : « Nous voulons que l’IA profite à l’humanité, et non qu’elle soit utilisée à des fins inhumaines ou extrêmement préjudiciables. Pour l’instant, le seul moyen de garantir que Google n’est pas associé à de tels dangers est de refuser toute charge de travail confidentielle. Sinon, de tels usages pourraient se produire sans que nous en ayons connaissance ou sans que nous puissions les empêcher. »

La lettre cite comme principales inquiétudes « des armes autonomes létales et une surveillance à grande échelle », avertissant que « prendre maintenant une mauvaise décision causerait un dommage irréparable à la réputation de Google, à ses activités et à sa position dans le monde ».

Processus d’intégration de l’IA au Pentagone et l’affaire Anthropic

Selon le New York Times, le secrétaire à la Défense Pete Hegseth a déclaré, en janvier de cette année, lors d’un discours prononcé à la Starbase d’Elon Musk : « L’Amérique doit gagner la compétition stratégique pour la domination technologique du XXIe siècle », ajoutant : « Chacun de nos réseaux non confidentiels et confidentiels sera bientôt doté de modèles d’IA de pointe. » Depuis, le Pentagone a accéléré sa démarche pour conclure des accords avec les principales sociétés d’IA.

En ce qui concerne le contexte, selon des reportages pertinents, en mars de cette année le Pentagone a classé Anthropic comme une entreprise présentant un « risque pour la chaîne d’approvisionnement », en raison du refus du PDG d’Anthropic, Dario Amodei, d’autoriser le gouvernement fédéral à utiliser son IA sans restrictions ; Anthropic a ensuite intenté une action en justice contre le Pentagone au sujet de cette décision et a cherché à continuer à collaborer avec d’autres départements du gouvernement.

Questions fréquentes

Quels usages l’accord d’IA confidentielle entre Google et le Pentagone autorise-t-il ?

D’après le New York Times, citant des personnes informées, l’accord permet au DoD d’utiliser l’IA de Google à des « fins gouvernementales légitimes quelconques ». Un porte-parole de Google a déclaré que la société insiste sur le fait que l’IA ne doit pas être utilisée pour de la surveillance intérieure à grande échelle ou des armes autonomes sans supervision humaine.

Avec quelles entreprises d’IA le Pentagone a-t-il signé des accords similaires ?

D’après le rapport du New York Times, le Pentagone a signé le mois dernier, respectivement avec OpenAI et xAI, des accords permettant le déploiement d’IA sur des réseaux confidentiels ; l’accord de Google constitue le dernier exemple en date de ce type de collaboration.

Quelle est la position d’Anthropic sur des sujets similaires ?

Selon des reportages pertinents, en mars de cette année le Pentagone a classé Anthropic comme une entreprise présentant un « risque pour la chaîne d’approvisionnement », en raison du refus d’Anthropic d’autoriser le gouvernement fédéral à utiliser sans limites ses modèles d’IA ; Anthropic a ensuite intenté une action en justice contre le Pentagone au sujet de cette décision et a cherché à continuer à collaborer avec d’autres départements du gouvernement.

Articles similaires

LG étend son partenariat avec Nvidia vers l’IA physique, couvrant la robotique et les centres de données

Le coût de tokenisation de la langue chinoise de Claude est 65 % plus élevé que celui de l’anglais ; OpenAI seulement 15 % de plus

Les analystes des semi-conducteurs voient une tendance haussière de l’IA : « au moins encore trois ans » : le conditionnement avancé est le principal goulot d’étranglement de l’industrie

AWS étend l’intégration d’OpenAI dans Amazon Bedrock

Chercheurs d’OpenAI : les systèmes d’IA pourraient gérer la plupart des travaux de recherche dans deux ans

Le roi Charles III rencontre six PDG de la tech américaine, dont Jensen Huang, Jeff Bezos et Tim Cook, pour discuter du financement des start-ups au Royaume-Uni