Обзор технологии Reddio: от параллельного EVM до искусственного интеллекта

Автор: Ву Юэ, гик web3

В сегодняшних быстро меняющихся технологиях блокчейна оптимизация производительности стала ключевой темой. План развития Ethereum очень ясно сосредоточен на Rollup, а характеристика последовательной обработки транзакций EVM становится ограничением, неспособным удовлетворить будущие сценарии высоких параллельных вычислений.

В предыдущей статье — «Путь оптимизации параллельной EVM, рассмотренный из Reddio», мы кратко изложили концепцию параллельного дизайна EVM в Reddio, а в сегодняшней статье мы более подробно рассмотрим его техническое решение и сценарии совместного использования с искусственным интеллектом.

Благодаря техническому решению Reddio, использующему CuEVM, проект, направленный на увеличение эффективности выполнения EVM с использованием GPU, начинается с CuEVM.

Обзор CUDA

CuEVM - это проект по ускорению EVM с помощью GPU, который преобразует опкоды ETH-совместимой EVM в ядра CUDA для параллельного выполнения на графических процессорах NVIDIA. Это позволяет повысить эффективность выполнения инструкций EVM с помощью параллельных вычислений на GPU. Возможно, пользователи с графическими картами NVIDIA часто слышат слово CUDA.

**Compute Unified Device Architecture, на самом деле, это платформа и модель программирования параллельных вычислений, разработанная NVIDIA. Она позволяет разработчикам использовать параллельные вычислительные возможности графического процессора для общих вычислений (например, Майнинг в Crypto, ZK-вычисления и т. д.), а не только для графической обработки.

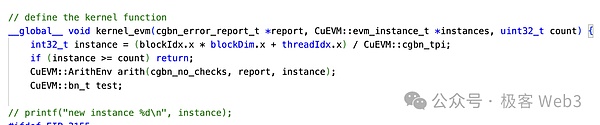

Как расширение языка C/C++, CUDA является открытой параллельной вычислительной платформой, с которой может быстро ознакомиться любой опытный программист, знакомый с языком C/C++. В CUDA важным понятием является ядро (kernel) - это также функция на языке C++.

Однако, в отличие от обычных функций на C++, которые выполняются только один раз, эти ядерные функции выполняются параллельно N раз N-ю раз, когда вызываются синтаксически <<…>> запуска CUDA от N различных потоков.

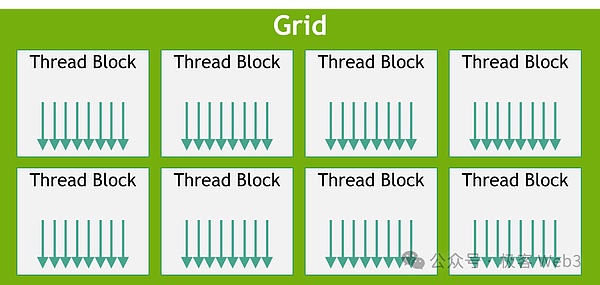

Каждому потоку CUDA назначается собственный идентификатор потока (thread ID), и используется иерархическая структура потоков для распределения потоков на блоки (block) и сетки (grid), чтобы управлять большим количеством параллельных потоков. С помощью компилятора nvcc от NVIDIA мы можем скомпилировать код CUDA в программу, которая может выполняться на GPU.

Основной рабочий процесс CuEVM

После понимания базовых концепций CUDA можно рассмотреть рабочий процесс CuEVM.

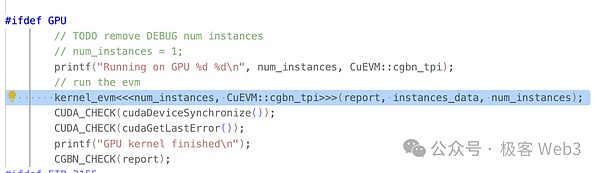

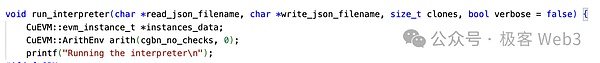

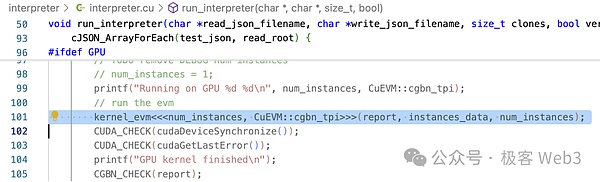

Главный входной модуль CuEVM - это run_interpreter, откуда вводится обрабатываемая параллельно транзакция в формате JSON файла. Из примеров проекта видно, что вводятся стандартные EVM данные, которые не требуют дополнительной обработки или перевода со стороны разработчика.

В функции run_interpreter() можно увидеть, что она вызывает ядерную функцию kernel_evm() синтаксисом <<…>> определенным в CUDA. Как уже упоминалось ранее, ядерная функция вызывается параллельно на GPU.

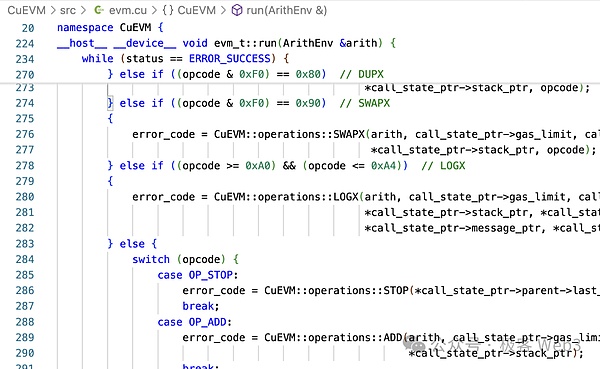

В методе kernel_evm() вызывается evm->run(), и мы видим, что существует множество суждений ветвления для преобразования кода операции EVM в операции CUDA.

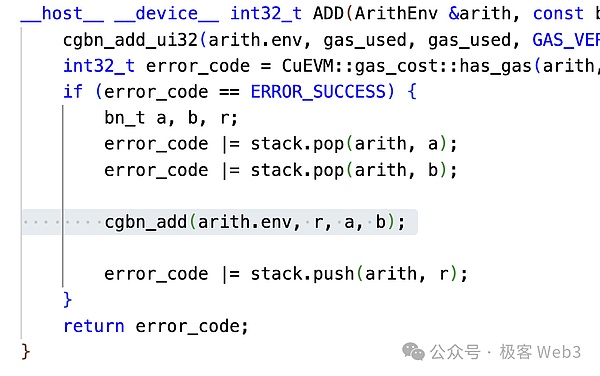

На примере операционного кода OP_ADD в EVM можно увидеть, что он преобразует ADD в cgbn_add. CGBN (Cooperative Groups Big Numbers) представляет собой библиотеку CUDA для высокопроизводительных многозначных целочисленных арифметических операций.

Эти два шага преобразуют операционные коды EVM в операции CUDA. Можно сказать, что CuEVM также является реализацией всех операций EVM на CUDA. Наконец, метод run_interpreter() возвращает результат вычислений, то есть состояние мира и другую информацию.

Основная логика работы CuEVM теперь представлена.

CuEVM имеет возможность параллельной обработки транзакций, но его основная цель (или главный показатель использования) - проведение тестов на Fuzzing: Fuzzing - это автоматизированная техника тестирования программного обеспечения, которая заключается в подаче большого количества недопустимых, неожиданных или случайных данных на вход программе для наблюдения за ее реакцией и выявления потенциальных ошибок и проблем безопасности.

Мы можем видеть, что Fuzzing очень подходит для параллельной обработки. CuEVM не занимается проблемами конфликта транзакций, это не то, что ее волнует. Если вы хотите интегрировать CuEVM, вам все равно придется обрабатывать конфликтующие транзакции.

Мы уже рассказывали о механизме обработки конфликтов, используемом в Reddio, в предыдущей статье «Путь оптимизации параллельной EVM, основанный на Reddio». Здесь не будем повторяться. После сортировки механизма обработки конфликтов Reddio можно отправить в CuEVM. Другими словами, механизм сортировки транзакций на уровне L2 Reddio можно разделить на две части: обработка конфликтов и параллельное выполнение в CuEVM.

Слой 2, трехстороннее пересечение параллельных EVM, AI

Предыдущий текст говорил о том, что параллельная EVM и L2 - это только начальная точка Reddio, а в их будущем плане будет явно объединение с искусственным интеллектом. Reddio, использующий GPU для высокоскоростных параллельных сделок, по своим многим характеристикам естественным образом подходит для вычислений с использованием искусственного интеллекта:

- GPU обладает сильной параллельной вычислительной мощностью и подходит для выполнения сверточных операций в глубинном обучении, которые в своей сути представляют собой масштабные умножения матриц, а GPU оптимизирована для таких задач.

- Иерархическая структура потоков GPU может соответствовать различным структурам данных в AI-вычислениях, повышая вычислительную эффективность с помощью переподгонки потоков и исполнительных блоков Warp, и скрывая задержку памяти.

- Интенсивность вычислений является ключевым показателем оценки вычислительной производительности искусственного интеллекта. GPU оптимизирует вычислительную интенсивность, такую как внедрение тензорных ядер, для улучшения производительности умножения матриц в вычислениях искусственного интеллекта и обеспечения эффективного баланса между вычислениями и передачей данных.

Как именно AI сочетается с L2?

Мы знаем, что в архитектуре Rollup во всей сети на самом деле не только сортировщик, но также есть роли, похожие на наблюдателей и ретрансляторов, которые проверяют или собирают транзакции. По сути, они все используют тот же клиент, что и сортировщик, просто выполняют разные функции. В традиционном Rollup у этих второстепенных ролей очень ограниченные функции и права, например, у роли наблюдателя в Arbitrum, которая в основном является пассивной, защитной и благотворительной, также стоит сомневаться в ее прибыльной модели.

Reddio будет использовать архитектуру сортировщика Децентрализация, где Майнер предоставляет GPU в качестве Узел. Вся сеть Reddio может эволюционировать от простой L2 до L2+AI, что позволяет эффективно реализовывать некоторые сценарии использования AI+Блокчейн:

Основная сеть взаимодействия AI Agent

С развитием технологии Блокчейн, потенциал применения искусственного интеллекта (AI Agent) в сети Блокчейн огромен. Возьмем в качестве примера AI Agent, осуществляющего финансовые сделки. Эти интеллектуальные агенты способны принимать самостоятельные сложные решения и выполнять торговые операции, даже способны быстро реагировать на высокочастотные условия. Однако L1 вряд ли сможет выдержать огромную торговую нагрузку при выполнении таких интенсивных операций.

Будучи проектом L2, Reddio может значительно повысить производительность параллельной обработки транзакций за счет ускорения на GPU. По сравнению с L1, L2, который поддерживает параллельное выполнение транзакций, имеет более высокую пропускную способность и может эффективно обрабатывать большое количество высокочастотных запросов транзакций от агентов ИИ для обеспечения бесперебойной работы сети.

В высокочастотной торговле требования AI агентов к скорости торговли и времени ответа крайне жесткие. L2 сокращает время проверки и выполнения сделок, значительно снижая задержки. Это крайне важно для AI агентов, которые должны реагировать в течение миллисекунд. Перенос большого количества сделок на L2 также эффективно снижает нагрузку на Основную сеть, делая операции AI агентов более экономически эффективными.

С развитием проектов L2, таких как Reddio, AI Agent будет играть более важную роль в блокчейне, стимулируя инновации в сфере децентрализованных финансов и других приложений блокчейна, связанных с искусственным интеллектом.

Рынок Вычислительной мощностиДецентрализация

Reddio未来会采用Децентрализация排序器的架构,Майнер以GPUВычислительная мощность来决定排序权利,整体网络参与者的GPU的性能会随着竞争逐渐提升,甚至能够达到用来作为AI训练的水平。

Построение рынка Вычислительная мощность GPU Децентрализация, предоставляя более низкие затраты ресурсов Вычислительная мощность для обучения и вывода искусственного интеллекта. Вычислительная мощность от малых до больших, от персональных компьютеров до кластеров центров обработки данных, различные уровни Вычислительная мощность GPU могут присоединиться к этому рынку, внести свою неиспользуемую Вычислительная мощность и заработать доход, этот подход может привести к Падение затрат на вычисления искусственного интеллекта, позволяя большему числу людей участвовать в разработке и применении моделей искусственного интеллекта.

В случае использования ДецентрализацияВычислительная мощность на рынке, сортировщик, возможно, не является основным ответственным за прямые вычисления ИИ, его основная функция - обработка транзакций и координация Вычислительная мощность ИИ во всей сети. А по поводу Вычислительная мощность и распределения задач, здесь есть два режима:

- Централизованное распределение сверху вниз. Благодаря сортировщику, полученные запросы на Вычислительную мощность могут быть распределены на Узлы, соответствующие требованиям и имеющие хорошую репутацию. Хотя такой подход к распределению теоретически имеет централизованные и несправедливые проблемы, на практике его преимущества в эффективности гораздо больше, чем недостатки, и в долгосрочной перспективе сортировщику необходимо удовлетворять положительный баланс всей сети, чтобы обеспечить его долгосрочное развитие, то есть имеется неявное, но прямое ограничение, которое гарантирует, что сортировщик не будет иметь слишком серьезных предубеждений.

- Самостоятельный выбор задач снизу вверх. Пользователи также могут передавать запросы на вычисления ИИ стороннему Узлу, что, очевидно, более эффективно в определенных областях применения ИИ, чем прямая передача сортировщику, и может предотвратить проверку и предвзятость сортировщика. После завершения расчетов Узел синхронизирует результаты вычислений с сортировщиком и добавляет их в цепочку.

Мы можем увидеть, что рынок вычислительной мощности в архитектуре L2 + AI имеет высокую гибкость и может собирать вычислительную мощность из двух направлений, максимально повышая эффективность использования ресурсов.

в блокчейнеAI推理

На данный момент зрелость моделей с открытым исходным кодом достаточно высока для удовлетворения разнообразных потребностей. Стандартизация услуг по AI-выводу позволяет исследовать возможности использования вычислительной мощности на цепочке блоков для автоматического ценообразования. Однако для этого необходимо преодолеть множество технических проблем:

- Эффективное распределение и запись запросов: Высокие требования к задержке для вывода больших моделей делают механизм эффективного распределения запросов крайне важным. Несмотря на то, что объем данных запросов и ответов огромен и имеет конфиденциальный характер, их нельзя публично раскрывать в блокчейне, но необходимо найти баланс между записью и проверкой - например, путем хранения хэша.

- Проверка вычислительной мощностиУзла: Действительно ли узел завершил поставленную задачу вычислений? Например, узел может подделать результаты вычислений с использованием маленькой модели вместо большой.

- Рассуждение о смарт-контрактах: во многих сценариях сочетание модели искусственного интеллекта с смарт-контрактом является необходимым. Поскольку выводы искусственного интеллекта содержат неопределенность и не могут быть использованы во всех аспектах блокчейна, логика будущего приложения искусственного интеллекта (AI dApp) вероятно будет частично находиться вне блокчейна, а частично - в блокчейн-контракте, который ограничивает допустимость входных данных и их корректность, предоставленных вне блокчейна. В экосистеме Ethereum, совместное использование смарт-контракта требует учета низкой эффективности последовательной обработки виртуальной машины Ethereum (EVM).

Однако в архитектуре Reddio все это относительно легко решается:

- Распределение запросов с помощью сортировщика гораздо более эффективно, чем L1, и можно считать, что оно эквивалентно эффективности Web2. А место записи и способ хранения данных могут быть решены различными доступными по цене решениями DA.

- Результаты вычислений ИИ могут быть окончательно проверены на их правильность и добросовестность с помощью ZKP. Особенностью ZKP является быстрая проверка, но медленное создание доказательств. Генерация ZKP также может быть ускорена с использованием GPU или TEE.

- Solidty → CUDA → GPU эту параллельную основную линию EVM является основой Reddio. Так что на первый взгляд это самая простая проблема для Reddio. В настоящее время Reddio работает с eliza от AiI6z, внедряя ее модуль в Reddio. Это очень перспективное направление.

Вывод

В целом, решения Layer2, параллельные EVM и технологии ИИ, кажется, не связаны друг с другом, но Reddio умело объединил эти несколько инновационных областей, полностью используя вычислительные возможности GPU.

Путем использования параллельных вычислений GPU Reddio улучшил скорость и эффективность транзакций на Layer2, повысив производительность второго уровня Ethereum. Внедрение искусственного интеллекта в блокчейн является новаторской и перспективной попыткой. Введение ИИ может обеспечить интеллектуальный анализ и поддержку принятия решений для операций в блокчейне, что позволяет создавать более интеллектуальные и динамичные приложения для блокчейна. Это междисциплинарное объединение, безусловно, открывает новые пути и возможности для всей отрасли.

Однако следует помнить, что этот сектор все еще находится в начальной стадии и требует большого количества исследований и исследований. Непрерывная итерация и оптимизация технологий, а также воображение и действия рыночных лидеров, будут ключевыми двигателями, способствующими созреванию этого инновационного направления. Reddio уже сделал важный и смелый шаг на этом перекрестке, и мы с нетерпением ждем, что в будущем в этой сфере интеграции мы увидим больше прорывов и сюрпризов.