Що, якщо генеративний ШІ виявиться безглуздим?

Автор: Гері Маркус, компілятор: Heart of the Metaverse (MetaverseHub)

Окрім того факту, що LK-99, який називають надпровідником кімнатної температури, може бути скороминущою модою, я ніколи не бачив нічого більш розкрученого, ніж генеративний штучний інтелект. Багато компаній оцінювалися в мільярди, і в новинах було багато новин; про це говорили всі від Силіконової долини до Вашингтона та Женеви.

Але насправді поточний дохід не виправдав очікувань і, можливо, навіть ніколи не досягне.

Ці оцінки прогнозують ринок у трильйони доларів, але фактичні доходи від генеративного штучного інтелекту наразі, за чутками, обчислюються сотнями мільйонів доларів. Хоча ці доходи можуть зрости в 1000 разів, це чиста спекуляція. Ми не повинні просто припускати, що це станеться.

Наразі більшу частину доходу, здається, отримують від написання напівавтоматичного коду (програмісти люблять використовувати інструменти генерації як помічників) і написання тексту.

Я думаю, що програмісти із задоволенням скористаються допоміжними інструментами генеративного штучного інтелекту; його функція автозавершення дуже корисна для їхньої роботи, і вони навчені знаходити та виправляти незвичайні помилки. Студенти продовжуватимуть використовувати генеративний ШІ, але їхні кишені будуть тісні (і вони, швидше за все, звернуться до конкурентів з відкритим кодом).

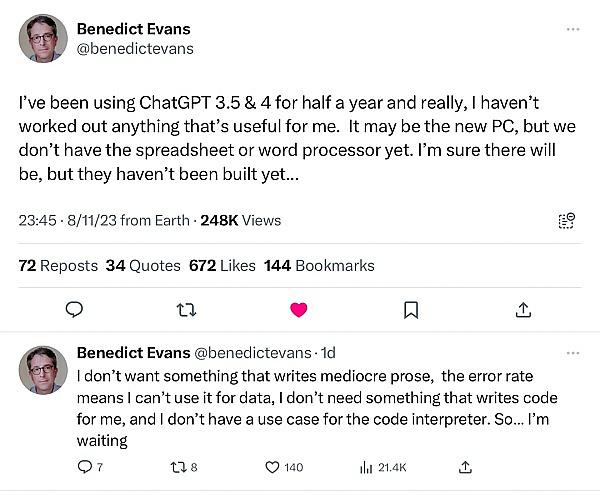

Інші потенційні клієнти можуть швидко втратити інтерес. Впливовий венчурний капіталіст Бенедикт Еванс розглянув це питання в серії статей на «X» (раніше Twitter) сьогодні вранці:

Мої друзі, які намагалися використовувати ChatGPT для відповідей на пошукові запити, щоб допомогти академічним дослідженням, зіткнулися з подібними розчаруваннями. Адвокат отримав догану від судді за використання ChatGPT у правових дослідженнях і письмово зобов’язався не використовувати його без нагляду в майбутньому. Кілька тижнів тому в новинах говорилося, що використання GPT може скорочуватися.

Якщо досвід Еванса є попереджувальним знаком, уся сфера генеративного штучного інтелекту, за поточними оцінками, може швидко підійти до кінця. Програмісти продовжуватимуть використовувати його, як і маркетологи, яким потрібно писати багато копірайтингу для просування своїх продуктів і покращення позицій у пошукових системах. Але незалежно від того, чи йдеться про кодування, чи про швидкість, і про посередній копірайтинг, цього далеко недостатньо для підтримки поточної мрії про оцінку.

Навіть OpenAI намагається досягти своєї оцінки в 29 мільярдів доларів; конкуруючі стартапи з оцінкою в мільярди, ймовірно, з часом припинять бізнес. Microsoft, яка майже вдвічі знизила вартість своїх акцій цього року, можливо, в основному через надії на штучний інтелект, може впасти; NVIDIA, яка злетіла ще більше, також може відступити.

Нещодавно я обговорював це питання з Роджером Макнамі, першим піонером у сфері інвестицій у програмне забезпечення. Мабуть, єдиний варіант економічного використання, який нам справді подобається, це пошук. Наприклад, використання Bing на базі ChatGPT замість Пошуку Google, але пов’язані з цим величезні технічні проблеми; у нас немає підстав думати, що проблема «ілюзії» буде вирішена найближчим часом. Якщо не вирішити, бульбашка може легко лопнути.

Але зараз мене турбує не лише економіка генеративного штучного інтелекту, яка ґрунтується більше на очікуваннях, ніж на фактичному комерційному використанні, потенціал масових, карколомних виправлень у майбутньому, а й той факт, що ми змінюємо цілі світи та країни. Політики побудовані на передумові, що створення штучного інтелекту змінить світ, що заднім числом може бути нереалістичним.

На національному рівні регулятивні заходи для захисту споживачів (наприклад, щодо конфіденційності, зменшення упередженості, вимоги щодо прозорості даних, боротьби з дезінформацією тощо) можуть бути відкладені через протилежні думки про те, що розробку генеративного штучного інтелекту слід рухати вперед якомога швидше. Можливо, у нас немає необхідного захисту споживачів, тому що ми намагаємося вивести щось, що може розвиватися не так, як очікувалося.

На мою думку, майже всі роблять фундаментальну помилку, а саме вважають, що генеративний штучний інтелект еквівалентний AGI (штучний загальний інтелект, інтелект і пильність, рівні або вищі за людські).

Можливо, люди в кожній галузі хочуть, щоб ви вірили, що AGI вже не за горами. Це підживлює їхній наратив про неминучість і підвищує ціни на їхні акції та оцінку стартапів. Генеральний директор Anthropic Даріо Амодей нещодавно передбачив, що ми досягнемо AGI протягом 2-3 років. Деміс Хассабіс, генеральний директор Google DeepMind, також зробив прогноз щодо AGI у найближчій перспективі.

Дуже сумніваюся. Ми стикаємося не з однією, а з багатьма серйозними невирішеними проблемами в основі генеративного штучного інтелекту, від їх сприйнятливості до галюцинацій і дезінформації до їхньої нездатності надійно спілкуватися із зовнішнім середовищем. Від надійної стиковки інструментів до нестабільності з місяця в місяць ( що робить їх непрактичними для інженерних застосувань у великих системах).

Реальність така, що у нас немає жодних конкретних підстав вважати, що вирішення цих проблем неминуче, окрім чистого технологічного оптимізму. Масштабування системи за рахунок збільшення її розміру в деяких випадках допомагає, але не в інших; ми все одно не можемо гарантувати, що будь-яка конкретна система буде чесною, нешкідливою чи корисною, а не лестивою, нечесною, шкідливою чи упередженою.

Дослідники ШІ працювали над цими питаннями роками. Нереалістично уявити, що всі ці складні проблеми будуть раптово вирішені. Протягом 22 років я скаржився на проблеми з галюцинаціями; люди обіцяли, що рішення прийдуть, але вони ніколи не реалізуються. Оскільки наша сучасна технологія базується на автозавершенні, а не на фактах.

Деякий час такі занепокоєння не були почуті, але нещодавно деякі технічні лідери, здається, нарешті це зрозуміли. Буквально кілька днів тому журнал Fortune опублікував такий звіт:

Генеративний штучний інтелект, ймовірно, не зможе генерувати трильйони доларів на рік, якщо проблема галюцинацій не буде вирішена. Якщо він не принесе результатів у трильйони доларів, він може не мати очікуваного впливу. Якщо це не має такого ефекту, можливо, нам не варто будувати наш світ на цій передумові.