Grammarly đẩy AI chuyên gia duyệt bài gây tranh cãi! Học giới chỉ trích: không được phép và cố ý bắt chước học giả đã khuất

Grammarly ra mắt “Expert Review” mô phỏng bình luận của học giả bằng AI, gây tranh cãi về việc sử dụng tên tuổi và đạo đức học thuật không được phép.

Grammarly ra mắt chức năng AI “Đánh giá chuyên gia” gây tranh cãi trong giới học thuật

Các công cụ trí tuệ nhân tạo tiếp tục thâm nhập vào ngành viết và nghiên cứu, nhưng chức năng “AI mô phỏng bình luận của chuyên gia” mới nhất đã gây ra cuộc tranh luận sôi nổi về đạo đức và quyền phép. Grammarly, một công cụ viết nổi tiếng, gần đây đã giới thiệu chức năng AI mang tên “Expert Review”, cho phép người dùng khi viết tài liệu, mô phỏng góc nhìn của các học giả hoặc nhà phê bình cụ thể để đưa ra đề xuất và bình luận.

Chức năng này sẽ phân tích văn bản người dùng đang viết, tự động đề xuất “chuyên gia” phù hợp dựa trên chủ đề, sau đó sử dụng mô hình ngôn ngữ lớn để tạo ra bình luận. Ví dụ:

- Trong các chủ đề bình luận truyền thông, hệ thống có thể trích dẫn phong cách quan điểm của Margaret Sullivan, cựu biên tập viên công cộng của The New York Times hoặc Jack Shafer, nhà báo truyền thông kỳ cựu của Politico, để giúp người dùng chỉnh sửa bài viết.

- Trong các vấn đề pháp lý và quản trị mạng, hệ thống cũng có thể mô phỏng cách phân tích của Lawrence Lessig, giáo sư luật tại Harvard; hoặc trong các chủ đề đạo đức công nghệ và quyền riêng tư thông tin, có thể trích dẫn các nhà nghiên cứu đạo đức AI như Timnit Gebru hoặc Helen Nissenbaum, giáo sư khoa học máy tính tại Cornell Tech.

Grammarly cho biết, chức năng này không thực sự do các chuyên gia đó đánh giá, mà dựa trên các nghiên cứu và bài viết công khai của họ để tạo ra các bình luận “được truyền cảm hứng từ tư tưởng của họ”. Công ty nhấn mạnh, hệ thống sẽ tự động chọn các học giả hoặc nhà phê bình có ảnh hưởng trong ngành phù hợp với chủ đề bài viết, và gợi ý người dùng đọc thêm các tác phẩm của họ.

Tuy nhiên, cách thiết kế này vẫn gây tranh cãi trong giới học thuật, đặc biệt là khi một số học giả phát hiện tên của họ bị dùng cho vai trò bình luận AI mà không hề có sự cho phép hay hợp tác trước đó.

Học giả chỉ trích việc sử dụng tên tuổi không phép, thậm chí mô phỏng học giả đã qua đời

Trong các phản đối, điểm gây tranh cãi nhất là khả năng AI mô phỏng phong cách bình luận của các học giả đã qua đời. Một số học giả chỉ ra, cách làm này tương đương như “hồi sinh” học giả để đánh giá bài viết dựa trên tên tuổi của họ.

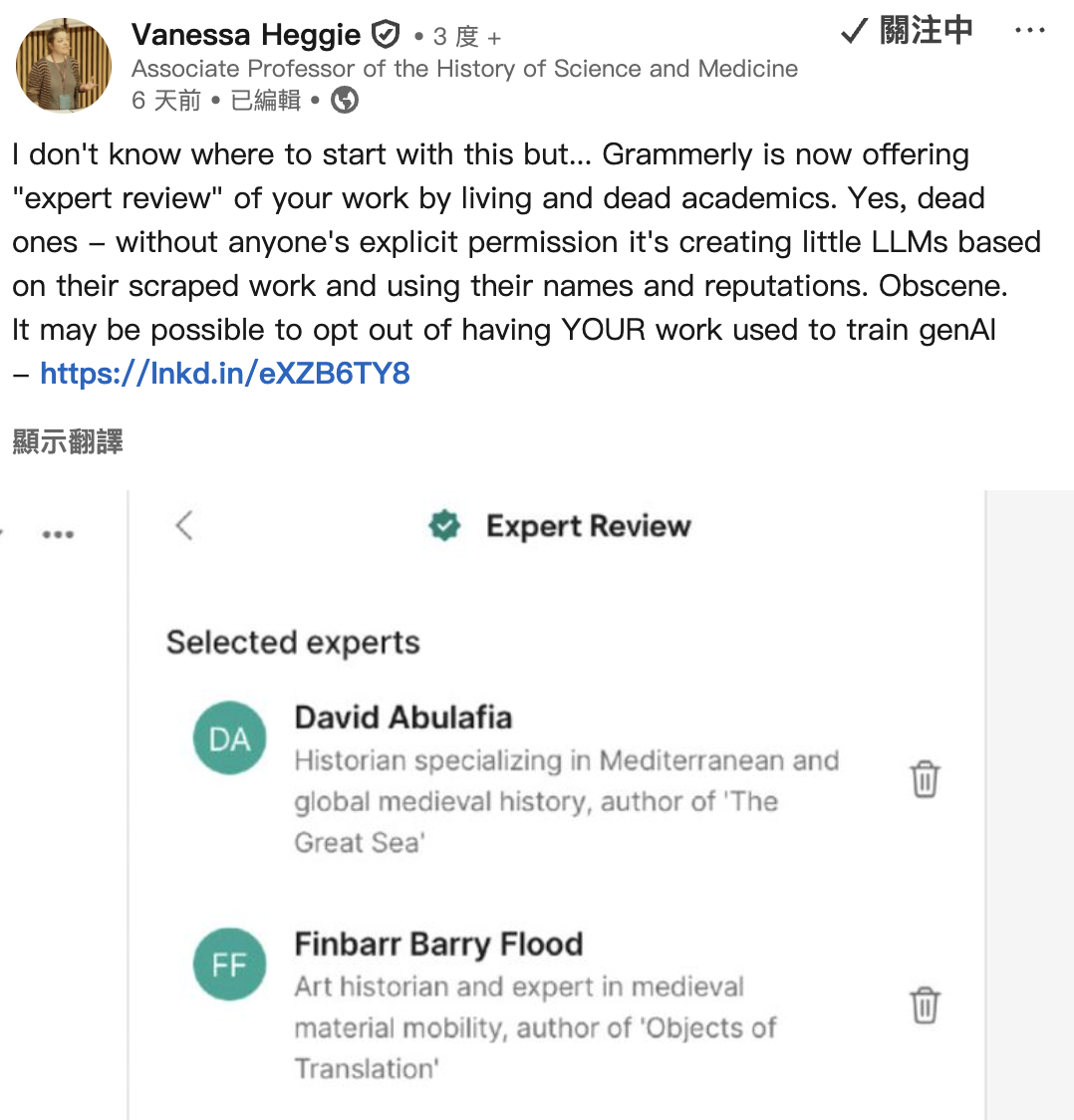

Giáo sư lịch sử Vanessa Heggie của Đại học Birmingham, Anh, đã công khai chỉ trích chức năng này trên LinkedIn, cho rằng Grammarly đang sử dụng thành quả nghiên cứu của các học giả để xây dựng mô hình ngôn ngữ, rồi lấy tên và uy tín của họ làm vai trò bình luận AI. Bà đặt câu hỏi liệu các học giả này có từng cho phép công ty sử dụng tác phẩm của họ để huấn luyện mô hình, hoặc đồng ý cung cấp “đánh giá AI” dưới tên của chính mình hay không.

Nguồn hình ảnh: LinkedIn Giáo sư lịch sử Vanessa Heggie của Đại học Birmingham công khai chỉ trích chức năng này trên LinkedIn

Heggie cho biết, nhiều học giả thậm chí đã qua đời nhưng vẫn bị AI sử dụng làm vai trò bình luận. Bà cho rằng, việc sử dụng thành quả nghiên cứu và danh tiếng của học giả mà không có sự đồng ý là hành vi khó chấp nhận.

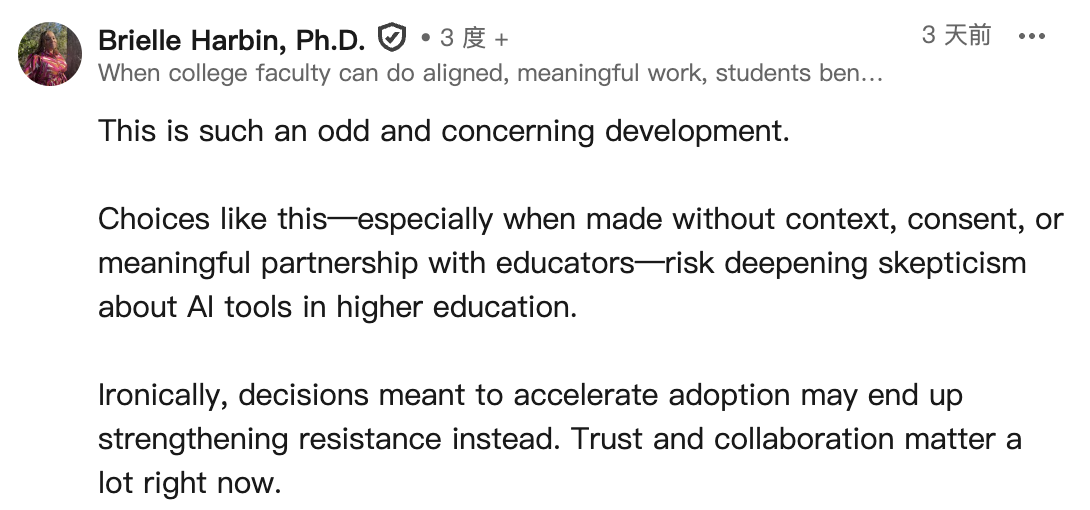

Một học giả khác, cựu phó giáo sư khoa chính trị tại Học viện Hải quân Hoa Kỳ, Brielle Harbin, cũng bày tỏ sự lo ngại về chức năng này. Cô nhấn mạnh rằng, trong khi ngành giáo dục đại học vẫn còn đang quan ngại về AI, việc các công ty công nghệ xây dựng mô hình bình luận dựa trên tên tuổi học giả mà không có sự hợp tác hay rõ ràng về quyền sở hữu có thể làm giảm niềm tin vào các công cụ AI trong giới học thuật.

Nguồn hình ảnh: LinkedIn Cựu phó giáo sư Brielle Harbin của Học viện Hải quân Hoa Kỳ cũng bày tỏ lo ngại

Harbin cho rằng, hiện tại ngành giáo dục đại học vẫn còn trong giai đoạn thăm dò về AI. Nếu các công ty công nghệ bỏ qua hợp tác và đạo đức trong thiết kế sản phẩm, thay vì thúc đẩy việc chấp nhận AI nhanh chóng, họ có thể gặp phải phản đối lớn hơn.

Grammarly chuyển đổi nền tảng AI, trợ lý viết trở thành đại lý năng suất

Ra mắt từ năm 2009, Grammarly ban đầu định vị là công cụ hỗ trợ ngữ pháp và viết dựa trên AI. Với sự phát triển nhanh của công nghệ AI tạo sinh, công ty đã dần chuyển đổi sản phẩm từ một trợ lý viết đơn thuần thành một nền tảng năng suất đa chức năng. Năm 2025, công ty mẹ của Grammarly tuyên bố tái định vị thương hiệu thành “Superhuman”, biểu thị rằng sản phẩm của họ không còn chỉ là công cụ kiểm tra ngữ pháp nữa, mà là một loạt các đại lý công việc dựa trên AI (AI Agents).

Hiện tại, dòng sản phẩm của công ty đã mở rộng sang nhiều ứng dụng, bao gồm hỗ trợ nghiên cứu, viết email, quản lý lịch trình và tự động hóa quy trình làm việc. Trong số đó, Expert Review là một dịch vụ đại lý AI mới được ra mắt. Theo mô tả chính thức, Grammarly cho biết Expert Review nhằm giúp sinh viên, nhà nghiên cứu và chuyên gia cải thiện chất lượng viết của họ. Ví dụ, khi người dùng viết đề xuất marketing, báo cáo học thuật hoặc tài liệu kinh doanh, hệ thống sẽ phân tích nội dung và cung cấp bình luận mô phỏng của các chuyên gia.

Công ty nhấn mạnh, chức năng này không tuyên bố các chuyên gia thực sự tham gia đánh giá, cũng không đại diện cho sự bảo chứng của các chuyên gia về nội dung, mà chỉ tổng hợp các kết quả nghiên cứu của các học giả liên quan qua mô hình ngôn ngữ lớn để đưa ra đề xuất.

Tuy nhiên, cách thiết kế “mô phỏng góc nhìn của chuyên gia” này vẫn bị chỉ trích có thể gây hiểu lầm cho người dùng, khiến họ nhầm tưởng rằng các bình luận này có liên quan trực tiếp đến các học giả đó.

Mô phỏng danh nhân AI trở thành xu hướng mới của ngành công nghệ

Grammarly không phải là công ty duy nhất thử mô phỏng danh nhân hoặc học giả bằng AI. Trong những năm gần đây, nhiều doanh nghiệp công nghệ đã ra mắt các sản phẩm tương tự, hy vọng tận dụng hình ảnh các nhân vật nổi tiếng để nâng cao trải nghiệm tương tác AI.

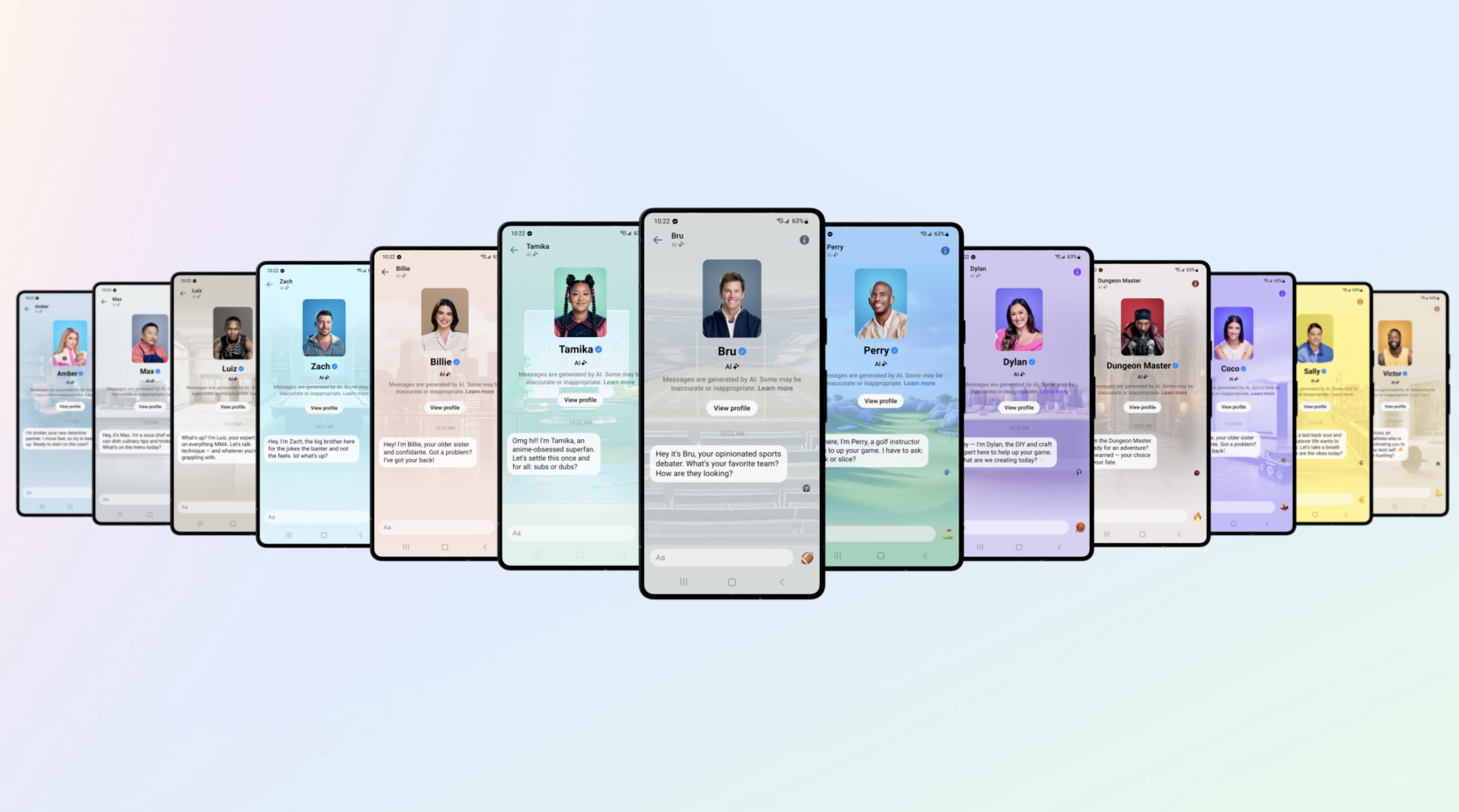

Năm 2023, Meta đã ra mắt loạt chatbot danh nhân trên nền tảng Meta AI, gồm các nhân vật như rapper Snoop Dogg, cầu thủ NFL Tom Brady, người mẫu Kendall Jenner và vận động viên quần vợt Naomi Osaka. Các nhân vật AI này dựa trên hình ảnh và phong cách nói chuyện của các danh nhân, thu hút người dùng thử nghiệm dịch vụ trò chuyện AI.

Nguồn hình ảnh: Meta Meta đã ra mắt loạt chatbot danh nhân trên nền tảng Meta AI

Trong lĩnh vực giáo dục, mô hình này cũng xuất hiện. Nền tảng giáo dục trực tuyến Khan Academy đã giới thiệu trợ lý AI “Khanmigo”, cho phép học sinh đóng vai các nhân vật lịch sử để trò chuyện. Ví dụ, học sinh có thể giả lập trò chuyện với Winston Churchill, cựu thủ tướng Anh, hoặc Harriet Tubman, lãnh đạo đường sắt ngầm của Mỹ, để hiểu rõ hơn về bối cảnh và tư tưởng lịch sử.

Tuy nhiên, khi các mô hình AI ngày càng có khả năng mô phỏng phong cách cá nhân, các vấn đề về quyền cấp phép và quyền nhân dạng cũng ngày càng nóng lên. Một số chuyên gia cho rằng, khi hệ thống AI cung cấp ý kiến dựa trên danh nghĩa của một học giả, nhà văn hoặc nhân vật nổi tiếng, điều này có thể ảnh hưởng đến cách công chúng hiểu về quan điểm của họ. Các giới học thuật cho rằng, nếu các công ty AI muốn sử dụng tư tưởng và hình ảnh của học giả hoặc nhân vật nổi tiếng, cần có cơ chế cấp phép rõ ràng và minh bạch. Nếu không, dù chỉ là “nguồn cảm hứng”, cũng có thể liên quan đến các vấn đề về uy tín, sở hữu trí tuệ và đạo đức học thuật phức tạp.