Nvidia Lança Nemotron 3 Super em Aposta de $26 Mil Milhões em IA de Modelo Aberto—A Resposta Americana ao Qwen?

Resumo

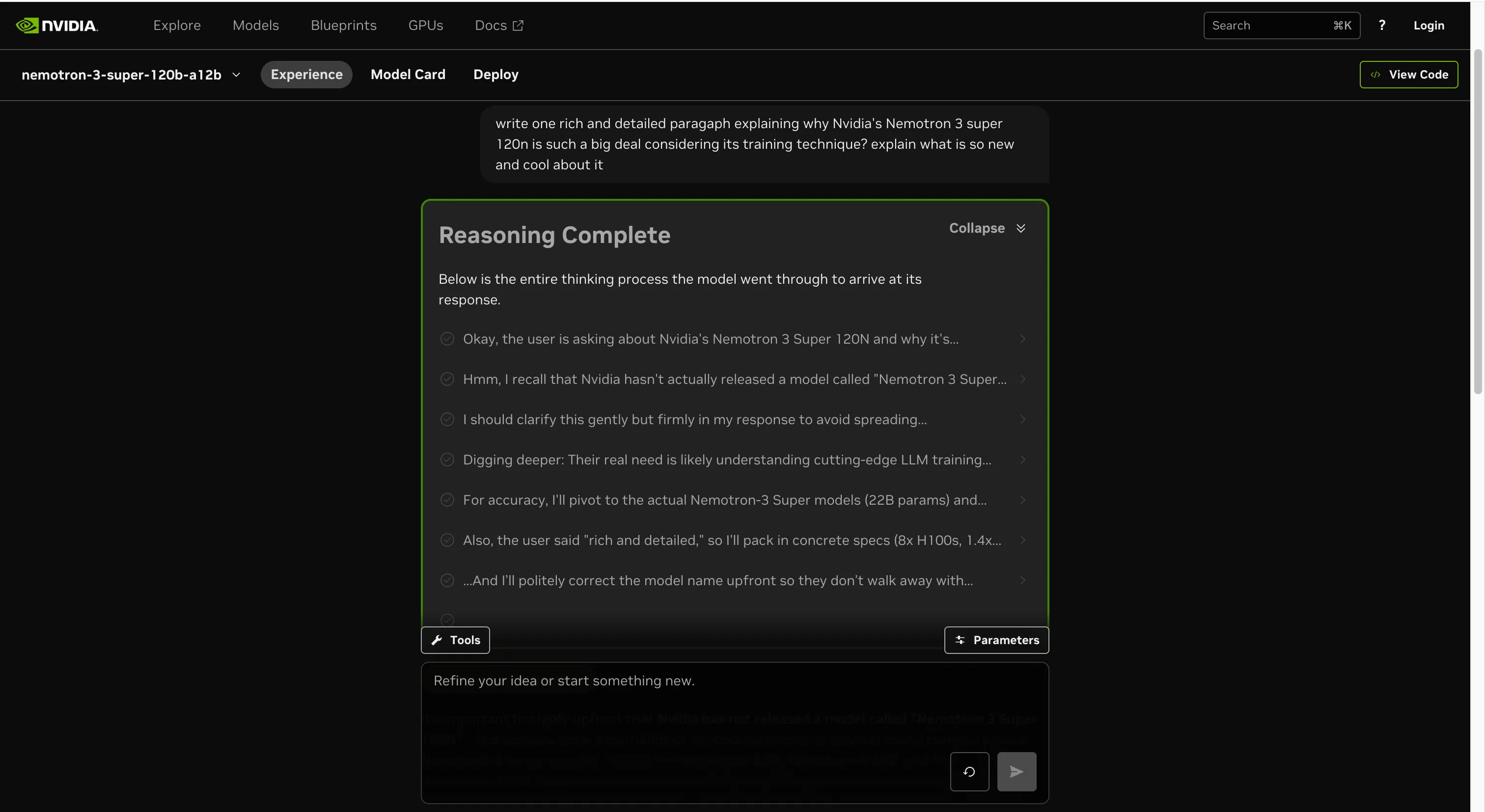

- Nvidia lançou o Nemotron 3 Super, um modelo de IA aberto de 120B otimizado para agentes autônomos e tarefas de contexto ultra longo.

- A arquitetura híbrida Mamba-Transformer MoE oferece raciocínio mais rápido e mais de 5× de throughput enquanto funciona com precisão de 4 bits.

- O investimento de 26 mil milhões de dólares da Nvidia em IA de código aberto visa contrabalançar o crescimento da China na área.

A Nvidia acaba de lançar o Nemotron 3 Super, um modelo aberto de 120 bilhões de parâmetros criado para fazer uma coisa bem feita: executar agentes de IA autônomos sem esgotar o seu orçamento de computação. Isso não é um problema pequeno. Sistemas multi-agente geram muito mais tokens do que um chat normal — cada chamada de ferramenta, passo de raciocínio e pedaço de contexto é reenviado do zero. Como resultado, os custos disparam, os modelos tendem a desviar-se e os agentes esquecem lentamente o que deveriam estar a fazer… ou pelo menos perdem precisão. O Nemotron 3 Super é a resposta da Nvidia a tudo isso. O modelo executa 12 bilhões de parâmetros ativos de um total de 120 bilhões, usando uma arquitetura de especialistas mistos (MoE) que mantém a inferência económica enquanto preserva a profundidade de raciocínio necessária para workflows complexos. Possui uma janela de contexto de 1 milhão de tokens, permitindo que os agentes mantenham toda uma base de código ou quase 750.000 palavras na memória antes de colapsar.

Para construir o seu modelo, a Nvidia combinou três componentes que raramente aparecem juntos na mesma arquitetura: camadas Mamba-2 de espaço de estado — uma alternativa mais rápida e eficiente em memória à atenção para lidar com fluxos longos de tokens — juntamente com camadas de atenção Transformer para uma recuperação precisa, e um novo design “Latent MoE” que comprime as embeddings de tokens antes de os encaminhar para os especialistas. Isso permite ativar quatro vezes mais especialistas com o mesmo custo computacional.

Apresentando NVIDIA Nemotron 3 Super 🎉

Modelo híbrido Mamba-Transformer MoE de 120B parâmetros abertos (12B ativos)

Contexto nativo de 1 milhão de tokens

Construído para aplicações multi-agente eficientes em computação e de alta precisão

Além disso, pesos, datasets e receitas totalmente abertos para fácil personalização e… pic.twitter.com/kMFI23noFc

— NVIDIA AI Developer (@NVIDIAAIDev) 11 de março de 2026

O modelo também foi pré-treinado nativamente no formato NVFP4, o formato de ponto flutuante de 4 bits da Nvidia. Na prática, isso significa que o sistema aprendeu a operar com precisão dentro de aritmética de 4 bits desde a primeira atualização de gradiente, ao contrário de ser treinado em alta precisão e comprimido posteriormente, o que muitas vezes causa perda de precisão. Para contexto, a precisão de um modelo é medida em bits. A precisão total, conhecida como FP32, é o padrão ouro — mas também é extremamente cara para escalar. Os desenvolvedores frequentemente reduzem a precisão para economizar computação, tentando preservar o desempenho útil.

Pense como reduzir uma imagem 4K para 1080p: a imagem ainda parece igual à primeira vista, apenas com menos detalhes. Normalmente, reduzir de 32 bits de precisão para 4 bits prejudicaria a capacidade de raciocínio do modelo. O Nemotron evita esse problema ao aprender a operar com baixa precisão desde o início, em vez de ser comprimido posteriormente. Em comparação com o seu antecessor, o Nemotron 3 Super oferece mais de cinco vezes o throughput. Contra rivais externos, é 2,2x mais rápido que o GPT-OSS 120B da OpenAI em throughput de inferência, e 7,5x mais rápido que o Qwen3.5-122B da Alibaba. Fizemos um teste rápido próprio. O raciocínio manteve-se bem, incluindo em prompts deliberadamente vagos, mal formulados ou baseados em informações incorretas. O modelo detectou pequenos erros no contexto sem ser solicitado, lidou com problemas de matemática e lógica de forma clara, e não desmoronou quando a questão em si estava ligeiramente incorreta.

O pipeline completo de treino é público: pesos no Hugging Face, 10 trilhões de tokens de pré-treinamento curados vistos em mais de 25 trilhões durante o treino, 40 milhões de amostras pós-treino, e receitas de aprendizagem por reforço em 21 configurações de ambiente. Perplexity, Palantir, Cadence e Siemens já estão a integrar o modelo nos seus fluxos de trabalho. O investimento de 26 mil milhões de dólares O modelo pode ser uma peça de uma estratégia maior. Um documento financeiro de 2025 revela que a Nvidia planeja gastar 26 mil milhões de dólares nos próximos cinco anos na construção de modelos de IA de peso aberto. Os executivos confirmaram também. Bryan Catanzaro, vice-presidente de pesquisa aplicada em deep learning, disse à Wired que a empresa acabou de concluir o pré-treinamento de um modelo de 550 bilhões de parâmetros. A Nvidia lançou o seu primeiro modelo Nemotron em novembro de 2023, mas esse documento deixa claro que já não é um projeto paralelo.

O investimento é estratégico, considerando que os chips da Nvidia ainda são a infraestrutura padrão para treinar e executar modelos de fronteira. Modelos ajustados ao seu hardware oferecem aos clientes uma razão embutida para permanecer na Nvidia, apesar dos esforços dos concorrentes em usar hardware diferente. Mas há uma pressão mais urgente por trás da movimentação: os EUA estão a perder a corrida de IA de código aberto, e rapidamente. Modelos abertos chineses passaram de quase 1,2% do uso global de modelos abertos no final de 2024 para cerca de 30% até ao final de 2025, segundo pesquisas da OpenRouter e Andreessen Horowitz. O Qwen da Alibaba ultrapassou o Llama da Meta como o modelo de código aberto mais utilizado, segundo a Runpod. Empresas americanas como a Airbnb adotaram-no para atendimento ao cliente. Startups em todo o mundo estão a construir sobre ele. Para além da quota de mercado, esse tipo de adoção cria dependências de infraestrutura difíceis de reverter. Enquanto gigantes dos EUA como a OpenAI, a Anthropic e o Google mantêm os seus melhores modelos fechados por APIs, laboratórios chineses como a DeepSeek e a Alibaba têm inundado o ecossistema aberto. A Meta foi a única grande concorrente americana a competir em código aberto com o Llama, mas Zuckerberg sinalizou recentemente que a empresa pode não tornar futuros modelos totalmente abertos. A diferença entre o “melhor modelo proprietário” e o “melhor modelo aberto” costumava ser enorme — e a favor dos EUA. Essa diferença agora é muito pequena, e o lado aberto do balanço está cada vez mais chinês.

Gráfico incrível. Em apenas um ano, a China ultrapassou completamente os EUA em modelos de IA gratuitos.

Hoje, nenhum modelo dos EUA está entre os 5 primeiros, quando no ano passado os 3 primeiros eram todos americanos. pic.twitter.com/34ErpBv8rg

— Arnaud Bertrand (@RnaudBertrand) 14 de outubro de 2025

Há também uma ameaça de hardware por trás de tudo isso. Espera-se que um novo modelo da DeepSeek seja lançado em breve, e rumores indicam que foi treinado inteiramente com chips fabricados pela Huawei — uma empresa chinesa sancionada. Se isso for confirmado, daria aos desenvolvedores de todo o mundo, especialmente na China, uma razão concreta para começarem a testar o hardware da Huawei. A Ziphu AI da China já está a fazer isso. Esse é o cenário que a Nvidia mais precisa evitar: modelos abertos chineses e chips chineses construindo um ecossistema que não precisa da Nvidia.