AI-Müll wird in die Open-Source-Community eingespült! Einige Projekte haben begonnen, externe Beiträge vorübergehend auszusetzen, Shitcode wirkt wie ein DDoS-Angriff

Open-Source-Projekt Tldraw kündigt aufgrund der Überlastung durch große Mengen an AI-generiertem Müll-Code eine vorübergehende Pause bei externen Beiträgen an. Solche „AI Slop“ verbrauchen die Ressourcen der Maintainer erheblich, und die Community erwägt die Einrichtung eines Reputationssystems oder eines Sicherungsmechanismus, um dem entgegenzuwirken.

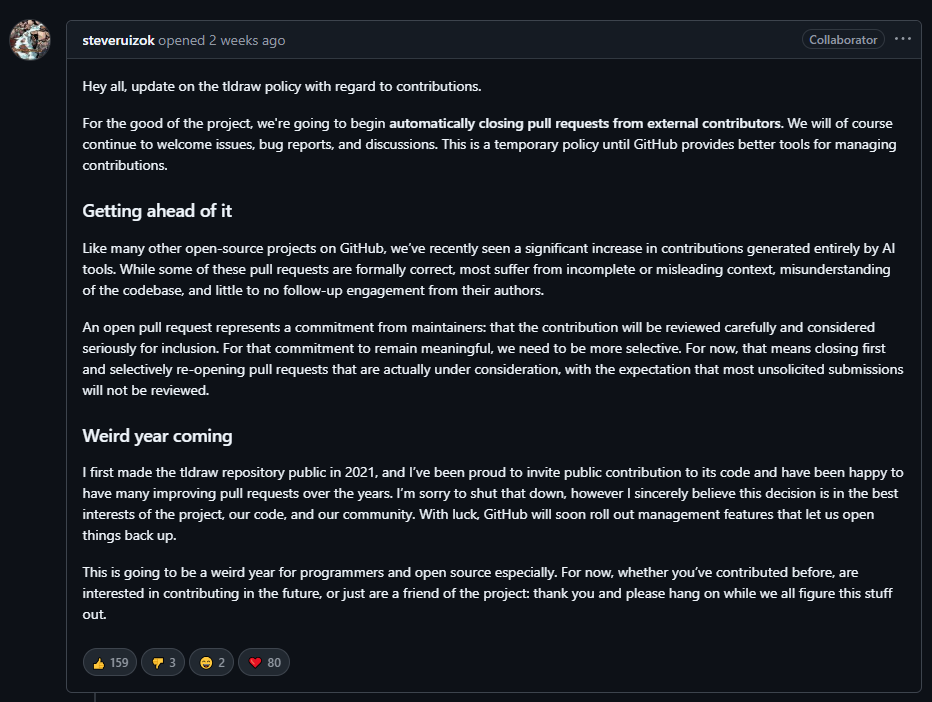

Überlastet durch AI-generierte Inhalte, pausiert das Open-Source-Projekt Tldraw die Annahme externer PR

Ein auf GitHub mit über 40.000 Sternen bewertetes Open-Source-Webdrawing-Projekt Tldraw hat kürzlich bekannt gegeben, dass es vorübergehend keine Pull Requests (PR) von externen Beitragenden mehr akzeptieren wird.

Der Entwickler steveruizok weist darauf hin, dass, wie bei vielen Open-Source-Projekten auf GitHub, das Team kürzlich eine deutliche Zunahme an Beiträgen festgestellt hat, die vollständig von AI-Tools generiert wurden. Obwohl einige Einreichungen formal korrekt sind, fehlt den meisten der Inhalte der vollständige Kontext, sie missverstehen den Code-Bestand und die Beitragenden beteiligen sich kaum an Diskussionen.

steveruizok betont, dass ein offener PR eine Verpflichtung des Maintainers darstellt, was bedeutet, dass der Beitrag sorgfältig geprüft und ernsthaft in Betracht gezogen wird. Damit diese Verpflichtung ihren Sinn behält, muss das Team strengere Filter einsetzen.

Derzeit ist die Politik von Tldraw, alle externen PR zunächst zu schließen und nur jene wieder zu öffnen, die wirklich geprüft werden. Dies dient dem besten Interesse des Projekts und der Codequalität, obwohl es bedauert wird, die öffentliche Mitwirkung zu schließen, sagt steveruizok, könne eine Rückkehr zur Offenheit erst erfolgen, wenn GitHub bessere Verwaltungswerkzeuge anbietet.

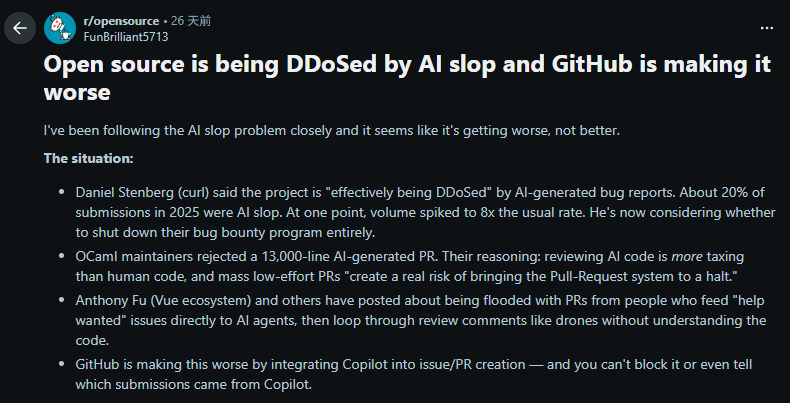

Curl und OCaml sind betroffen, AI Slop breitet sich aus

Die Entscheidung von Tldraw, Pull Requests vorübergehend zu stoppen, ist nur ein Beispiel für die jüngsten Auswirkungen von AI Slop (AI-Müll) auf die Open-Source-Community. Kürzlich haben Diskussionen auf Reddit und Hacker News diese Problematik weiter verschärft.

In einem Reddit-Thread wird erwähnt, dass der bekannte Übertragungs-Tool-Curl-Maintainer Daniel Stenberg verrät, dass das Projekt derzeit von einem „DDoS-Angriff“ durch AI-generierte Fehlermeldungen betroffen ist, bei dem etwa 20% der eingereichten Beiträge aus AI-Müll bestehen, was die freiwilligen Maintainer erheblich belastet.

Außerdem hat der OCaml-Maintainer eine Pull Request abgelehnt, die 13.000 Zeilen umfasste und von AI generiert wurde, mit der Begründung, dass die Überprüfung von AI-generiertem Code aufwändiger sei als das manuelle Schreiben, und eine Flut von minderwertigen PRs das System zum Absturz bringen könnte.

Auf Hacker News konzentrieren sich die Diskussionen auf die Mechanismen von GitHub.

Ein Nutzer meint, dass die prominente Platzierung der PR-Anzahl auf GitHub die Tendenz fördere, PRs nur zum Zweck der Datensammlung einzureichen.

Das Dilemma der generativen KI in der Open-Source-Community besteht darin, dass viele unerfahrene Entwickler AI-Tools nutzen, um wertlose Programme zu generieren, und gleichzeitig erwarten, dass Maintainer diese schnell integrieren. Dieses Verhalten zerstört das Vertrauen in die Zusammenarbeit der Open-Source-Community.

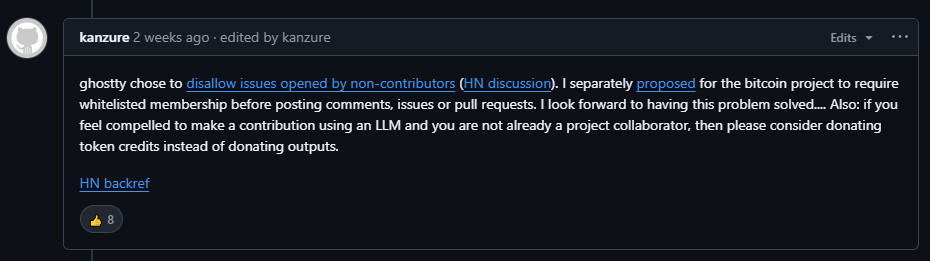

Lösungsansätze: Whitelist oder Reputationssystem

Angesichts der Belästigung durch Shitcode in der Open-Source-Community antwortete der Bitcoin-Entwickler Bryan Bishop (kanzure) auf der Tldraw-GitHub-Seite: Er habe dem Bitcoin Core-Entwicklungsteam vorgeschlagen, den Entwicklungsprozess „privatisieren“, also nur noch eingeladene Mitglieder teilnehmen zu lassen, oder eine Whitelist einzuführen, um Kommentare und PRs zu veröffentlichen.

Auch wenn dies gegen den Geist der Offenheit von Bitcoin verstoßen könnte, ist Bryan Bishop der Ansicht, dass dies effektiv den Lärm und die ineffektiven Diskussionen reduziert, die durch Nicht-Beitragende verursacht werden, sodass Entwickler sich auf die Technik konzentrieren können und wertvolle Aufmerksamkeit nicht durch böswillige oder ineffektive Interaktionen zerstreut wird.

Neben der Privatisierung schlägt der Softwareingenieur Steve Rodrigue vor, ein bereichsübergreifendes Reputationssystem für Beitragende aufzubauen, das auf Vertrauensnetzwerken basiert, um die Konten zu verifizieren.

Ein weiterer Entwickler arbeitet an einem blockchain-basierten „Stake-to-PR“-Protokoll, bei dem Beitragende eine kleine Sicherheitsleistung zahlen, die bei AI-Müll-Content eingezogen wird, bei gültigen Beiträgen aber vollständig zurückerstattet wird, um durch erhöhte Hürden AI-Missbrauch zu verhindern.

Weiterführende Literatur:

AI-Inhalte im Überfluss! Das Web-Dictionary wählt „Slop“ als das Wort des Jahres 2025, was in der Tech-Branche für Aufsehen sorgt

Verwandte Artikel

AI-Agenten durchbrechen Cloudflare-Schutz, verschlüsselte DeFi-Frontend-Sicherheit wird erneut auf die Probe gestellt

MONTRA Token-Team „ist abgehauen“, Marktkapitalisierung schwand instant um 80 %, Schuld wird auf die iranische Wehrpflicht geschoben

Netzbenutzer wollen auf den „iranischen Rial“ wetten: Er ist um 90 % gefallen, also wird er definitiv steigen! Kann man so einen Kriegslottoschein kaufen?

Südkorea: „Für tot erklärte“ Krypto-Betrüger werden wiedererkannt, realisieren Krypto-Assets und entschädigen Opfer mit 60.000 US-Dollar

Solv Protocol wurde Opfer eines Sicherheitslücken-Angriffs in Höhe von 2,7 Millionen US-Dollar: Das SolvBTC-Schatz wurde ausgeraubt, aber der SOLV-Token-Preis blieb unberührt

Vorsicht für iPhone-Nutzer! Google warnt: Coruna-Attacke-Tools sind im Umlauf und stehlen ausschließlich Kryptowährungen